A instituição de pesquisa de IA sem fins lucrativos Ai2 lançou recentemente sua nova série OLMo2, a segunda geração de seus modelos de "linguagem aberta" (OLMo). O lançamento do OLMo2 não apenas fornece um forte suporte técnico à comunidade de IA, mas também, com seu código totalmente aberto, representa o mais recente desenvolvimento em IA de código aberto.

Diferentemente de outros modelos de linguagem "abertos" no mercado, como a série Llama do Meta, o OLMo2 atende à definição estrita da Iniciativa de Código Aberto. Isso significa que os dados de treinamento, ferramentas e códigos usados em seu desenvolvimento são públicos e acessíveis a qualquer pessoa. De acordo com a definição da Open Source Initiative, o OLMo2 atende aos padrões de "IA de código aberto" da instituição, padrões esses finalizados em outubro deste ano.

Em seu blog, a Ai2 menciona que, durante o desenvolvimento do OLMo2, todos os dados de treinamento, códigos, esquemas de treinamento, métodos de avaliação e checkpoints intermediários foram totalmente abertos. O objetivo é impulsionar a inovação e a descoberta na comunidade de código aberto por meio do compartilhamento de recursos. "Ao compartilhar abertamente nossos dados, esquemas e descobertas, esperamos fornecer à comunidade de código aberto os recursos para descobrir novos métodos e tecnologias inovadoras", disse a Ai2.

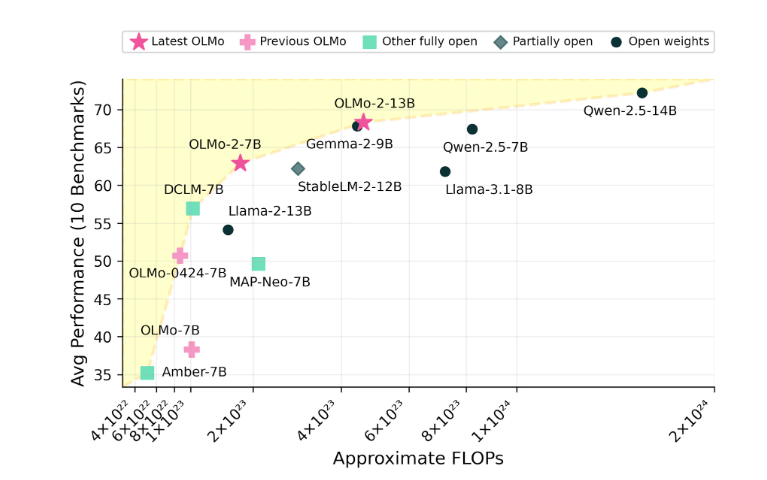

A série OLMo2 inclui duas versões: o OLMo7B com 7 bilhões de parâmetros e o OLMo13B com 13 bilhões de parâmetros. O número de parâmetros afeta diretamente o desempenho do modelo, com versões de maior número de parâmetros geralmente capazes de lidar com tarefas mais complexas. Em tarefas de texto comuns, o OLMo2 se destaca, podendo realizar tarefas como responder a perguntas, resumir documentos e escrever códigos.

Nota da fonte: A imagem foi gerada por IA, fornecida pelo Midjourney.

Para treinar o OLMo2, a Ai2 usou um conjunto de dados contendo 5 trilhões de tokens. Tokens são as menores unidades em modelos de linguagem; 1 milhão de tokens equivalem a aproximadamente 750 mil palavras. Os dados de treinamento incluem conteúdo de sites de alta qualidade, artigos acadêmicos, fóruns de perguntas e respostas e cadernos de exercícios matemáticos sintéticos. Esses dados foram cuidadosamente selecionados para garantir a eficiência e a precisão do modelo.

A Ai2 está confiante no desempenho do OLMo2, afirmando que sua performance compete com modelos de código aberto como o Llama 3.1 do Meta. A Ai2 aponta que o desempenho do OLMo2 7B até supera o Llama 3.1 8B, tornando-se um dos modelos de linguagem totalmente abertos mais poderosos atualmente. Todos os modelos OLMo2 e seus componentes podem ser baixados gratuitamente no site da Ai2 e seguem a licença Apache 2.0, o que significa que esses modelos podem ser usados não apenas para pesquisa, mas também para aplicações comerciais.