Recentemente, a ByteDance anunciou oficialmente seu mais novo projeto de IA, o "DreamActor-M1", um avanço tecnológico que visa revolucionar a geração de vídeos. Este modelo, combinando uma foto estática e um vídeo de referência de movimentos, consegue substituir perfeitamente uma pessoa de uma foto em uma cena de vídeo, gerando imagens dinâmicas com expressões faciais delicadas, movimentos naturais e alta qualidade de imagem. Este lançamento não apenas marca outra conquista da ByteDance na área de IA generativa, mas também representa um forte desafio às ferramentas atuais de geração de animação (como o Act-One da Runway).

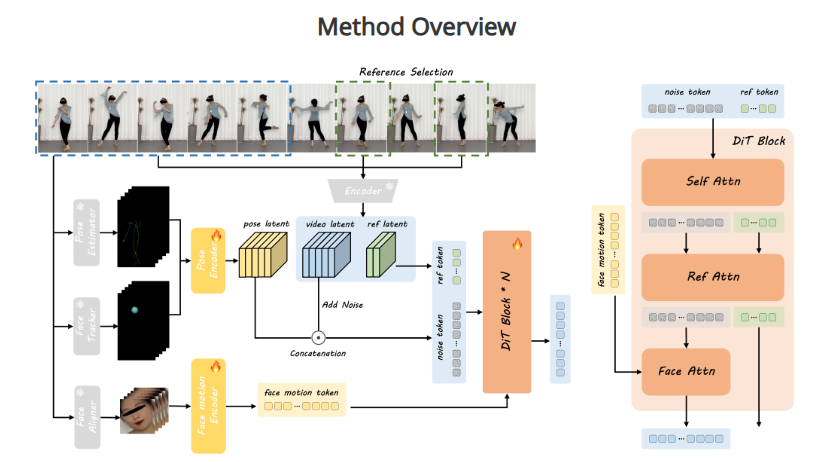

A inovação central do DreamActor-M1 reside em seu controle preciso dos detalhes e sua consistência na representação. Métodos tradicionais de geração de vídeo a partir de imagens costumam enfrentar diversos desafios, como expressões faciais pouco expressivas, transições de movimentos artificiais e discrepâncias de detalhes ou "erros" em vídeos longos. O DreamActor-M1, por meio de um design de algoritmo avançado, supera esses obstáculos tecnológicos. Seja a curvatura dos cantos da boca ao sorrir, o ritmo natural de uma piscada ou a sutil vibração dos lábios, o modelo consegue representar tudo com impressionante realismo. Ao mesmo tempo, ele controla simultaneamente os movimentos corporais, como virar a cabeça, levantar a mão ou até dançar, garantindo a harmonia e a fluidez da imagem como um todo.

De acordo com análises técnicas, este resultado pode ser atribuído ao profundo acúmulo da ByteDance em aprendizado profundo e processamento de vídeo. O DreamActor-M1 não apenas captura os padrões de movimento do vídeo de referência, mas também os integra perfeitamente às características da pessoa na foto estática. O resultado preserva a singularidade da identidade original, evitando os problemas comuns de "distorção" ou "movimentos estranhos". Essa alta fidelidade na saída permite alcançar um padrão de alta definição na qualidade de imagem, oferecendo ao usuário uma experiência visual próxima a uma gravação real.

Especialistas do setor apontam que o lançamento do DreamActor-M1 preenche uma lacuna importante na área de geração de vídeos por IA. Em comparação com tecnologias existentes, como o Act-One da Runway, o modelo se destaca pelo controle de detalhes (como a reprodução de microexpressões) e pela sincronização de movimentos multidimensionais (como a coordenação entre rosto e membros). Essa característica lhe confere um amplo potencial em diversos cenários de aplicação. Por exemplo, na produção cinematográfica, diretores podem usar uma única foto para gerar rapidamente a atuação dinâmica de um personagem; nas redes sociais, usuários podem transformar suas fotos em vídeos animados e divertidos; na educação ou realidade virtual, essa tecnologia também pode apoiar a criação de conteúdo imersivo.

No entanto, o lançamento do DreamActor-M1 também suscita reflexões profundas sobre a aplicação da tecnologia. Sua capacidade de gerar conteúdo com alto grau de realismo pode revolucionar a criação de conteúdo digital, mas também pode intensificar debates sobre deepfakes e proteção de privacidade. A ByteDance ainda não divulgou a origem dos dados de treinamento do modelo ou seus planos de comercialização, mas o público espera que, no futuro, sejam fornecidos mais detalhes para equilibrar a inovação tecnológica com as normas éticas.

Como empresa matriz do TikTok, a ByteDance tem intensificado sua atuação na área de IA nos últimos anos. Da geração de imagens à animação de vídeos, sua pesquisa e desenvolvimento estão avançando constantemente em direção a uma abordagem multimodal mais complexa. O lançamento do DreamActor-M1 não apenas demonstra mais uma vez sua força tecnológica, mas também representa um passo sólido na corrida global da IA. É previsível que, com o aprimoramento e a popularização deste modelo, ele poderá redefinir a forma como o conteúdo de vídeo é criado, trazendo mais surpresas e possibilidades para usuários e indústrias.

Endereço do projeto: https://grisoon.github.io/DreamActor-M1/