德国知名新闻主播成为 AI 投资骗局中 Deepfake 滥用的受害者

站长之家

本文来自AIbase日报

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

近日,多名宝妈购买"AI无人直播课程"被骗事件引发关注。据报道,这些宝妈交了学费后发现学不到实质内容,直播经常违规被封。对此,抖音副总裁李亮于3月17日发文明确表示,抖音严禁无人直播,请大家谨防上当受骗。据了解,这些所谓的"AI无人直播"课程销售者在售课阶段积极热情,但收款后则爱搭不理,拒绝退款。九派新闻在社交平台搜索"无人直播"发现大量传授如何开号和"避免封号"的内容,而评论区的询问多被引导至私聊。同时,平台上也有不少"避坑"内容,提醒"无人直播10个有

正文:近日,YouTube 发出警告,提醒内容创作者注意一则利用其首席执行官尼尔・莫汉(Neal Mohan)AI 伪造视频进行的网络钓鱼诈骗。这段虚假视频已经通过私密方式分享给了一些用户,声称 YouTube 正在对其盈利政策进行调整,目的在于窃取用户的账号信息。YouTube 在周二的公告中明确表示:“YouTube 及其员工绝不会通过私密视频联系您或分享信息。如果您收到声称来自 YouTube 的私密视频,请警惕这是一场网络钓鱼骗局。”最近几周,Reddit 平台上有用户分享了与此类似的诈骗经历。一名用户表示

近日,在中关村论坛系列活动第12届数字金融与科技金融大会上,蚂蚁数科的 Deepfake 检测方案入选大会“金融科技技术创新与应用案例”。蚂蚁数科依托旗下天玑实验室,业界首次构建了大规模、高质量、多模态的 Deepfake 数据集,其合成超过百万级多媒体内容,充分地模拟了真实世界金融风控环境中的Deepfake攻击样本,成为评测现有金融领域Deepfake检测模型性能的重要标准。在金融业务场景中,蚂蚁数科多组测试数据集上的 Deepfake 检测准确率达到了98%以上,并成功阻止了多起利用Deepfake技

如今,Deepfake 已经无孔不入。随着生成式 AI 的普及,网络上的虚假内容呈爆炸式增长。据身份验证平台 Sumsub 统计,2023年至2024年,全球 Deepfake 数量增加了4倍。2024年,Deepfake 占所有欺诈行为的7%,从身份冒充、账户盗用到复杂的社会工程攻击,无不涉及 Deepfake 的身影。为了有效打击 Deepfake,Meta 公司近日发布了一款工具,可以在 AI 生成的视频片段上添加难以察觉的水印。这款名为 Meta Video Seal 的工具于周四宣布开源,旨在集成到现有软件中。 该工具与 Meta 的其他水印工具 Watermark Anything(

在当今的人工智能时代,AI 生成内容日益增多,信息真实性面临挑战。Deep Fake Detector 作为一款创新的浏览器插件应运而生,它致力于帮助用户准确区分人类撰写文本与 AI 生成文本,为保障信息的可靠性提供有力支持,让用户在信息洪流中能够辨别真伪,避免被虚假信息误导。Deep Fake Detector 简介Deep Fake Detector 是一款由 Mozilla 提供的浏览器插件形式的服务,其本身也是经过训练的 AI 模型。它专注于识别 AI 生成的文字内容,目前主要支持英文内容检测。通过集成多个开源检测模型,如 ApolloD

近期,Deepfake技术滥用事件在韩国引起广泛关注,近22万人通过Telegram传播AI生成的色情图片,对女性权益造成严重伤害。这一事件与"N号房事件"相呼应,凸显了AI技术滥用的社会危害。中国女工程师张欣怡及其团队针对这一问题,宣布将参加外滩大会AI创新赛的Deepfake模型向全球开源,旨在为对抗Deepfake技术滥用提供技术手段。该举动在社交媒体上获得广泛关注,视频播放量超过151万次。张欣怡表示,团队受到韩国事件启发,旨在通过技术手段为受害者提供保护。开源模型旨在降低使用门槛,让更多人能便捷地对抗Deepfake。此外,赛事设立奖金池鼓励技术人才,推动AI向善发展。尽管技术对抗是重要一环,还需从法律、教育等多层面构建全面防御体系,包括加强法律法规、提高公众媒体素养、培养负责任的技术使用文化等。张欣怡的行动为解决Deepfake问题提供范例,但解决这一问题需要社会各界共同努力。

微软与反仇色情组织StopNCII合作,为受害者提供清除搜索引擎上deepfake色情图像的工具。通过在设备上制作图像的数字指纹(哈希值),帮助在Bing等平台彻底清除相关合成裸体图像。此举措旨在应对生成式AI技术滥用引发的deepfake色情问题,解决仅靠用户举报难以有效应对的挑战。然而,谷歌尚未与StopNCII合作,美国对此类行为缺乏专门的联邦法律。旧金山的诉讼尝试可能推动制定更有力的法律。

作为目前发展最快的对抗性人工智能形式之一,深度伪造(Deepfakes )相关的损失预计将从2023年的123亿美元飙升至2027年的400亿美元,复合年增长率将达到惊人的32%。德勤预计,未来几年深度造假将激增,银行和金融服务将成为主要目标。

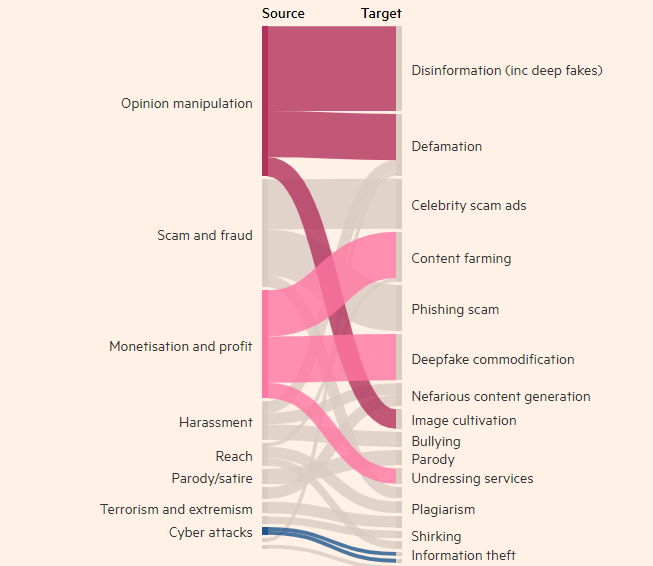

谷歌 DeepMind 首次进行了关于最常见的恶意 AI 应用的研究,结果显示生成虚假政治家和名人的人工智能(AI)“Deepfakes” 比用 AI 协助网络攻击的尝试更为普遍。这一研究是谷歌 AI 部门 DeepMind 和谷歌旗下的研发单位 Jigsaw 合作的,目的是量化生成 AI 工具的风险,这些工具已被全球最大的科技公司推向市场以寻求巨额利润。

["Meta的研究人员在对抗合成语音的挑战中取得了一项重大突破。","他们提出了一种名为AudioSeal的技术,该技术能够在人工智能生成的语音中嵌入隐形水印,用于主动检测AI生成的言论","AudioSeal是一项重要进展,但仍需谨慎应用,以克服隐私和伦理风险。","需要不断演进的解决方案以确保对抗合成媒体的可靠性和合法性。"]