SD社区推出I2V-Adapter图生视频插件,即插即用完美兼容

机器之心

本文来自AIbase日报

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

在计算机视觉领域,如何高效地处理图像一直是研究的热点话题。近日,斯坦福大学的李飞飞教授和吴佳俊教授的团队发布了一项新的研究成果,提出了一种名为 “FlowMo” 的创新型图像 tokenizer。这种新方法在不依赖卷积神经网络(CNN)和生成对抗网络(GAN)的情况下,显著提升了图像重建的质量。当我们看到一张猫咪的照片时,大脑可以瞬间识别出那是一只猫。然而,对于计算机而言,处理图像则显得复杂得多。计算机将图像视为庞大的数字矩阵,通常需要数百万个数字来表示每一个像素

近日,Meta Reality Labs 的研究团队联合高效发布了一项名为 “Pippo” 的创新性生成模型,能够从一张随意拍摄的照片中,生成一段高达1K 分辨率的密集周转视频。这一突破性技术,标志着计算机视觉和图像生成领域的又一重要进展。Pippo 模型的核心在于其多视图扩散转换器的设计。与传统的生成模型不同,Pippo 不需要任何额外的输入,例如拟合的参数模型或拍摄该图像的相机参数。用户只需提供一张普通的照片,系统就能自动生成多视角的视频效果,为用户呈现出更加生动和立体的人物形象

最近,AI 领域的热潮并未让所有公司受益,部分初创企业仍在寻找出路。Metropolis,一家基于 AI 的停车平台,已收购了有争议的计算机视觉公司 Oosto,后者曾以 AnyVision 而闻名。此次交易为全股票交易,估值为1.25亿美元,远低于 Oosto 多年来从投资者那里筹集的3.8亿美元的资金,也显然低于其巅峰估值。Metropolis 的技术已在4000个地点应用,年支付处理金额达50亿美元。该公司正在进行融资,估值接近50亿美元。Oosto 的投资者包括软银、FifthWall、Lightspeed、DFJ 等,作为交易的一部分,他们将获得

近年来,随着人工智能和计算机视觉技术的迅猛发展,人与计算机之间的交互变得越来越生动和富有表现力。尤其是在动画制作领域,如何实现基于静态图像生成动态视频一直是研究的热点。近日,一项名为 “DisPose” 的新技术应运而生,它通过解耦姿态指导,实现了更加可控的人物图像动画效果。简单的说,DisPose实现了输入动作视频和参考人物,可以让参考人物实现视频里的动作。DisPose 技术的核心在于其对传统稀疏姿态信息的重构与利用。传统方法多依赖于稀疏的骨骼姿态指导,这在

近日,OpenAI 宣布从竞争对手 Google DeepMind 引入三名资深计算机视觉和机器学习工程师,进一步加强其在人工智能领域的研发能力。这三位新员工分别是 Lucas Beyer、Alexander Kolesnikov 和 Xiaohua Zhai,他们将于在瑞士苏黎世的新办公室工作。OpenAI 的高管在周二的内部备忘录中透露了这一消息,表示这三位工程师的加入将为公司的多模态 AI 项目注入新的活力。多模态 AI 是指能够处理和理解不同媒介(如图像和音频)的人工智能模型。随着 AI 技术的快速发展,如何将不同类型的数据进行有效融合,

近年来,随着计算机视觉和动画技术的飞速发展,生成生动的人类动画逐渐成为研究热点。最新的研究成果 EchoMimicV2,利用参考图像、音频片段和手势序列,创造出高质量的半身人类动画。简单的说, EchoMimicV2支持输入1张图+1段手势视频+1段音频,即可生成新的数字人,可以说输入的音频内容、带着输入的手势和头部动作的视频。EchoMimicV2的开发是为了应对现有动画生成技术中的一些实际挑战。传统的方法往往依赖多种控制条件,如音频、姿势或运动图谱,这使得动画生成变得复杂且笨重,

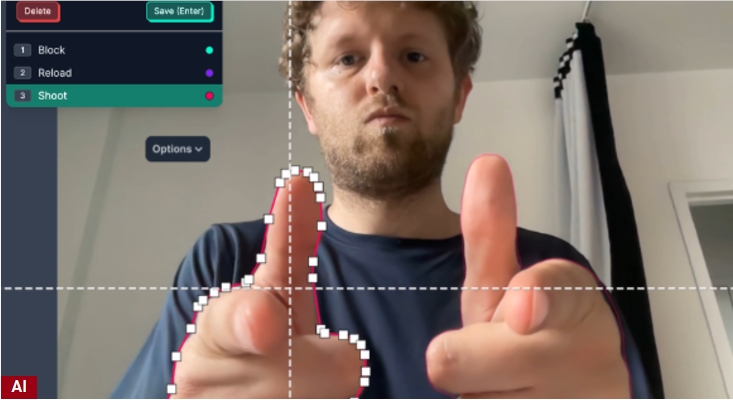

视觉AI开发平台Roboflow近日宣布完成4000万美元B轮融资。本轮融资由GV领投,Craft Ventures、Y Combinator以及Vercel AI创始人Guillermo Rauch、谷歌高管Jeff Dean和Replit创始人Amjad Masad等知名投资者参投。作为一站式视觉AI开发平台,Roboflow正在重新定义计算机视觉模型的开发方式。从最初的图像集管理工具起步,如今已发展成为一个全方位的解决方案,涵盖从原始图像和视频数据到生产就绪的视觉AI应用的完整开发流程。平台提供了一系列强大功能,包括数据集理解、自动数据标注、模型训练、微调和部署

北京智源人工智能研究院(BAAI)近日宣布推出了一款全新的全能视觉生成模型OmniGen,标志着图像生成领域的一项重大突破。OmniGen模型以其统一性、简单性和跨任务知识迁移能力而著称,能够在单一框架内处理多种图像生成任务,包括文生图、图像编辑、主题驱动生成和视觉条件生成等。此外,OmniGen还能够处理一些经典的计算机视觉任务,如图像去噪和边缘检测,通过将这些任务转换为图像生成任务来实现。

加拿大卡尔加里大学的研究人员开发了一款名为“Augmented Physics”的全新工具,旨在将静态的物理课本图表转化为交互式模拟,为物理教育带来革新。该工具利用先进的计算机视觉技术,如 Segment Anything 和多模态大型语言模型,让教师和学生能够半自动地从课本页面中提取图表,并根据提取的内容生成交互式模拟。“Augmented Physics”支持多种类型的模拟,涵盖牛顿运动、光学、电路和循环动画等。 用户可以通过简单的创作过程选择图表中的特定对象进行分割,操作这些分割后的对象,并调

一家来自慕尼黑的创新型初创公司Beyond Presence正在开创计算机视觉应用的新纪元。该公司结合先进的智能手机技术和AI能力,正在开发一种突破性的超真实头像技术。这种技术旨在创造出外观和声音与真人完全一致的虚拟形象,并能在实时对话场景中使用。今日,Beyond Presence宣布完成了其首轮外部融资,获得了310万美元的种子前轮投资。德国知名风投机构HV Capital领投,10x Founders、Alba VC以及来自Meta、DeepMind和Zalando的个人投资者也参与其中。这轮融资不仅展示了投资者对Beyond Presence技术的信