智源推Vision Mamba 高效处理视觉任务,内存能省87%

站长之家

本文来自AIbase日报

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

欢迎来到【AI日报】栏目!这里是你每天探索人工智能世界的指南,每天我们为你呈现AI领域的热点内容,聚焦开发者,助你洞悉技术趋势、了解创新AI产品应用。

AMD 在 AI 领域的进展值得关注,尤其是其最新发布的针对 Stable Diffusion 模型的优化。近日,Stability AI 推出了基于 ONNX 框架优化的 Stable Diffusion 版本,这意味着 AMD 的 Radeon 显卡和锐龙集显在运行 AI 任务时性能提升显著,最高可达3.8倍。这一进展不仅缩小了与 NVIDIA 在生态系统优化方面的差距,也为 AMD 用户带来了实实在在的好处。过去一年,AMD 与多个合作伙伴,包括操作系统供应商(OSV)、原始设备制造商(OEM)和独立软件开发商(ISV),在硬件设计、驱动程序、编译器和机器学习模型等方面紧

字节跳动Seed团队正式发布了Seedream3.0文生图模型的技术报告。这一模型在性能上实现了重大提升,是一个原生高分辨率、支持中英双语的图像生成基础模型,在分辨率、生图结构准确性等多方面取得突破,与上一版本相比优势显著。Seedream3.0在不同维度上的表现。本图各维度数据以最佳指标为参照系,已进行归一化调整。在功能亮点上,Seedream3.0可原生2K直出,无需后处理就能输出高分辨率图像,满足多种场景需求;出图速度极快,仅需3秒,极大提升创作效率;小字生成和文本排版效果得到优

近日,科技巨头 OpenAI 宣布收购初创公司 Context.ai 团队,这一举措旨在提升其 AI 模型的评估与分析能力。Context.ai 成立于2023年,由前谷歌员工 Henry Scott-Green 和 Alex Gamble 共同创办,专注于为开发者提供 AI 模型性能的深入分析和可视化工具。此举显示出 OpenAI 对提升 AI 技术的决心,尤其是在日益复杂的 AI 模型面前。作为此次收购的一部分,Scott-Green 和 Gamble 将加入 OpenAI,担任产品经理,专注于研发高效的模型评估工具。Scott-Green 在 LinkedIn 上已经更新了他的职位,表示他将负责 “构建评估工

人工智能(AI)模型的发展速度让人眼花缭乱,技术开发者们在不断提升其性能的同时,也引发了用户对于模型表现真实度的疑虑。为了解决这一问题,由杰弗里・辛顿(Geoffrey Hinton)创办的 Vector Institute 为人工智能研究推出了《评估现状研究》。该研究通过互动排行榜对11个顶尖的开放源代码和闭源模型进行了全面评测,涵盖了数学、通用知识、编码、安全性等16个基准。Vector Institute 的 AI 基础设施与研究工程经理约翰・威尔斯(John Willes)表示:“研究人员、开发者、监管者和最终用户可以

由著名 AI 科学家李飞飞领衔的斯坦福大学人工智能研究所发布了最新一期《2025年人工智能指数报告》。这份连续发布八年的权威报告指出,中国和美国作为全球最具影响力的两大 AI 国家,其顶级 AI 大模型之间的性能差距已大幅缩小至0.3%,与2023年的17.5% 相比几乎可以忽略不计。报告评选出了2024年的全球重要大模型(Notable Models),在总共61个入选模型中,谷歌和 OpenAI 各有7个模型入选并列第一,阿里巴巴以6个模型入选,其模型贡献度位列全球第三,也是入选重要模型数量最多的中国科技

近日,AI代码生成领域掀起了一波开源热潮,多款重量级模型接连亮相,其中Deep Cogito推出的Cogito v1Preview系列尤为引人注目。据AIbase了解,这一全新开源模型家族涵盖3B、8B、14B、32B和70B等多种规格,不仅在性能上全面超越同级别竞争者,其70B版本更是力压Meta最新发布的Llama4109B MoE模型,成为业界热议的焦点。这一系列模型的发布,不仅为开发者提供了强大的编程利器,也预示着AI技术在编码领域的全新突破。多规格覆盖,性能领跑行业Cogito v1Preview系列提供了从3亿到70亿参数的多种选择,满

科大讯飞在上海举办的 “AI 无界智营全球” 发布会上,宣布旗下深度推理模型星火 X1即将进行重要升级。科大讯飞的高级副总裁于继栋透露,这次升级将进一步增强星火 X1在推理能力、文本生成和语言理解等方面的表现,使其性能能够与业界领先的 OpenAI o1和 DeepSeek R1模型相媲美。星火 X1于2025年1月首次发布,并以其全国产算力训练的技术在业内引起关注。通过使用1万张910B 国产算力卡,科大讯飞成功实现了一系列技术突破,这背后是公司在国产算力平台上的大量适配和效率优化工作。此

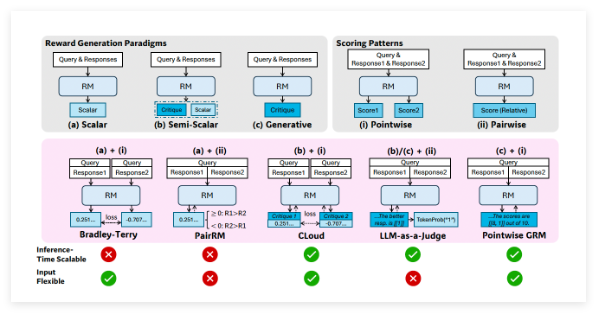

备受瞩目的中国人工智能研究实验室DeepSeek AI,继其强大的开源语言模型DeepSeek-R1之后,再次在大型语言模型(LLM)领域取得重大突破。近日,DeepSeek AI正式推出一项名为自主演原则的批判调优(Self-Principled Critique Tuning,简称SPCT)的创新技术,旨在构建更通用、更具扩展性的AI奖励模型(Reward Models,简称RMs)。这项技术有望显著提升AI在开放式任务和复杂环境中的理解和应对能力,为更智能的AI应用铺平道路。背景:奖励模型——强化学习的“指路明灯”在开发先进的LLM的过程中,强化学习(Reinfo

近日,斯坦福大学人类中心人工智能研究所(HAI)发布了备受瞩目的《2025年人工智能指数报告》。这份长达数百页的权威报告,全面梳理了2024年全球AI领域的最新趋势和技术进展,揭示了人工智能在性能提升、成本下降及全球应用上的惊人变化。从中美顶级模型差距的急剧缩小,到AI医疗设备的快速普及,再到亚洲与西方对AI态度的显著分化,这份报告为我们勾勒出一幅AI技术迅猛发展与全球竞争加剧的壮阔图景。性能差距缩小,AI技术进入白热化阶段报告显示,AI模型的性能差距正在迅速

2025年4月8日,英伟达(NVIDIA)宣布推出其最新大型语言模型(LLM)——Llama3.1Nemotron Ultra253B。这一模型基于Meta的Llama-3.1-405B-Instruct开发,通过创新的神经架构搜索(NAS)技术进行了深度优化,不仅在性能上超过了近期发布的Llama4系列中的Behemoth和Maverick,还以开源形式在Hugging Face平台上发布,引发了AI社区的广泛关注。性能突破:碾压Llama4Behemoth和Maverick根据英伟达官方披露的信息以及社交媒体上的最新讨论,Llama3.1Nemotron Ultra253B在多个关键基准测试中表现出色。这一模型拥有2530亿个参数,相较于Lla