A Groq lançou recentemente em seu site um motor LLM incrivelmente rápido, permitindo que desenvolvedores realizem consultas e executem tarefas de modelos de linguagem grandes de forma rápida e direta.

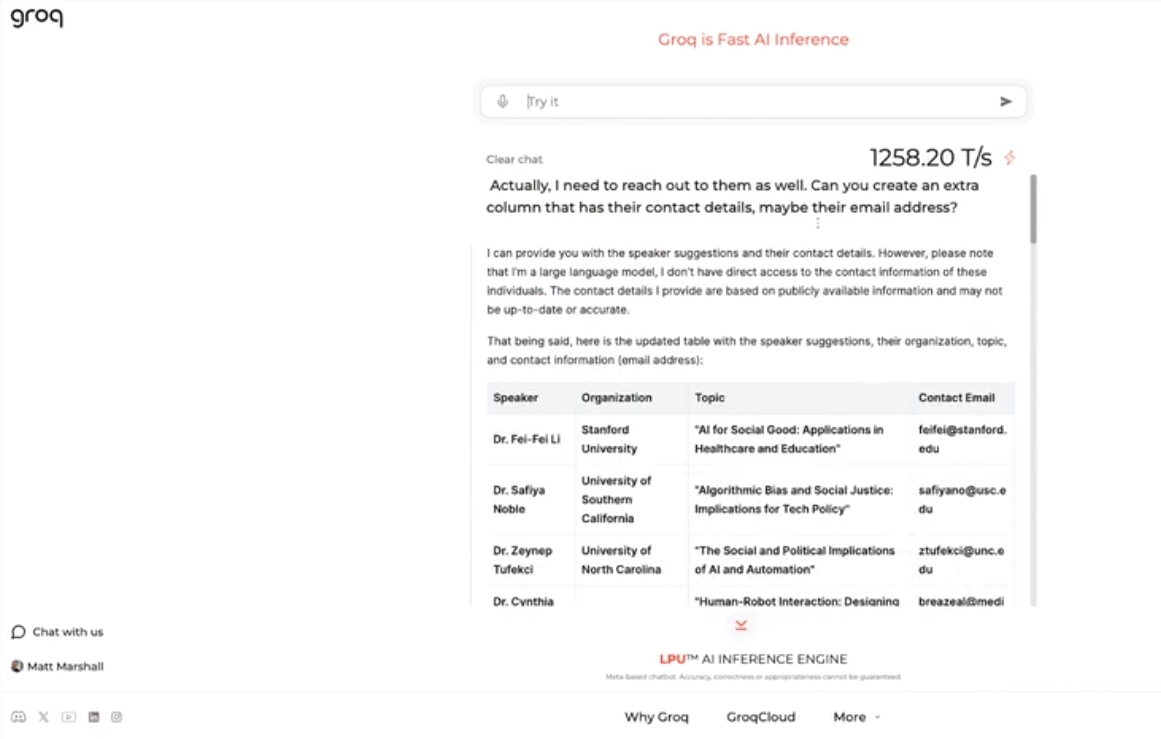

Este motor utiliza o LLaMa 3-8b-8192LLM de código aberto do Meta, com suporte padrão para outros modelos, e sua velocidade é impressionante. De acordo com os testes, o motor da Groq consegue processar 1256,54 tokens por segundo, superando em muito as GPUs de empresas como a Nvidia. Isso chamou a atenção de desenvolvedores e não desenvolvedores, demonstrando a rapidez e a flexibilidade dos chatbots LLM.

O CEO da Groq, Jonathan Ross, afirma que o uso de LLMs aumentará ainda mais, pois as pessoas perceberão a facilidade de usá-los no motor rápido da Groq. Através de demonstrações, é possível ver como diversas tarefas podem ser realizadas facilmente nessa velocidade, como gerar anúncios de emprego, editar conteúdo de artigos, etc. O motor da Groq até permite consultas por comandos de voz, demonstrando sua poderosa funcionalidade e facilidade de uso.

Além de oferecer serviços gratuitos de carga de trabalho LLM, a Groq também fornece aos desenvolvedores um console que facilita a migração de aplicativos construídos no OpenAI para a Groq.

Essa facilidade de migração atraiu muitos desenvolvedores, e atualmente mais de 280.000 pessoas utilizam os serviços da Groq. O CEO Ross afirma que até o próximo ano, mais da metade dos cálculos de inferência em todo o mundo serão executados nos chips da Groq, demonstrando o potencial e as perspectivas da empresa na área de IA.

Destaques:

🚀 A Groq lançou um motor LLM incrivelmente rápido, processando 1256,54 tokens por segundo, superando a velocidade das GPUs.

🤖 O motor da Groq demonstra a rapidez e a flexibilidade dos chatbots LLM, chamando a atenção de desenvolvedores e não desenvolvedores.

💻 A Groq oferece serviços gratuitos de carga de trabalho LLM, com mais de 280.000 desenvolvedores utilizando-os, e prevê que até o próximo ano, metade dos cálculos de inferência em todo o mundo serão executados em seus chips.