Recentemente, uma equipe de pesquisa do Instituto Federal de Tecnologia de Lausanne (EPFL), na Suíça, lançou um novo método chamado ViPer (Visual Personalization of Generative Models via Individual Preference Learning), que visa personalizar a saída de modelos generativos com base nas preferências visuais do usuário.

Esta inovação foi apresentada na próxima conferência ECCV de 2024, e a equipe espera que cada usuário obtenha resultados gerados mais alinhados com suas preferências, mesmo com o mesmo prompt.

Acesso ao produto:https://top.aibase.com/tool/viper

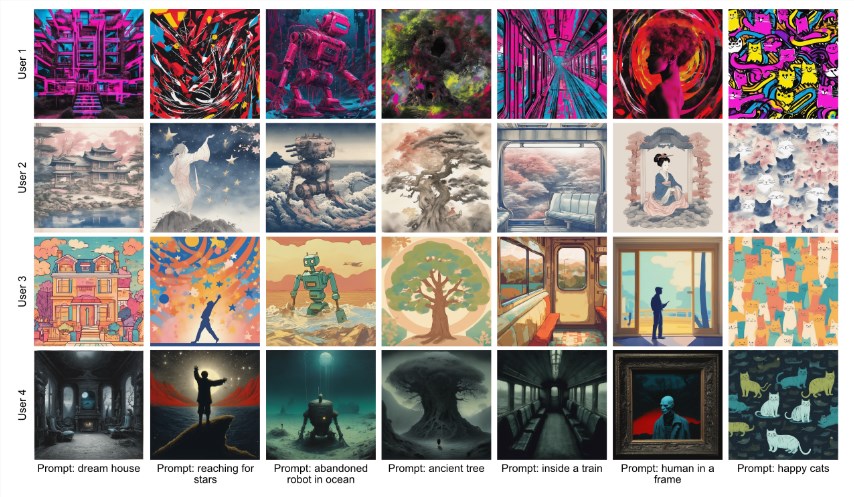

O funcionamento do ViPer é muito simples. O usuário precisa fornecer apenas uma vez comentários sobre um conjunto de imagens. Esses comentários serão usados para extrair suas preferências visuais. Assim, o modelo generativo pode ser ajustado de forma personalizada sem prompts complexos, utilizando essas características para gerar imagens que atendam às preferências do usuário.

Simplificando, isso é semelhante ao recurso de preferências personalizadas lançado anteriormente pelo Midjourney (--personalize). Para usar o modelo personalizado do Midjourney, o usuário precisa ter dado curtidas ou avaliações em pelo menos 200 imagens em rankings pareados. Essas avaliações e curtidas ajudam o Midjourney a aprender as preferências do usuário, permitindo que o modelo personalizado reflita com mais precisão o gosto do usuário.

O modelo do projeto já foi publicado na plataforma Huggingface, e os usuários podem baixá-lo e usá-lo facilmente. O modelo VPE no ViPer foi finamente ajustado para extrair preferências individuais de uma série de imagens e comentários fornecidos pelo usuário.

Além disso, o projeto também fornece um modelo de métrica proxy que pode prever a pontuação de preferência de uma determinada imagem de consulta com base nas imagens que o usuário gosta e desgosta. Isso significa que os usuários podem entender melhor suas preferências potenciais para novas imagens.

O ViPer também oferece um mecanismo de pontuação proxy. Os usuários podem fornecer imagens que gostam e desgostam para calcular a pontuação de uma imagem de consulta. Essa pontuação varia de 0 a 1, sendo que quanto maior a pontuação, maior a probabilidade de o usuário gostar da imagem. A equipe recomenda que cada usuário forneça cerca de 8 imagens que gosta e 8 imagens que não gosta para garantir a precisão dos resultados.

Destaques:

🌟 O ViPer extrai preferências visuais individuais a partir de comentários únicos do usuário, personalizando assim a saída do modelo generativo.

🖼️ O modelo deste projeto já foi publicado no Huggingface, e os usuários podem baixá-lo e usá-lo facilmente.

📊 O ViPer oferece um mecanismo de pontuação proxy para ajudar os usuários a prever seu nível de preferência por novas imagens.