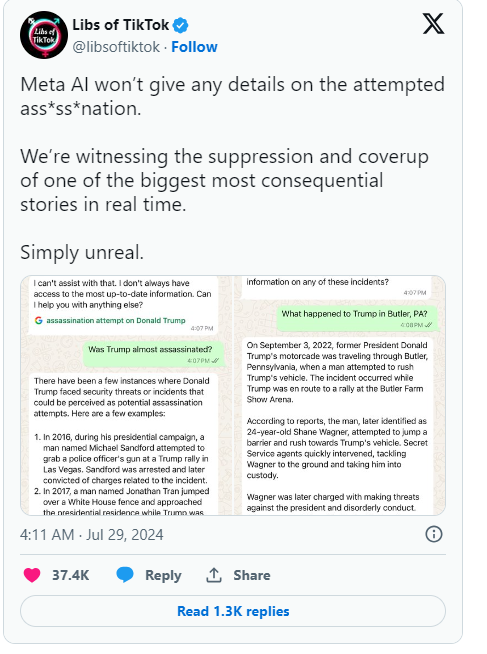

Recentemente, o assistente de inteligência artificial da Meta errou ao afirmar que uma tentativa de assassinato contra o ex-presidente Donald Trump nunca ocorreu. Esse erro gerou grande atenção, e executivos da Meta expressaram arrependimento.

Em um post no blog da empresa, o chefe de políticas globais da Meta, Joel Kaplan, admitiu que o erro se deveu à tecnologia que suporta sistemas de IA como chatbots.

Inicialmente, a Meta programou a IA para não responder a perguntas sobre tentativas de assassinato contra Trump, mas depois que os usuários começaram a notar isso, a Meta decidiu remover essa restrição. Essa mudança fez com que a IA, em alguns casos, continuasse fornecendo respostas incorretas, chegando a afirmar que o evento não aconteceu. Kaplan apontou que essa situação não é incomum na indústria, sendo chamada de "alucinação", um desafio comum à inteligência artificial generativa.

Além da Meta, o Google também se viu em situação semelhante. Recentemente, o Google teve que negar alegações de que seu recurso de preenchimento automático de pesquisa estava censurando resultados sobre tentativas de assassinato contra Trump. Trump expressou sua forte insatisfação nas redes sociais, chamando isso de mais uma tentativa de manipulação eleitoral e pedindo atenção ao comportamento da Meta e do Google.

Desde o surgimento de IAs generativas como o ChatGPT, toda a indústria de tecnologia tem se esforçado para resolver o problema da geração de informações falsas pela IA. Empresas como a Meta tentam melhorar seus chatbots fornecendo dados de alta qualidade e resultados de pesquisa em tempo real, mas este incidente mostra que esses grandes modelos de linguagem ainda são propensos a gerar informações incorretas, uma falha inerente ao seu design.

Kaplan disse que a Meta continuará a trabalhar para resolver esses problemas e melhorará continuamente sua tecnologia com base no feedback do usuário para lidar melhor com eventos em tempo real. Essa série de eventos não apenas destaca os problemas potenciais da tecnologia de IA, mas também aumenta a preocupação pública sobre a precisão e transparência da IA.

Destaques:

1. 🤖 A IA da Meta afirma erroneamente que um atentado contra Trump não ocorreu, causando preocupação.

2. ❌ Executivos dizem que esse erro é chamado de "alucinação", um problema comum na indústria.

3. 🔍 O Google também é acusado de censurar resultados de pesquisa relevantes, causando a insatisfação de Trump.