Por trás do rápido desenvolvimento da inteligência artificial, um problema grave está surgindo: a crescente dificuldade de obtenção de dados. Pesquisas recentes do MIT e outras instituições revelaram que dados da web, outrora facilmente acessíveis, estão se tornando cada vez mais difíceis de obter, representando um grande desafio para o treinamento e a pesquisa em IA.

Os pesquisadores descobriram que vários conjuntos de dados abertos, como C4, RefineWeb e Dolma, estão tendo os sites de onde extraem dados restringindo rapidamente seus contratos de licença. Isso afeta não apenas o treinamento de modelos de IA comerciais, mas também prejudica a pesquisa de organizações acadêmicas e sem fins lucrativos.

Esta pesquisa foi conduzida por quatro líderes de equipe de instituições como o MIT Media Lab, o Wellesley College e a startup de IA Raive. Eles apontam que as restrições de dados estão aumentando e que a assimetria e a inconsistência das licenças estão se tornando cada vez mais evidentes.

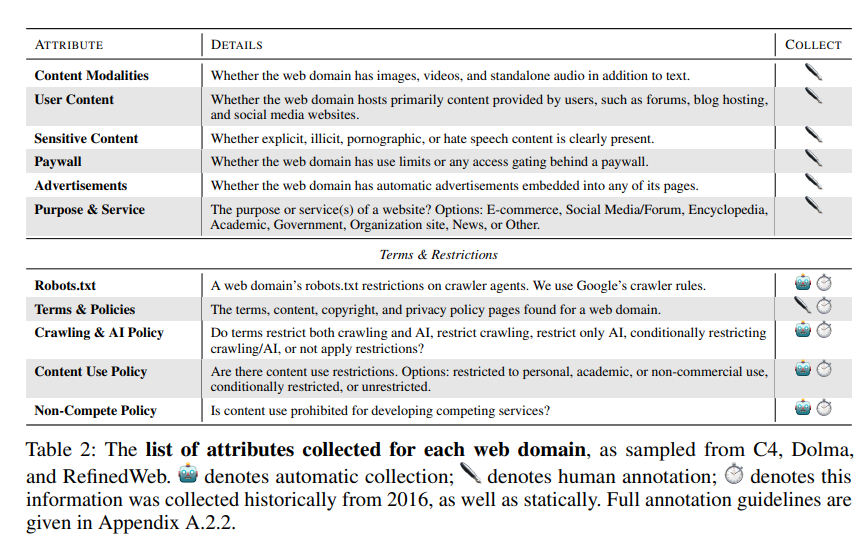

A equipe de pesquisa utilizou o protocolo de exclusão de robôs (Robots Exclusion Protocol, REP) e os termos de serviço (Terms of Service, ToS) dos sites como metodologia. Eles descobriram que até mesmo os rastreadores de grandes empresas de IA, como a OpenAI, estão enfrentando restrições cada vez mais rígidas.

Através de um modelo SARIMA de previsão, conclui-se que, no futuro, as restrições de dados impostas pelos sites, tanto através do robots.txt quanto dos ToS, continuarão a aumentar. Isso indica que a obtenção de dados abertos na web se tornará ainda mais difícil.

A pesquisa também revelou que os dados coletados na web e o uso desses dados para treinamento de modelos de IA não são consistentes, o que pode afetar o alinhamento do modelo, as práticas de coleta de dados e os direitos autorais.

A equipe de pesquisa defende a necessidade de protocolos mais flexíveis que reflitam a vontade dos proprietários dos sites, separando os casos de uso permitidos e não permitidos, e sincronizando-os com os termos de serviço. Ao mesmo tempo, esperam que os desenvolvedores de IA possam usar os dados da web aberta para treinamento e esperam que as leis futuras apoiem isso.

Endereço do artigo: https://www.dataprovenance.org/Consent_in_Crisis.pdf