A Microsoft anunciou o lançamento de três novos modelos Phi-3.5, consolidando ainda mais sua posição de liderança no desenvolvimento de inteligência artificial multilíngue e multimodal. Os três novos modelos são: Phi-3.5-mini-instruct, Phi-3.5-MoE-instruct e Phi-3.5-vision-instruct, cada um direcionado a diferentes cenários de aplicação.

O modelo Phi-3.5-mini-instruct é um modelo de IA leve, com 380 milhões de parâmetros, ideal para ambientes com recursos computacionais limitados. Ele suporta um comprimento de contexto de 128k, sendo especialmente otimizado para execução de instruções, adequado para tarefas como geração de código, resolução de problemas matemáticos e raciocínio lógico. Apesar do seu tamanho compacto, este modelo demonstra uma competitividade notável em tarefas multilíngues e de diálogo multiturno, superando outros modelos semelhantes.

Acesso: https://huggingface.co/microsoft/Phi-3.5-mini-instruct

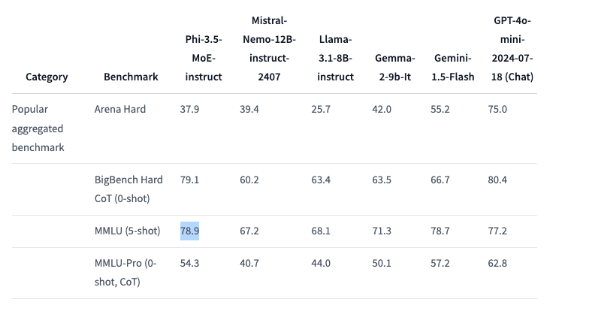

O modelo Phi-3.5-MoE é um modelo de "mistura de especialistas", combinando vários tipos de modelos, cada um especializado em uma tarefa específica. Possui 41,9 bilhões de parâmetros, suporta um comprimento de contexto de 128k e demonstra desempenho robusto em diversas tarefas de raciocínio. Este modelo se destaca no código, matemática e compreensão multilíngue, superando até mesmo modelos maiores em alguns testes de referência, como o MMLU (compreensão de linguagem de múltiplas tarefas em larga escala), onde ultrapassou o GPT-4o mini da OpenAI.

Acesso: https://huggingface.co/microsoft/Phi-3.5-MoE-instruct

O modelo Phi-3.5-vision-instruct é um modelo de IA multimodal avançado, integrando capacidades de processamento de texto e imagem, adequado para tarefas como compreensão de imagens, reconhecimento óptico de caracteres, análise de gráficos e tabelas e resumo de vídeos. Este modelo também suporta um comprimento de contexto de 128k e consegue lidar com tarefas visuais complexas de múltiplos quadros.

Acesso: https://huggingface.co/microsoft/Phi-3.5-vision-instruct

Para treinar esses três modelos, a Microsoft realizou um processamento de dados em larga escala. O modelo Mini-Instruct utilizou 3,4 trilhões de tokens, treinados em 512 GPUs H100-80G por 10 dias; o modelo Vision-Instruct utilizou 500 bilhões de tokens, treinados em 6 dias; e o modelo MoE utilizou 4,9 trilhões de tokens treinados em 23 dias.

Vale destacar que os três modelos Phi-3.5 são lançados sob a licença de código aberto MIT, permitindo que desenvolvedores usem, modifiquem e distribuam livremente esses softwares. Isso não apenas demonstra o apoio da Microsoft à comunidade de código aberto, mas também permite que mais desenvolvedores integrem capacidades de IA de ponta em seus aplicativos.

Destaques:

🌟 A Microsoft lança três novos modelos de IA, direcionados para inferência leve, especialistas mistos e tarefas multimodais.

📊 O Phi-3.5-MoE superou o GPT-4o mini em testes de referência, apresentando um desempenho excepcional.

📜 Os três modelos são lançados sob a licença de código aberto MIT, permitindo que desenvolvedores os usem e modifiquem livremente.