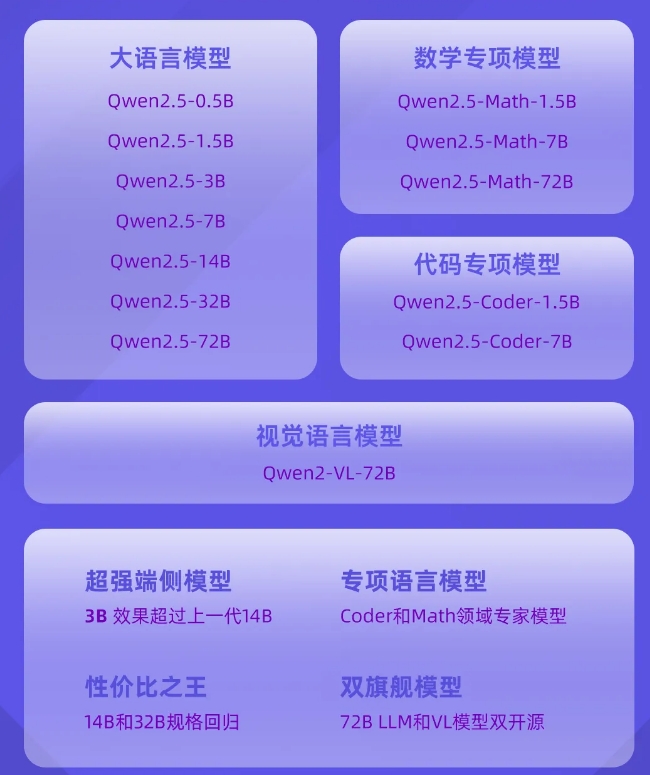

A equipe do Tongyi Qianwen anunciou o lançamento do Qwen2.5, a mais recente adição à família Qwen, três meses após o lançamento do Qwen2. Este lançamento representa possivelmente um dos maiores lançamentos de código aberto da história, incluindo o modelo de linguagem universal Qwen2.5, e os modelos Qwen2.5-Coder e Qwen2.5-Math, especializados em programação e matemática, respectivamente.

Os modelos da série Qwen2.5 foram pré-treinados em um novo conjunto de dados de grande escala, contendo até 18 trilhões de tokens. Em comparação com o Qwen2, os novos modelos demonstram melhorias significativas na aquisição de conhecimento, capacidade de programação e capacidade matemática. Os modelos suportam o processamento de textos longos, podendo gerar até 8.000 tokens, mantendo o suporte para mais de 29 idiomas.

O código aberto da série Qwen2.5 utiliza a licença Apache2.0 e oferece versões de diferentes tamanhos para atender às diversas necessidades de aplicação. Além disso, a equipe do Tongyi Qianwen também lançou em código aberto o modelo Qwen2-VL-72B, com desempenho comparável ao GPT-4.

Os novos modelos apresentam melhorias significativas na execução de instruções, geração de textos longos, compreensão de dados estruturados e geração de saídas estruturadas. Especialmente nas áreas de programação e matemática, os modelos Qwen2.5-Coder e Qwen2.5-Math, treinados em conjuntos de dados especializados, demonstram capacidades superiores em suas respectivas áreas.

Experiência com os modelos da série Qwen2.5:

Conjunto Qwen2.5: https://modelscope.cn/studios/qwen/Qwen2.5