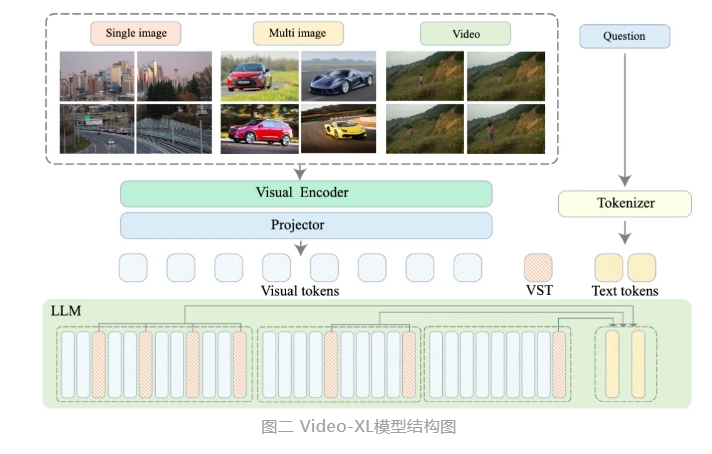

O Instituto de Inteligência Artificial de Pequim Zhiyuan, em colaboração com universidades como a Universidade Jiao Tong de Xangai, a Universidade do Povo Chinês, a Universidade de Pequim e a Universidade de Ciência e Tecnologia de Pequim, lançou um grande modelo de compreensão de vídeo extra longo chamado Video-XL. Este modelo é uma demonstração importante das capacidades centrais de modelos multimodais e um passo crucial em direção à inteligência artificial geral (AGI). Comparado com os modelos multimodais existentes, o Video-XL demonstra desempenho e eficiência superiores no processamento de vídeos longos com mais de 10 minutos.

O Video-XL utiliza a capacidade nativa dos modelos de linguagem grandes (LLMs) para comprimir sequências visuais longas, mantendo a capacidade de compreensão de vídeos curtos e mostrando uma capacidade de generalização excepcional na compreensão de vídeos longos. O modelo alcançou o primeiro lugar em várias tarefas em vários benchmarks principais de compreensão de vídeos longos. O Video-XL alcançou um bom equilíbrio entre eficiência e desempenho, exigindo apenas uma placa gráfica com 80 GB de memória de vídeo para processar uma entrada de 2048 quadros, amostrando vídeos de horas de duração e alcançando uma precisão de quase 95% na tarefa de "encontrar uma agulha em um palheiro" de vídeo.

O Video-XL promete mostrar um amplo valor de aplicação em cenários como resumo de filmes, detecção de anomalias em vídeo e detecção de inserção de anúncios, tornando-se um poderoso assistente para a compreensão de vídeos longos. O lançamento deste modelo marca um passo importante na eficiência e precisão da tecnologia de compreensão de vídeos longos, fornecendo um forte suporte técnico para o processamento e análise automatizados de conteúdo de vídeo longo no futuro.

Atualmente, o código do modelo Video-XL foi aberto para promover a cooperação e o compartilhamento de tecnologia na comunidade global de pesquisa de compreensão de vídeo multimodal.

Título do artigo: Video-XL: Modelo de linguagem de visão extra longo para compreensão de vídeo em escala de horas

Link do artigo: https://arxiv.org/abs/2409.14485

Link do modelo: https://huggingface.co/sy1998/Video_XL

Link do projeto: https://github.com/VectorSpaceLab/Video-XL