Na era da crescente popularização da inteligência artificial, cada vez mais usuários recorrem a chatbots de IA, como ChatGPT e Google Gemini, para consultar sobre questões médicas. Alguns chegam mesmo a enviar radiografias, imagens de ressonância magnética (MRI) e tomografias por emissão de pósitrons (PET) para o assistente de IA Grok, na plataforma X, buscando interpretação. No entanto, essa prática pode acarretar sérios riscos à privacidade e segurança dos dados.

Embora os dados médicos sejam protegidos por leis federais específicas, ao optar por ignorar esses mecanismos de proteção, os usuários se expõem aos seguintes riscos:

Risco de Treinamento de Dados

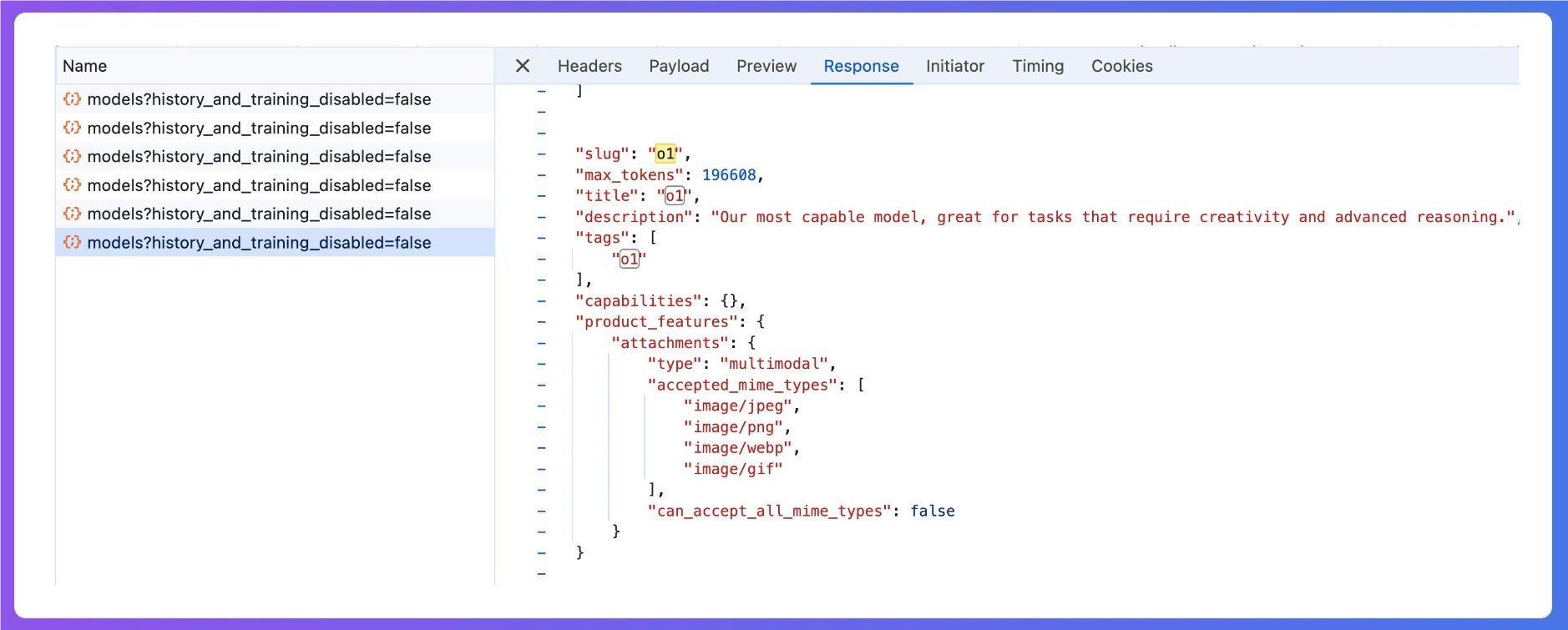

Modelos de IA generativos geralmente utilizam os dados recebidos para treinamento, a fim de melhorar a precisão das saídas. Contudo, a forma como os dados do usuário são utilizados, para que fins e com quem são compartilhados, muitas vezes carece de transparência. Além disso, as empresas podem alterar suas políticas de uso de dados a qualquer momento.

Ameaça de Vazamento de Privacidade

Usuários descobriram seus registros médicos privados em conjuntos de dados de treinamento de IA, o que significa que provedores de serviços médicos, empregadores futuros e até mesmo órgãos governamentais podem acessar essas informações sensíveis. O que é ainda mais preocupante é que a maioria dos aplicativos voltados para o consumidor não está sujeita à Lei de Privacidade de Saúde dos EUA (HIPAA), não oferecendo proteção eficaz para os dados enviados pelos usuários.

Falta de Transparência nas Políticas

No caso da plataforma X, embora seu proprietário, Elon Musk, incentive os usuários a enviar imagens médicas para o Grok a fim de melhorar a capacidade de interpretação do modelo de IA, a política de privacidade da plataforma indica que o X compartilha informações pessoais do usuário com um número não especificado de empresas "relacionadas". Essa falta de transparência nos mecanismos de compartilhamento de dados é motivo de preocupação.

Especialistas alertam os usuários: informações na internet nunca desaparecem. Antes de enviar dados médicos privados para plataformas de IA, pense bem. É preciso avaliar cuidadosamente os riscos potenciais à privacidade, mesmo que o objetivo seja melhorar a gestão da saúde.

Aproveitar as vantagens da tecnologia de IA e proteger a privacidade e segurança dos dados médicos pessoais são igualmente importantes. Recomendamos aos usuários:

Priorizar canais médicos oficiais protegidos pela HIPAA

Ler atentamente as políticas de privacidade das plataformas de IA

Evitar enviar imagens médicas sensíveis e informações de saúde pessoais

Monitorar regularmente as atualizações das políticas de uso de dados das plataformas utilizadas