Recentemente, uma equipe de pesquisadores das universidades de Stanford e Washington, e do Google DeepMind, desenvolveu um novo tipo de agente de inteligência artificial (IA) capaz de simular com precisão o comportamento humano em experimentos sociais. De acordo com sua pesquisa, essa tecnologia de simulação promete fornecer uma base laboratorial para testar teorias em campos como economia, sociologia, organização e ciência política.

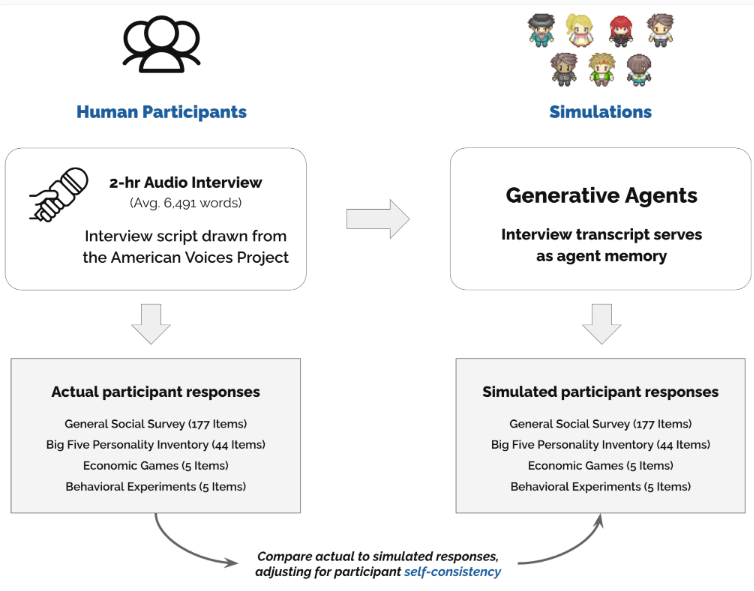

Os pesquisadores construíram esses agentes de IA usando dados de entrevistas com mais de 1.000 eleitores americanos. A idade, o sexo, a formação educacional e as opiniões políticas dos entrevistados representam a diversidade da sociedade americana. Os agentes de IA reproduzem as reações reais dos entrevistados a perguntas dos usuários, analisando esses registros de entrevistas e utilizando o modelo GPT-4o.

Na implementação específica, a equipe realizou entrevistas aprofundadas de duas horas com cada participante e usou o modelo Whisper do OpenAI para transcrever as entrevistas em texto. Esse método aumentou significativamente a precisão dos agentes de IA. Em testes de previsão de comportamento humano, os agentes de IA baseados em dados de entrevistas previram com sucesso as respostas humanas em pesquisas sociais gerais com 85% de precisão, desempenho significativamente superior ao de agentes de IA que dependiam apenas de informações demográficas básicas.

Os pesquisadores também conduziram cinco experimentos de ciências sociais, e os resultados mostraram que, em quatro experimentos, os resultados gerados pelos agentes de IA foram altamente consistentes com as respostas dos participantes humanos, com um coeficiente de correlação de 0,98. Isso indica que o método baseado em entrevistas apresenta maior precisão e melhor equilíbrio na análise de respostas em diferentes ideologias políticas e grupos raciais.

Para promover pesquisas futuras, a equipe de pesquisa carregou o conjunto de dados de seus 1.000 agentes de IA para o GitHub, para uso por outros cientistas. Para proteger a privacidade dos participantes, a equipe implementou um sistema de acesso de dois níveis.

Os cientistas podem acessar livremente os dados agregados de respostas para tarefas específicas, enquanto o acesso aos dados de respostas individuais em pesquisas abertas requer permissão especial. Esse sistema visa ajudar os pesquisadores a estudar melhor o comportamento humano, ao mesmo tempo em que protege a privacidade dos participantes das entrevistas originais.

Acesso ao projeto: https://github.com/joonspk-research/genagents

Destaques:

🌟 Os agentes de IA desenvolvidos pela equipe de pesquisa são baseados em dados de entrevistas e podem simular com precisão o comportamento humano, melhorando a precisão da pesquisa em ciências sociais.

📊 Os agentes de IA alcançaram uma precisão de previsão de 85% em pesquisas sociais, desempenho significativamente superior ao de agentes de IA que dependem apenas de informações demográficas.

🔍 O conjunto de dados foi disponibilizado publicamente, e outros pesquisadores podem acessá-lo através do GitHub para promover a pesquisa sobre comportamento humano, ao mesmo tempo em que protege a privacidade dos participantes.