Nos últimos anos, modelos de linguagem de grande porte, como o ChatGPT, iniciaram uma nova onda no campo da IA. Esses poderosos modelos de linguagem não apenas compreendem instruções humanas, mas também podem planejar, explorar ambientes e usar ferramentas para resolver tarefas complexas, demonstrando um enorme potencial em áreas como robótica, assistentes pessoais e automação de processos.

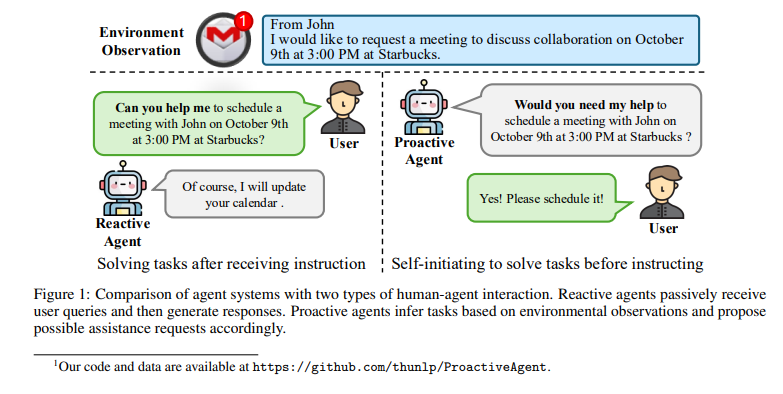

No entanto, a maioria dos sistemas de agentes de IA existentes são passivos e precisam de instruções humanas explícitas para executar tarefas. Para agendar uma reunião, você ainda precisa inserir manualmente a hora, o local e até mesmo os participantes, o que é ainda mais complicado do que fazer você mesmo!

Imagine que você recebe um e-mail de um colega sugerindo uma reunião. Um agente de IA passivo esperaria por suas instruções explícitas para agendar a reunião. Um agente de IA proativo, por outro lado, notaria o e-mail e ofereceria proativamente agendar a reunião. Essa proatividade não apenas reduz significativamente a carga cognitiva do usuário, mas também identifica necessidades latentes não expressas explicitamente pelo humano.

Para resolver o problema da passividade dos assistentes de IA, a Universidade Tsinghua e a Moshang Intelligence uniram forças para propor um novo tipo de agente de IA. Em vez de ser uma máquina "obediente", ele pode ser "previdente", antecipando suas necessidades e organizando tudo antes mesmo que você abra a boca!

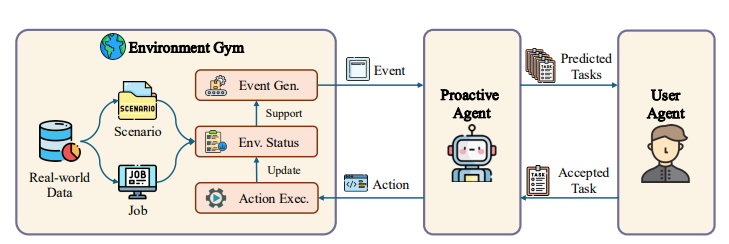

Como esse agente de IA "mágico" faz isso? O segredo é o conjunto de dados ProactiveBench! Este conjunto de dados é como uma "enciclopédia" que registra várias atividades humanas, incluindo cada letra que você digita no seu computador, cada link que você clica e até mesmo o conteúdo que você copia e cola!

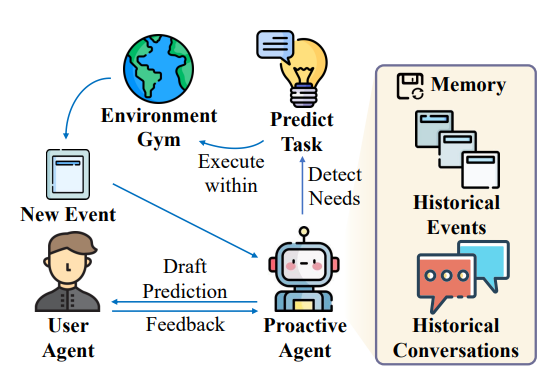

Usando este conjunto de dados, os pesquisadores treinaram um modelo de recompensa, que é como um supercomputador que "simula o cérebro humano" e pode julgar se o comportamento do agente de IA atende às expectativas humanas. Se o agente de IA tiver um bom desempenho, ele receberá uma recompensa; caso contrário, será penalizado. Após treinamento repetido, o agente de IA pode prever suas necessidades com base em seu comportamento, assim como um humano, e oferecer ajuda proativamente quando necessário.

Por exemplo, quando você recebe um e-mail de um colega sugerindo uma reunião, este agente de IA "previdente" reconhecerá automaticamente o conteúdo do e-mail e perguntará se você deseja agendar uma reunião. Se você concordar, ele agendará automaticamente a hora, o local e até mesmo enviará convites para a reunião! É muito mais "inteligente" do que os assistentes de IA atuais, não é?

Os resultados experimentais mostram que o agente de IA treinado com o conjunto de dados ProactiveBench teve um desempenho excelente. Por exemplo, o modelo Qwen2-7B-Instruct atingiu uma pontuação F1 de 66,47% na provisão proativa de ajuda, superando todos os modelos de código aberto e proprietários!

Embora este agente de IA "previdente" ainda esteja em fase de pesquisa, ele traz novas esperanças para o progresso da colaboração humano-computador no futuro. Acreditamos que, em breve, teremos um assistente de IA que realmente nos "entenda", que não apenas seja "obediente", mas também nos ajude proativamente a resolver vários problemas, tornando nossas vidas mais fáceis e convenientes!

Endereço do artigo: https://arxiv.org/pdf/2410.12361