O Google DeepMind realizou o primeiro estudo sobre os usos maliciosos mais comuns da IA, revelando que a criação de “Deepfakes” — inteligência artificial (IA) que gera imagens falsas de políticos e celebridades — é mais prevalente do que tentativas de ciberataques auxiliados por IA. Esta pesquisa, uma colaboração entre o DeepMind (departamento de IA do Google) e o Jigsaw (unidade de pesquisa e desenvolvimento do Google), visa quantificar os riscos das ferramentas de IA generativa lançadas no mercado pelas maiores empresas de tecnologia do mundo em busca de lucros exorbitantes.

Motivações de atores maliciosos relacionados à tecnologia

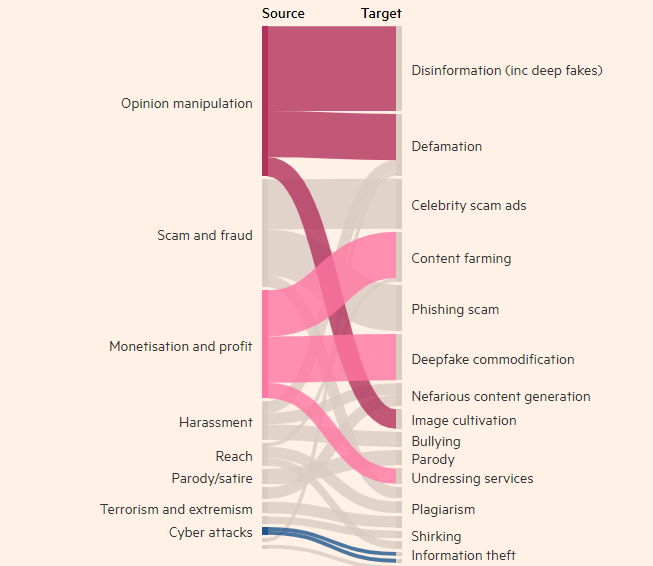

O estudo descobriu que a criação de imagens, vídeos e áudios realistas, mas falsos, de pessoas é a forma mais comum de uso indevido de ferramentas de IA generativa, quase o dobro da segunda forma mais comum, que é a falsificação de informações usando ferramentas de texto (como chatbots). O objetivo mais comum do uso indevido da IA generativa é influenciar a opinião pública, representando 27% dos casos, gerando preocupações sobre como os Deepfakes podem afetar as eleições globais este ano.

Nos últimos meses, Deepfakes do primeiro-ministro britânico Rishi Sunak e outros líderes globais apareceram no TikTok, X e Instagram. Os eleitores britânicos votarão nas eleições gerais na próxima semana. Apesar dos esforços das plataformas de mídia social para rotular ou remover esse conteúdo, as pessoas podem não reconhecê-lo como falso, e a disseminação do conteúdo pode influenciar o voto dos eleitores. Os pesquisadores do DeepMind analisaram cerca de 200 casos de uso indevido, incluindo plataformas de mídia social como X e Reddit, além de blogs online e reportagens sobre o mau uso.

O estudo descobriu que a segunda maior motivação para o uso indevido de produtos de IA generativa (como o ChatGPT da OpenAI e o Gemini do Google) é o lucro, seja oferecendo serviços de criação de Deepfakes ou usando IA generativa para criar grandes quantidades de conteúdo, como artigos de notícias falsos. A pesquisa descobriu que a maioria dos usos indevidos utiliza ferramentas facilmente acessíveis e "requerem pouca experiência técnica", o que significa que mais atores maliciosos podem abusar da IA generativa.

A pesquisa do DeepMind influenciará a melhoria da segurança de seus modelos de avaliação, e espera-se que também influencie como seus concorrentes e outras partes interessadas veem a "manifestação de danos".

Pontos importantes:

- 👉 A pesquisa do DeepMind descobriu que os Deepfakes são o principal problema de uso indevido de aplicativos de inteligência artificial.

- 👉 O objetivo mais comum do uso indevido de ferramentas de IA generativa é influenciar a opinião pública, representando 27% dos casos de uso.

- 👉 A segunda maior motivação para o uso indevido da IA generativa é o lucro, principalmente através da oferta de serviços de Deepfakes e criação de notícias falsas.