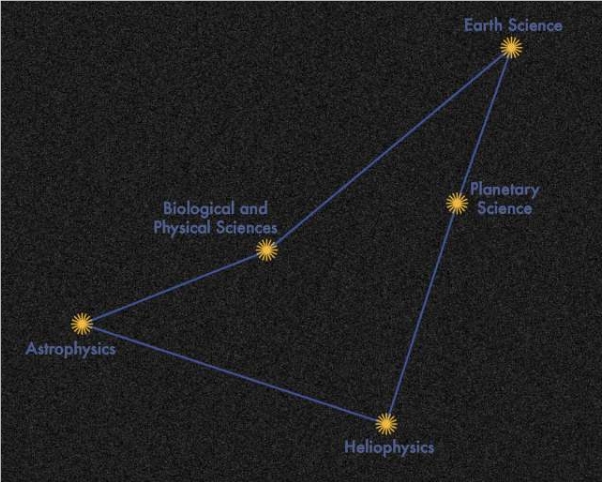

A equipe de Implementação e Conceitos Avançados (IMPACT) da NASA, por meio de acordos da Lei Espacial com parceiros privados e não federais, desenvolveu em conjunto o INDUS, um grande modelo de linguagem (LLM) voltado para áreas como ciências da Terra, ciências biológicas e físicas, física solar, ciências planetárias e astrofísica. O modelo foi treinado usando literatura científica selecionada de diversas fontes de dados.

O INDUS inclui dois tipos de modelos: codificador e conversor de frases. O codificador converte texto em linguagem natural em códigos numéricos que podem ser processados pelo LLM. O codificador INDUS foi treinado em um corpus de 6 bilhões de tokens contendo dados de astrofísica, ciências planetárias, ciências da Terra, física solar, ciências biológicas e ciências físicas. Um tokenizador personalizado, desenvolvido pela equipe de colaboração IMPACT-IBM, melhorou o tokenizador genérico, identificando termos científicos como biomarcadores e fosforilação. Mais da metade das 50.000 palavras do INDUS são exclusivas das áreas científicas específicas usadas em seu treinamento. O modelo de codificador INDUS foi usado para ajustar aproximadamente 268 milhões de pares de texto, incluindo título/resumo e pergunta/resposta.

Ao fornecer ao INDUS vocabulário específico do domínio, a equipe IMPACT-IBM alcançou desempenho superior ao de LLMs abertos e não específicos do domínio em benchmarks de tarefas biomédicas, benchmarks de perguntas e respostas científicas e testes de reconhecimento de entidades de ciências da Terra. Através do design de tarefas de linguagem diversificadas e geração aprimorada por recuperação, o INDUS consegue lidar com perguntas de pesquisadores, recuperar documentos relevantes e gerar respostas. Para aplicações sensíveis a atrasos, a equipe desenvolveu versões menores e mais rápidas dos modelos de codificador e conversor de frases.

Testes de validação mostraram que o INDUS conseguiu recuperar parágrafos relevantes da literatura científica ao responder a um conjunto de testes com aproximadamente 400 perguntas da NASA. O pesquisador da IBM, Bishwaranjan Bhattacharjee, comentou sobre a abordagem geral: "Conseguimos um desempenho excepcional ao possuir não apenas um vocabulário personalizado, mas também um grande modelo de codificador treinado especificamente e uma boa estratégia de treinamento. Para as versões menores e mais rápidas, usamos a busca de arquitetura neural para obter a arquitetura do modelo e o treinamento por destilação de conhecimento com a supervisão de um modelo maior."

Destaques:

- 🚀A NASA e a IBM colaboraram no desenvolvimento do grande modelo de linguagem INDUS, aplicável a áreas como ciências da Terra, ciências biológicas e físicas, física solar, ciências planetárias e astrofísica.

- 🎓O INDUS inclui dois tipos de modelos: codificador e conversor de frases. Ele foi treinado usando um tokenizador personalizado e um corpus de 6 bilhões de tokens, e ajustado em aproximadamente 268 milhões de pares de texto.

- 💡O INDUS, através de vocabulário específico do domínio e design de tarefas de linguagem diversificadas e geração aprimorada por recuperação, superou o desempenho de LLMs abertos e não específicos do domínio. Ele consegue lidar com perguntas de pesquisadores, recuperar documentos relevantes e gerar respostas.