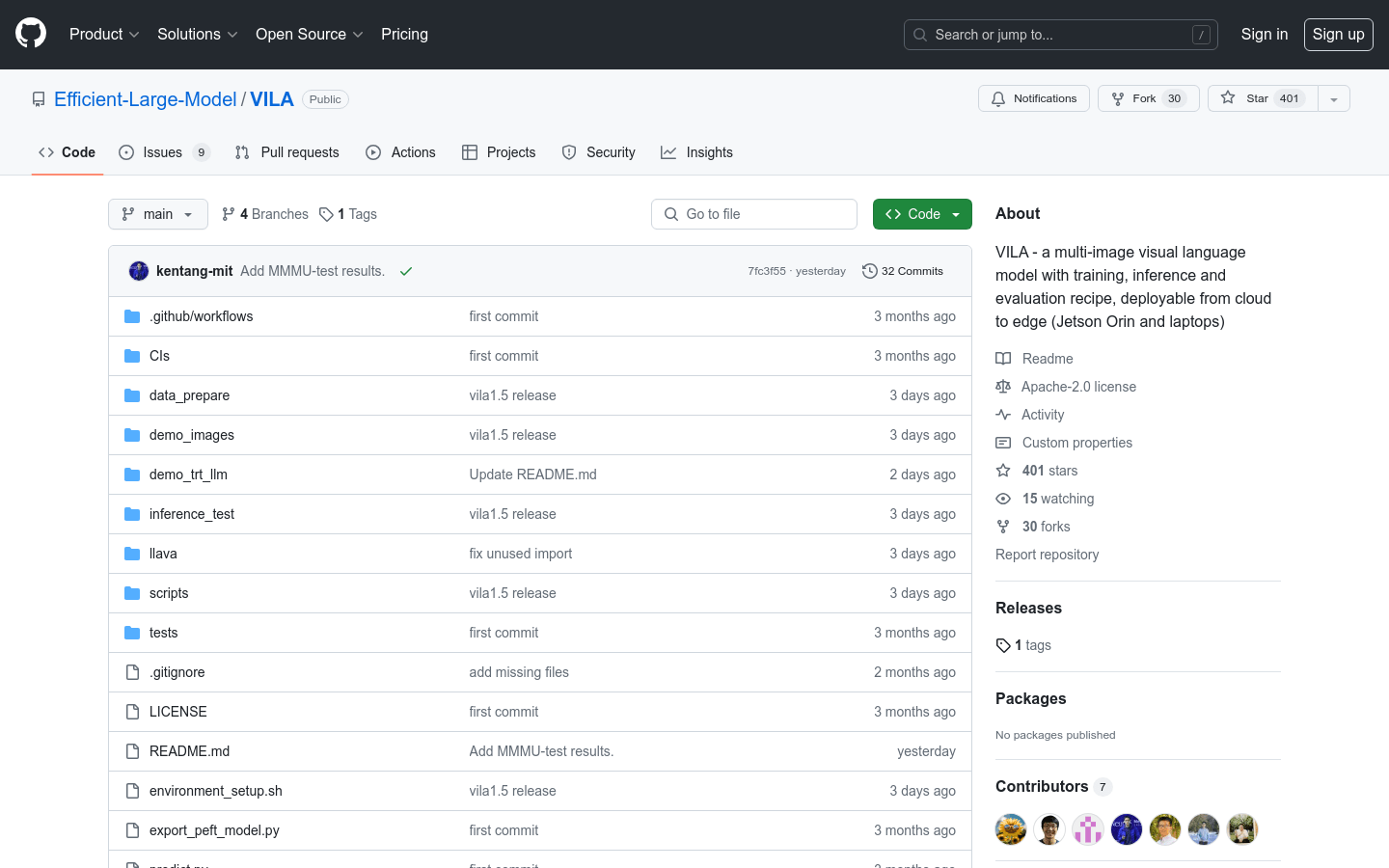

VILA

Modèle de langage visuel multi-image, comprenant des schémas d'entraînement, d'inférence et d'évaluation, déployable du cloud aux périphériques (tels que Jetson Orin et les ordinateurs portables).

VILA Dernière situation du trafic

Nombre total de visites mensuelles

521149929

Taux de rebond

35.96%

Nombre moyen de pages par visite

6.1

Durée moyenne de la visite

00:06:29