当Llama3.1开源的消息还在耳边回响,OpenAI又来抢风头了。从现在起,每天200万训练token免费微调模型,直到9月23日。这不仅是对开发者的慷慨解囊,更是对AI技术进步的一次大胆推动。

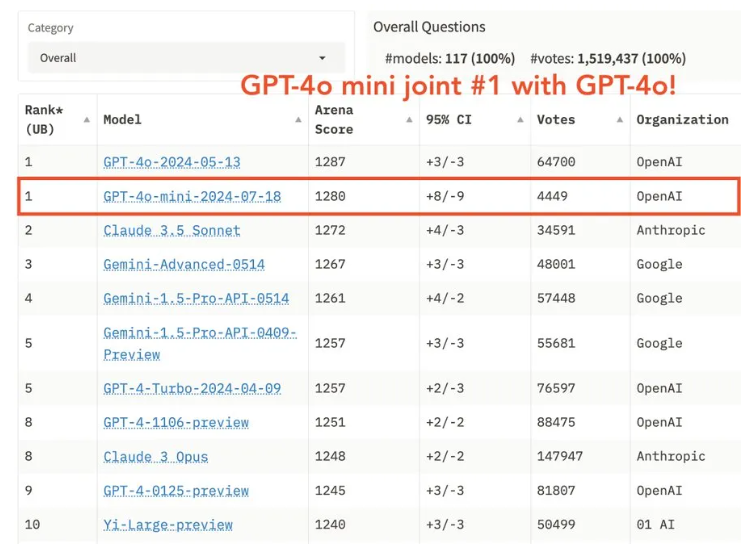

GPT-4o mini的问世,让无数开发者激动不已。它在大模型竞技场LMSYS排名中与GPT-4o并列第一,性能强悍,价格却只有GPT-4o的1/20。OpenAI的这一举措,无疑是对AI领域的一次重大利好。

收到邮件的开发者们激动地奔走相告,这么大的羊毛一定要赶快薅。OpenAI宣布,7月23日-9月23日期间,开发者们每天可以免费使用200万训练token。超过的部分,将会按3美元百万token收费。

更实惠:GPT-4o mini的输入Token费用比GPT-3.5Turbo低90%,输出Tokens费用低80%。即使在免费期结束后,GPT-4o mini的训练成本也比GPT-3.5Turbo低一半。

更长上下文:GPT-4o mini的训练上下文长度为65k Token,是GPT-3.5Turbo的4倍,推理上下文长度为128k Token,是GPT-3.5Turbo的8倍。

更聪明且更有能力:GPT-4o mini比GPT-3.5Turbo更聪明,并且支持视觉功能(尽管目前微调仅限于文本)。

GPT-4o mini微调功能将向企业客户,以及Tier4和Tier5开发者开放,未来将逐渐扩大访问权限,扩展至所有级别的用户。OpenAI已经放出了微调指南,方便开发者快速上手。

一部分网友对此并不看好,他们认为这是OpenAI在收集数据,训练和改进AI模型。而另一些网友则认为,GPT-4o mini的胜利是一个实质性的证据,证明了AI已经变得足够聪明,甚至可以愚弄我们。

GPT-4o mini的发布和免费微调政策,无疑将推动AI技术的进一步发展和普及。对于开发者来说,这是一个千载难逢的机会,能够以更低的成本,搭建更强大的应用。而对于AI技术本身,这是否意味着一个新的里程碑?让我们拭目以待。

微调文档:https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-integrations