最近,书生·浦语灵笔(InternLM-XComposer)多模态大模型升级2.5版本,这款由上海人工智能实验室领衔研发的模型,以其卓越的长上下文输入和输出能力,为文本图像理解和创作应用带来了革命性的突破。

IXC-2.5能够在长达96K的长上下文中游刃有余,这得益于其训练时使用的24K交错图像-文本数据。这种长上下文能力,让IXC-2.5在需要广泛输入和输出上下文的任务中表现出色。

与前一版本相比,IXC-2.5在视觉语言理解方面进行了三项重大升级:

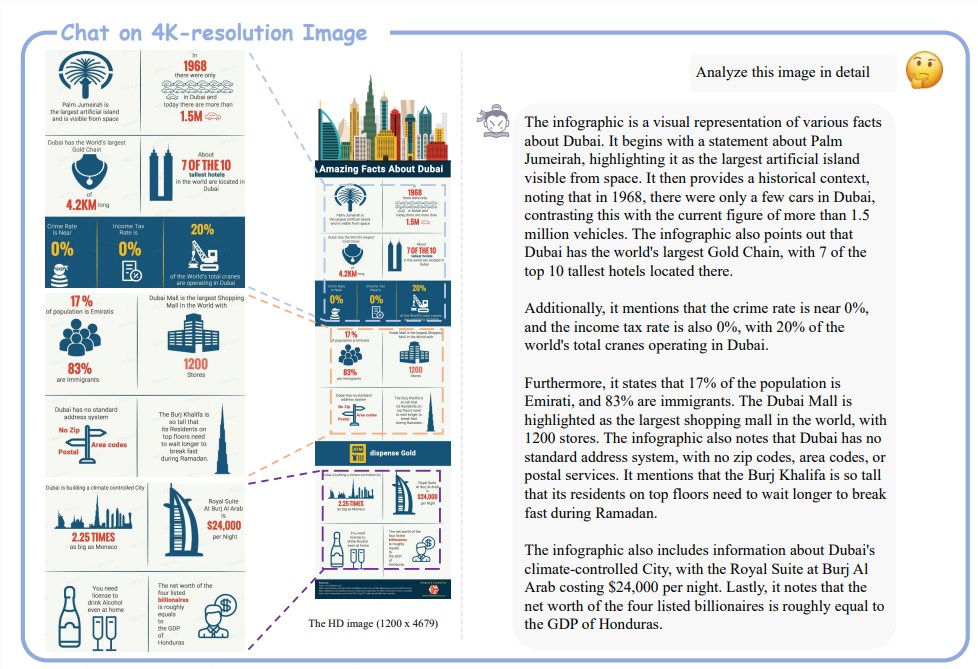

超高分辨率理解:IXC-2.5通过内生的560×560ViT视觉编码器,支持任意纵横比的高分辨率图像。

细粒度视频理解:将视频视为由数十到数百帧组成的超高分辨率复合图像,通过密集采样和更高分辨率捕捉细节。

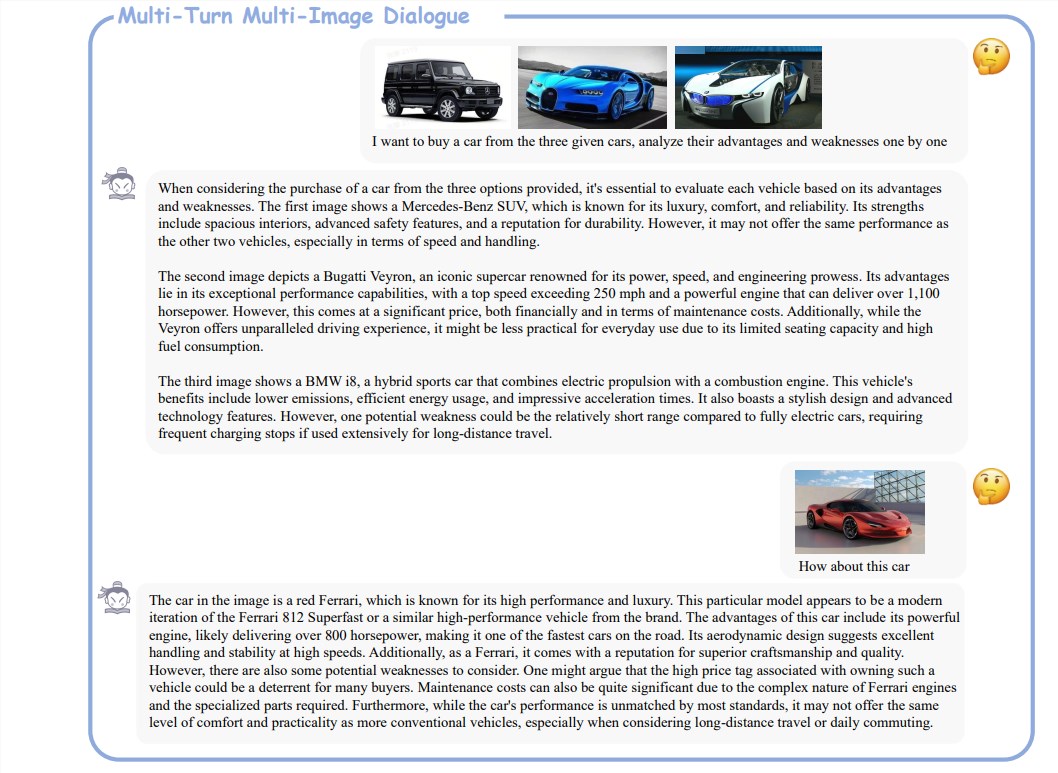

多轮多图对话:支持自由形式的多轮多图对话,与人类进行自然互动。

除了理解能力的提升,IXC-2.5还扩展了两项引人注目的应用,使用额外的LoRA参数进行文本图像创作:

制作网页:根据文本图像指令,IXC-2.5能够编写HTML、CSS和JavaScript源代码,创建网页。

撰写高质量图文文章:利用特别设计的Chain-of-Thought(CoT)和Direct Preference Optimization(DPO)技术,显著提升写作内容的质量。

IXC-2.5在28个基准测试中进行了评估,它在16个基准测试中超越了现有的开源最先进模型。此外,它在16个关键任务中与GPT-4V和Gemini Pro的表现相近或有所超越。这一成绩充分证明了IXC-2.5的强大性能和广泛的应用潜力。

论文地址:https://arxiv.org/pdf/2407.03320

项目地址:https://github.com/InternLM/InternLM-XComposer