最近,AI 视频公司 Genmo 宣布推出 Mochi1,这是一个全新的开源视频生成模型,用户可以通过文本提示生成高质量的视频。Mochi1的表现被认为与当前市场上领先的闭源竞争对手如 Runway、Luma AI 的 Dream Machine、快手的 可灵、Minimax 的 Hailuo 等等相媲美,甚至更优。

该模型在 Apache2.0许可证下开放,用户无需支付费用就能享受到尖端的视频生成技术,而其他竞争产品的收费标准则从有限的免费计划到每月高达94.99美元不等。

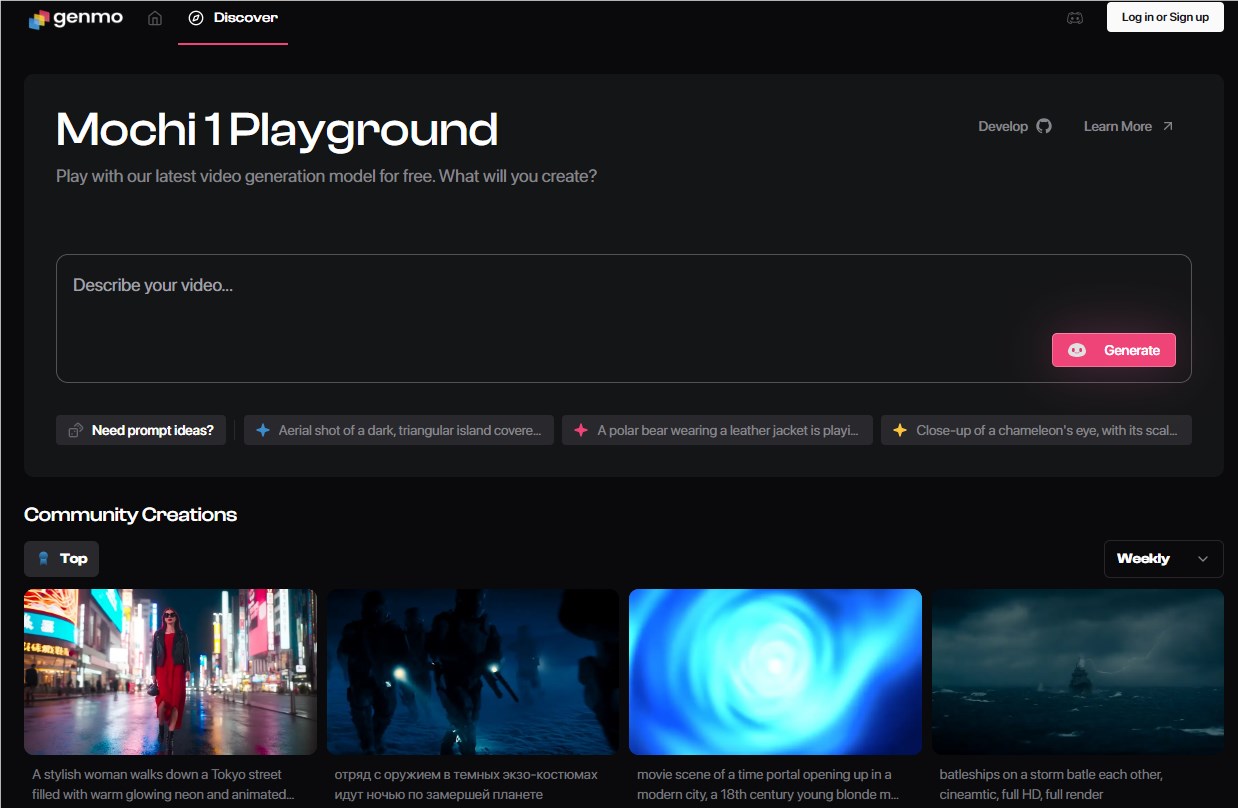

用户可以在 Hugging Face 上免费下载 Mochi1的模型权重和代码,不过,想要在个人设备上运行这个模型,至少需要四块 Nvidia H100GPU。为了让用户体验 Mochi1的功能,Genmo 还提供了一个在线的试玩平台,让大家可以亲自尝试这项新技术。

Mochi1生成的视频效果案例:

根据 Genmo 的说法,Mochi1擅长遵循详细的用户说明,允许对生成视频中的字符、设置和操作进行精确控制。Genmo 已经声称,在内部测试中,Mochi1在快速粘附和运动质量方面击败了大多数其他视频 AI 模型,包括专有的竞争对手 Runway 和 Luna。

Mochi1在视频生成领域取得了显著的进展,包括高保真运动表现和精准的提示遵循能力。Genmo 的 CEO Paras Jain 表示,他们的目标是缩小开放源代码和闭源视频生成模型之间的差距。他强调,视频是最重要的交流形式,因此他们希望将这项技术推广给更多的人。

与此同时,Genmo 还宣布完成了2840万美元的 A 轮融资,投资者包括 NEA 和多家风险投资公司。Jain 指出,视频生成不仅仅是娱乐或内容创作,还是未来机器人和自主系统的重要工具。

Mochi1的架构基于 Genmo 独创的非对称扩散变换器(AsymmDiT),这是迄今为止发布的最大开源视频生成模型,参数高达100亿。这个模型专注于视觉推理,使其在处理视频数据方面更具优势。

Mochi1生成的视频效果案例:

尽管 Mochi1已经展现出强大的功能,但目前仍有一些局限性,比如目前支持的分辨率为480p,且在复杂运动场景中可能会出现轻微的视觉失真。Genmo 计划在年内推出支持720p 分辨率的 Mochi1HD 版本,以提升用户体验。

试玩入口:https://www.genmo.ai/play

模型下载:https://huggingface.co/genmo/mochi-1-preview

划重点:

🌟 Mochi1是 Genmo 推出的开源视频生成模型,用户可免费使用,性能媲美多款闭源产品。

💰 Genmo 完成了2840万美元的 A 轮融资,旨在推动 AI 视频技术的民主化。

🎥 未来将推出 Mochi1HD 版本,解决当前480p 分辨率和复杂运动场景中的一些局限。