随着大型语言模型(LLMs)在自然语言处理(NLP)领域的广泛应用,文本生成和语言理解等任务的效果得显著提升。然而,阿拉伯语由于其复杂的词形变化、丰富的方言和文化背景,依然在语言模型的应用中被低估。

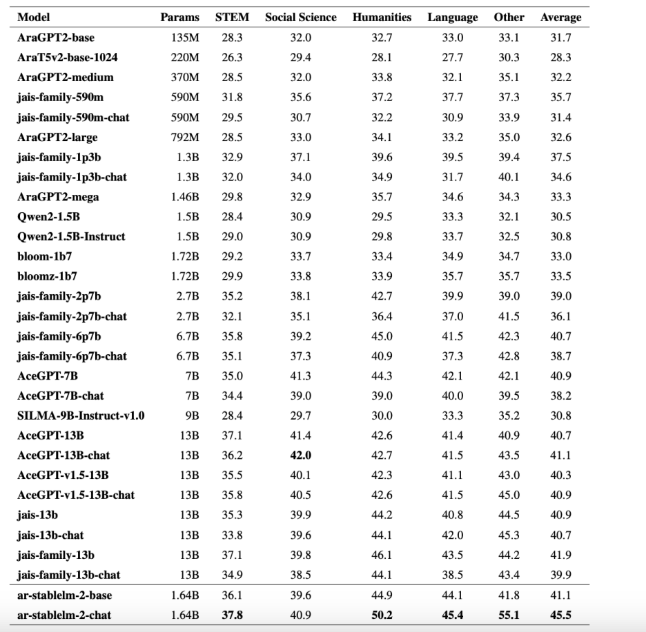

许多先进的语言模型主要针对英语,导致阿拉伯语相关模型要么过于庞大,计算需求高,要么无法充分体现文化细节。超过70亿参数的模型如 Jais 和 AceGPT 具备强大的能力,但由于资源消耗巨大,难以在广泛应用中得到推广。因此,迫切需要一种兼顾效率与性能的阿拉伯语模型。

为了解决这一问题,Stability AI 推出了阿拉伯语 Stable LM1.6B 模型,包括基础版和聊天版。这一模型作为阿拉伯语中心的 LLM,针对其规模在文化对齐和语言理解基准测试中取得了优异的成绩。与超过70亿参数的大型模型不同,阿拉伯语 Stable LM1.6B 在保持良好性能的同时,减少了计算需求。

该模型在超过1000亿个阿拉伯语文本标记上进行了精细调优,确保了现代标准阿拉伯语和各种方言的强大代表性。特别是聊天版模型在文化基准测试中表现出色,展现了较强的准确性和上下文理解能力。

Stability AI 的这一新模型融合了现实世界的指令数据集和合成对话生成,使其能够有效处理文化细腻的查询,同时在各种 NLP 任务中保持广泛的适用性。

在技术方面,阿拉伯语 Stable LM1.6B 采用了针对阿拉伯语言特点的先进预训练架构,关键设计要素包括:

标记优化 :模型使用 Arcade100k 标记器,平衡标记粒度和词汇规模,减少阿拉伯文本中的过度标记问题。

多样化数据集覆盖 :训练数据来源广泛,包括新闻文章、网络内容和电子书,确保对文学和口语阿拉伯语的全面代表。

指令调优 :数据集中包含合成的指令 - 响应对,包括重述对话和多项选择问题,提高了模型处理文化特定任务的能力。

阿拉伯语 Stable LM1.6B 模型在阿拉伯 NLP 领域标志着重要的进展,在如 ArabicMMLU 和 CIDAR-MCQ 等基准测试中取得了强劲的成绩。例如,聊天版在 ArabicMMLU 基准测试中得分45.5%,超越了参数介于7亿至130亿之间的其他模型。在 CIDAR-MCQ 基准测试中,聊天模型的表现也相当强劲,得分达到了46%。

通过结合真实和合成数据集,该模型实现了可扩展性,同时保持了实用性,适用于多种 NLP 应用。阿拉伯语 Stable LM1.6B 的推出不仅解决了阿拉伯 NLP 中的计算效率和文化对齐问题,还为阿拉伯语自然语言处理任务提供了可靠的工具。

聊天模型:https://huggingface.co/stabilityai/ar-stablelm-2-chat

基础模型:https://huggingface.co/stabilityai/ar-stablelm-2-base

论文:https://arxiv.org/abs/2412.04277

划重点:

🌟 阿拉伯语 Stable LM1.6B 模型旨在解决阿拉伯语 NLP 中的计算效率与文化对齐问题。

📈 该模型在多个基准测试中表现优异,超越了许多更大参数的模型。

🌐 Stability AI 通过融合现实数据合成数据,实现了阿拉伯语模型的实用性与可扩展性。