在多模态人工智能领域,智源研究院与多所高校合作推出了全新的多模态向量模型 BGE-VL,标志着多模态检索技术的一次重大突破。自发布以来,BGE 系列模型便获得了广泛赞誉,而 BGE-VL 的推出则进一步丰富了这一生态系统。该模型在图文检索、组合图像检索等多项关键任务中表现出色,展现出其卓越的性能。

BGE-VL 的成功归功于其背后的 MegaPairs 数据合成技术。这一创新方法通过挖掘现有的大规模图文数据,自动生成高质量的多模态三元组数据,显著提升了数据的可扩展性和质量。MegaPairs 能够以极低的成本生成多样化的数据集,其包含超过2600万条样本,为多模态检索模型的训练提供了丰厚的基础。这一技术让 BGE-VL 在多个主流多模态检索基准上都取得了领先成绩。

在多模态检索日益受到重视的今天,用户对信息的获取需求愈发多样化。以往的检索模型多依赖于单一的图文对进行训练,无法有效应对复杂的组合输入。而 BGE-VL 通过引入 MegaPairs 数据,克服了这一局限,使得模型能够更全面地理解和处理多模态查询。

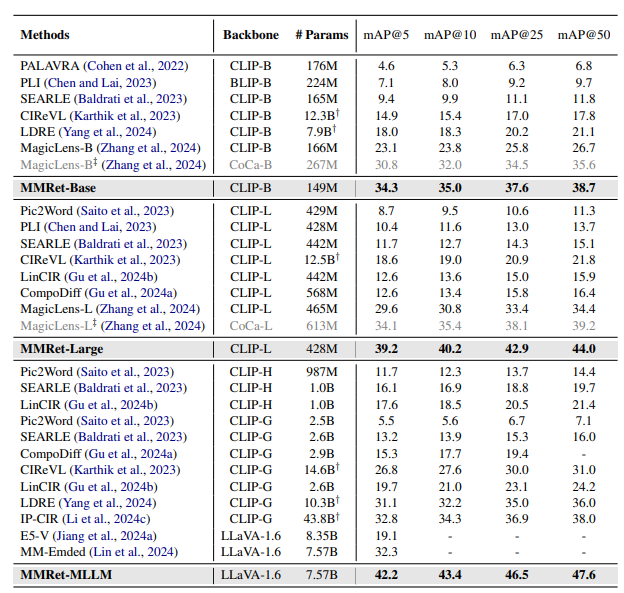

智源团队在多个任务的性能评测中,发现 BGE-VL 模型在 Massive Multimodal Embedding Benchmark(MMEB)上的零样本性能表现优异,尽管 MegaPairs 未涵盖 MMEB 中的大部分任务,但其任务泛化能力依然令人振奋。此外,在组合图像检索的评测中,BGE-VL 同样表现突出,大幅超过了众多知名模型,如谷歌的 MagicLens 和英伟达的 MM-Embed。

未来,智源研究院计划继续深化 MegaPairs 技术,结合更丰富的多模态检索场景,致力于打造更加全面和高效的多模态检索器,为用户提供更为精准的信息服务。随着多模态技术的发展,BGE-VL 的推出无疑将推动相关领域的进一步探索与创新。

论文地址:https://arxiv.org/abs/2412.14475

项目主页:https://github.com/VectorSpaceLab/MegaPairs

模型地址:https://huggingface.co/BAAI/BGE-VL-MLLM-S1