相关AI新闻推荐

美国AI监管大变革!特朗普上任首日撤销拜登AI行政令

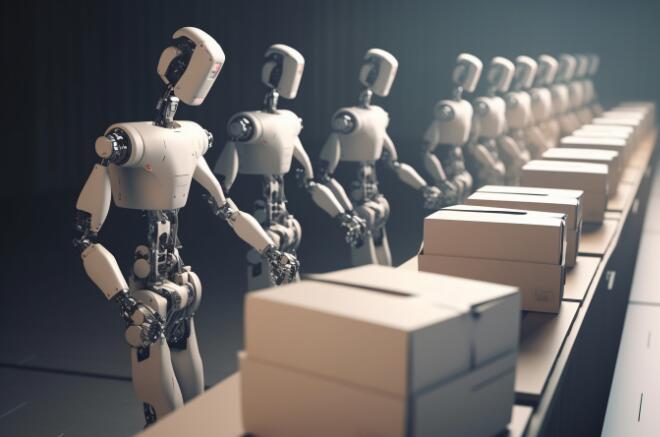

在特朗普总统上任的第一天,他宣布撤销了前总统拜登于2023年签署的一项行政令,该行政令旨在降低人工智能(AI)对消费者、工人和国家安全可能带来的风险。拜登的这项行政令指示美国商务部下属的国家标准与技术研究所(NIST)制定指导方针,帮助企业识别和纠正其 AI 模型中的缺陷,包括偏见。此外,该行政令还要求 AI 系统的开发者在将其产品公开发布之前,必须向美国政府提交安全测试的结果。图源备注:图片由AI生成,图片授权服务商Midjourney然而,特朗普的支持者对此提出了批评

英国希望在AI监管上“走自己的路”,计划与欧盟和美国分道扬镳

在人工智能(AI)监管方面,英国政府表示希望采取独立的立场,计划与其主要西方同行(如欧盟和美国)采取不同的做法。英国 AI 与数字政府部长费里亚尔・克拉克(Feryal Clark)在接受 CNBC 采访时强调,英国必须 “做自己的事情”,确保在 AI 模型的安全性方面,早期就进行必要的监管。图源备注:图片由AI生成,图片授权服务商Midjourney克拉克提到,英国政府已经与一些 AI 公司(如 OpenAI 和 Google DeepMind)建立了良好的关系,这些公司自愿向政府开放其模型进行安全性测试。她表示:“在模型开发

OpenAI发布AI经济蓝图,呼吁美国加强监管与发展

OpenAI 于近日发布了一份名为 “经济蓝图” 的文档,旨在与美国政府及其盟国共同探讨政策,以巩固美国在人工智能领域的技术领导地位。蓝图中提到,美国必须吸引数十亿美元的资金,以获取芯片、数据、能源和人才,从而在 AI 竞争中取得胜利。OpenAI 全球事务副总裁克里斯・莱哈内(Chris Lehane)在前言中表示,虽然一些国家对 AI 及其经济潜力采取了回避态度,但美国政府可以为本国的 AI 产业铺平道路,确保其在创新方面继续保持全球领先,同时保护国家安全。目前,联邦政府在 AI 监

泰国工业部引入AI监管!每日可检测10万件网售假冒伪劣商品

泰国工业部近日宣布,将引入人工智能(AI)系统来加强对在线平台销售的假冒伪劣商品的监管。工业部阿卡纳特·普罗姆潘的秘书Pongpol Yodmuangcharoen周三表示,该部门的技术与工业改革创新委员会在 12 月 20 日的会议上讨论了这一方案。委员会在 12 月 20 日的第二次会议上了解到,一项研究表明,工业部的AI系统每天可以监控和检测 10 万件通过在线平台销售的不合格消费品,而目前人工官员每天只能检测 1600 件。Pongpol解释说,阿卡纳特成立该委员会是为了解决涌入泰国市场的廉价劣质产品