相关AI新闻推荐

成本不足50美元!研究人员训练出AI推理模型s1,媲美OpenAI的o1

近期,斯坦福大学和华盛顿大学的 AI 研究人员成功训练出了一款名为 s1的 AI 推理模型,训练成本不足50美元,所需的云计算信用额度也非常低。这项研究成果于上周五发布,表明 s1在数学和编程能力测试上表现不逊于 OpenAI 的 o1模型和 DeepSeek 的 R1模型。s1的代码和数据已在 GitHub 上公开,供其他研究者使用。研究团队表示,他们从一个现成的基础模型出发,通过蒸馏技术进行微调,以提取出所需的推理能力。s1的蒸馏过程使用了谷歌的 Gemini2.0Flash Thinking Experimental 模型,这种方法与加州大学

Pipeshift推出模块化推理引擎,实现AI推理GPU使用率降低75%

近日,初创公司 Pipeshift 推出了一款全新的端到端平台,旨在帮助企业更高效地训练、部署和扩展开源生成式 AI 模型。该平台不仅可以在任何云环境或本地 GPU 上运行,还能够显著提升推理速度和降低成本。随着 AI 技术的迅猛发展,许多企业面临着如何在多种模型之间高效切换的挑战。传统上,团队需要构建一个复杂的 MLOps 系统,涉及计算资源的获取、模型训练、精调以及生产级部署等多个环节,这不仅需要花费大量的时间和工程资源,还可能导致基础设施的管理成本不断增加。Pipeshift

OpenAI CEO 奥特曼辟谣:AGI并未到来,期望值需降低

近日,OpenAI CEO 萨姆・奥特曼在社交平台 X 上就 “OpenAI 已实现通用人工智能(AGI)” 的说法做出了明确否认。他表示,尽管外界对 AGI 的讨论愈演愈烈,但 OpenAI 下个月不会部署 AGI,也并未开发出这一技术。奥特曼提醒大家,应该将期望值降低 “100倍”。AGI,即通用人工智能,指的是一种能够理解、学习并执行任何人类智力任务的人工智能。近期,一些 AI 粉丝错误地将 OpenAI 员工发布的一些内容解读为已实现 AGI 的证据,导致了众多误解。虽然 OpenAI 确实正在努力推出一系列新型 AI 推理模

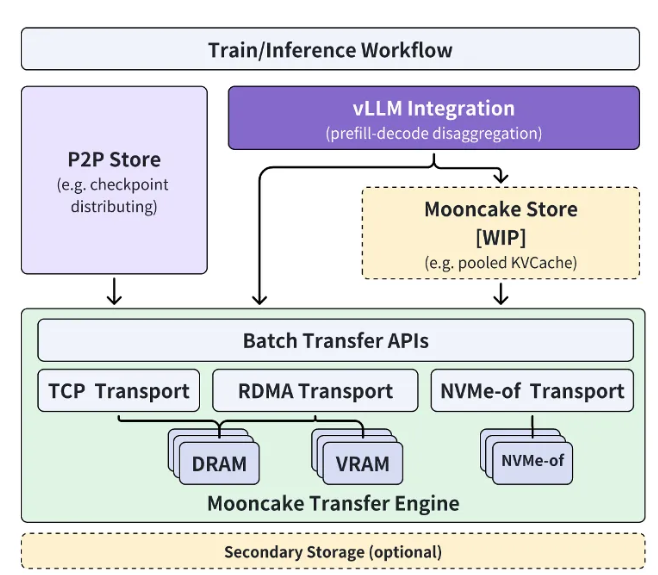

Kimi联手清华开源大模型推理架构Mooncake 提升AI推理效率

在人工智能迅速发展的时代,大型模型的智能化水平不断提升,但随之而来的推理系统效率挑战也越来越明显。如何应对高推理负载、降低推理成本、缩短响应时间,已成为业界共同面对的重要问题。Kimi 公司联合清华大学的 MADSys 实验室,推出了基于 KVCache 的 Mooncake 推理系统设计方案,该方案于2024年6月正式发布。Mooncake 推理系统通过创新的 PD 分离架构和以存换算为中心的理念,显著提升了推理的吞吐能力,吸引了广泛的行业关注。为了进一步推动这一技术框架的应用与普及,Kimi 与清华