相关AI新闻推荐

一体化 AI 框架Sa2VA:实现图像与视频的深度理解

在多模态大语言模型(MLLMs)的推动下,图像和视频相关的任务取得了革命性的进展,包括视觉问答、叙述生成和交互式编辑等。然而,实现细粒度的视频内容理解仍然面临重大挑战。这一挑战涉及像素级的分割、带有语言描述的跟踪,以及在特定视频提示上进行视觉问答等任务。尽管当前最先进的视频感知模型在分割和跟踪任务上表现出色,但它们在开放式语言理解和对话能力方面仍显不足。此外,视频 MLLMs 在视频理解和问答任务上表现良好,但在处理感知任务和视觉提示方面依然力不

智谱GLM-4-9B模型幻觉率仅1.3%,在全球大模型评测中夺魁

在人工智能领域,大语言模型的"幻觉问题"一直是困扰业界的关键挑战。近日,一项基于HHEM-2.1-Open评估体系的测试结果显示,智谱AI旗下的GLM-4-9B模型交出了一份令人瞩目的成绩单。测试数据显示,在参与评估的85个大语言模型中,GLM-4-9B以98.7%的事实一致性率和100%的回答率摘得桂冠。特别值得关注的是,该模型的幻觉率仅为1.3%,这一成绩不仅位居榜首,更是超越了行业巨头OpenAI的GPT系列和Google的Gemini系列模型。图源备注:图片由AI生成,图片授权服务商Midjourney这一突破性成果标志着中国大

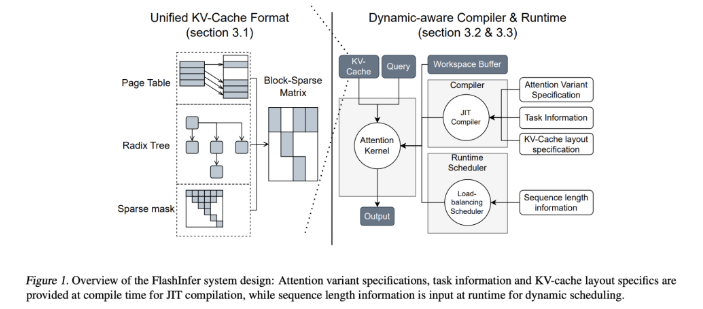

NVIDIA联合高校发布 “FlashInfer”:提升大语言模型推理效率的全新内核库

随着大语言模型(LLM)在现代人工智能应用中的广泛应用,诸如聊天机器人和代码生成器等工具依赖于这些模型的能力。然而,随之而来的推理过程中的效率问题也日益突出。尤其是在处理注意力机制时,如 FlashAttention 和 SparseAttention,面对多样化的工作负载、动态输入模式以及 GPU 资源限制时,往往显得力不从心。这些挑战加上高延迟和内存瓶颈,迫切需要更高效、灵活的解决方案,以支持可扩展和响应迅速的 LLM 推理。为了解决这一问题,来自华盛顿大学、NVIDIA、Perplexity AI 和卡内基梅

元始智能RWKV获数千万天使轮融资,力求打破Transformer架构的限制

在2022年全球生成式 AI 浪潮的背景下,元始智能(RWKV)于2023年12月完成数千万人民币的天使轮融资,由天际资本投资。此次融资后,公司估值翻倍,资金将用于团队扩展、新架构研发及产品商业化。RWKV 的出现,是对传统 Transformer 架构的一次有力挑战。随着大语言模型(LLM)的发展,虽然模型的参数规模日益庞大,但其在幻觉和准确率等问题上的短板始终难以解决。因此,RWKV 的创始团队决定探索一种全新的架构,以期实现更高的效率和灵活性。RWKV 的设计理念与 Transformer 截然不同。联合