相关AI新闻推荐

阿里国际开源Ovis2系列多模态大语言模型 共有六个版本

Ovis2 是阿里巴巴国际化团队提出的Ovis系列模型的最新版本。与前序1. 6 版本相比,Ovis2 在数据构造和训练方法上都有显著改进。它不仅强化了小规模模型的能力密度,还通过指令微调和偏好学习大幅提升了思维链(CoT)推理能力。此外,Ovis2 引入了视频和多图像处理能力,并增强了多语言能力和复杂场景下的OCR能力,显著提升了模型的实用性。

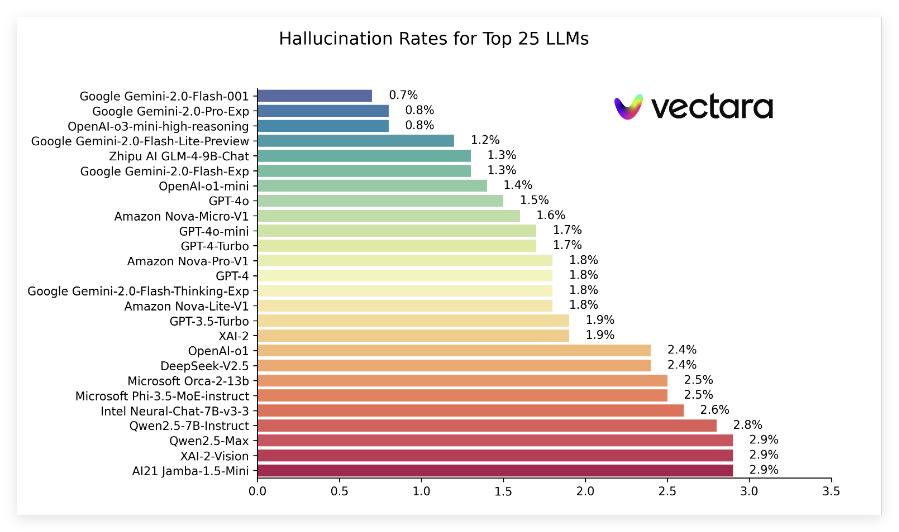

AI大语言模型幻觉排行榜:Gemini 2.0 Flash幻觉最低

近日,Vectara 发布了一份名为 “幻觉排行榜” 的报告,比较了不同大型语言模型(LLM)在总结短文档时产生幻觉的表现。这份排行榜利用了 Vectara 的 Hughes 幻觉评估模型(HHEM-2.1),该模型定期更新,旨在评估这些模型在摘要中引入虚假信息的频率。根据最新数据,报告指出了一系列流行模型的幻觉率、事实一致性率、应答率以及平均摘要长度等关键指标。在最新的排行榜中,谷歌的 Gemini2.0系列表现出色,尤其是 Gemini-2.0-Flash-001,以0.7% 的低幻觉率位居榜首,显示出其在处理文档时几乎没有引

昆仑万维旗下Opera接入DeepSeek R1模型 支持本地个性化部署

2月17日,昆仑万维旗下的Opera团队在Opera Developer中接入了DeepSeek R1系列模型,实现了本地个性化部署。这一举措标志着Opera在AI技术应用方面的进一步拓展,为用户提供了更强大的本地AI功能。

Grok-3正式发布:马斯克"钞能力"催生AI新王座挑战者

埃隆·马斯克旗下xAI公司正式发布Grok系列第三代大语言模型,在AI领域掀起新一轮技术海啸。这款被开发者称为"当下地表最强"的模型,或将重塑全球AI竞争格局。据官方披露,Grok-3在多项核心指标上已超越现有主流模型,测试用户反馈其实际表现达到"o3-full"基准水平。但这份技术突破背后是惊人的算力投入——其训练消耗的算力资源达到中国深度求索公司DeepSeek V3模型的263倍,如此悬殊的资源差距令国内研发团队直言"望洋兴叹"。本次发布呈现出完整的产品生态:- **推理专用版本**:针对企业