Die kürzlich von DeepSeek veröffentlichten Modellreihen haben weltweit für Aufsehen in der KI-Branche gesorgt. DeepSeek-V3 erreicht mit geringen Kosten eine hohe Leistung und ist in mehreren Tests mit Top-Closed-Source-Modellen vergleichbar; DeepSeek-R1 hingegen zeigt durch innovative Trainingsmethoden eine starke Inferenzfähigkeit, die mit der offiziellen Version von OpenAI o1 mithalten kann, und veröffentlicht zudem die Modellgewichte, was der KI-Branche neue Durchbrüche und Denkanstöße liefert.

DeepSeek hat auch alle Trainingstechniken öffentlich zugänglich gemacht. R1 ist vergleichbar mit dem o1-Modell von OpenAI, wobei im Nachtrainingsphase intensiv Reinforcement-Learning-Techniken eingesetzt wurden. DeepSeek erklärt, dass R1 in Aufgaben wie Mathematik, Code und natürlichsprachlicher Inferenz mit o1 vergleichbar ist und der API-Preis weniger als 4 % von o1 beträgt.

DeepSeek R1 ist zu stark! Meta-Ingenieure in Panik: Wilde Demontageversuche zur Replikation

Kürzlich wurde ein anonymer Beitrag eines Meta-Mitarbeiters mit dem Titel „Meta genai org in panic mode“ auf der anonymen beruflichen Online-Community teamblind besonders populär. Die Einführung von DeepSeek V3 hat Llama 4 in Benchmark-Tests deutlich hinter sich gelassen, und das Meta-Team für generative KI ist in Panik. Ein „unbekanntes chinesisches Unternehmen“ hat mit einem Trainingsbudget von 5,5 Millionen US-Dollar bestehende große Modelle in den Schatten gestellt.

Meta-Ingenieure zerlegen DeepSeek fieberhaft, um es zu replizieren, während das Management sich Sorgen macht, wie es die hohen Kosten der Geschäftsführung gegenüber erklären soll, da die Gehälter der „Führungskräfte“ ihres Teams mehrere Dutzend Mal höher sind als die Trainingskosten von DeepSeek V3. Das Erscheinen von DeepSeek R1 verschärft die Lage noch. Obwohl einige Informationen noch nicht preisgegeben werden können, werden sie bald veröffentlicht, und dann könnte die Situation noch ungünstiger werden.

Übersetzung des anonymen Beitrags eines Meta-Mitarbeiters (übersetzt von DeepSeek R1):

Die Abteilung für generative KI bei Meta befindet sich im Notfallmodus

Alles begann mit DeepSeek V3 – es ließ die Benchmark-Ergebnisse von Llama 4 sofort veraltet erscheinen. Noch peinlicher ist, dass „ein unbekanntes chinesisches Unternehmen mit einem Trainingsbudget von nur 5 Millionen US-Dollar“ einen solchen Durchbruch erzielt hat.

Das Ingenieurteam zerlegt die DeepSeek-Architektur fieberhaft, um alle technischen Details zu replizieren. Das ist keine Übertreibung, unser Code-Repository wird einer gründlichen Durchsuchung unterzogen.

Das Management ist verzweifelt auf der Suche nach einer Rechtfertigung für die enormen Ausgaben der Abteilung. Wie sollen sie der Geschäftsführung Rechenschaft ablegen, wenn das Jahresgehalt jedes „Führungskraft“ in der Abteilung für generative KI die gesamten Trainingskosten von DeepSeek V3 übersteigt und wir Dutzende solcher „Führungskräfte“ beschäftigen?

DeepSeek R1 verschärft die Lage weiter. Vertrauliche Informationen können zwar nicht preisgegeben werden, aber die entsprechenden Daten werden in Kürze veröffentlicht.

Was eigentlich ein schlankes, technisch orientiertes Team sein sollte, ist durch den Zustrom vieler Mitarbeiter, die um Einfluss ringen, zu einer künstlich aufgeblähten Organisationsstruktur geworden. Das Ergebnis dieses Machtspiels? Am Ende verlieren alle.

Kurzübersicht der DeepSeek-Modellreihe

DeepSeek-V3: Ein Mixed-Expert-(MoE)-Sprachmodell mit 671 Milliarden Parametern, wobei pro Token 37 Milliarden aktiviert werden. Es verwendet Multi-head Latent Attention (MLA) und die DeepSeekMoE-Architektur, wurde mit 14,8 Billionen hochwertigen Token vortrainiert und durch überwachtes Feintuning und Reinforcement Learning optimiert. In mehreren Tests übertrifft es einige Open-Source-Modelle und ist mit Top-Closed-Source-Modellen wie GPT-4o und Claude 3.5 Sonnet vergleichbar. Die Trainingskosten sind niedrig, nur 278,8 Millionen H800 GPU-Stunden, etwa 5,576 Millionen US-Dollar, und der Trainingsprozess ist stabil.

DeepSeek-R1: Umfasst DeepSeek-R1-Zero und DeepSeek-R1. DeepSeek-R1-Zero wurde durch groß angelegtes Reinforcement Learning trainiert, ohne überwachtes Feintuning (SFT), und zeigt Fähigkeiten zur Selbstverifikation und Selbstreflexion, weist aber Probleme mit geringer Lesbarkeit und Sprachvermischung auf. DeepSeek-R1 baut auf DeepSeek-R1-Zero auf, führt mehrstufiges Training und Kaltstartdaten ein und behebt einige Probleme. In Aufgaben wie Mathematik, Code und natürlichsprachlicher Inferenz ist es mit der offiziellen Version von OpenAI o1 vergleichbar. Gleichzeitig werden auch mehrere Modelle unterschiedlicher Größen veröffentlicht, um die Entwicklung der Open-Source-Community zu fördern.

Was macht DeepSeek so besonders?

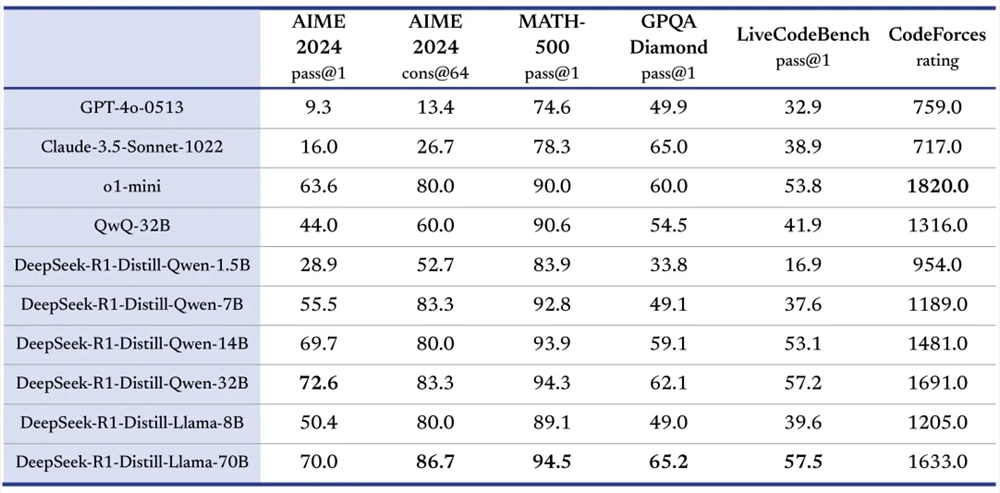

Herausragende Leistung: DeepSeek-V3 und DeepSeek-R1 zeigen in mehreren Benchmark-Tests hervorragende Ergebnisse. So erzielt DeepSeek-V3 in Tests wie MMLU und DROP hervorragende Ergebnisse; DeepSeek-R1 erreicht in Tests wie AIME 2024 und MATH-500 eine hohe Genauigkeit und ist mit der offiziellen Version von OpenAI o1 vergleichbar oder übertrifft diese sogar in einigen Bereichen.

Trainingsinnovation:

DeepSeek-V3 verwendet eine lastenausgleichende Strategie ohne Hilfsverlust und mehrere Token-Vorhersageziele (MTP), um Leistungseinbußen zu reduzieren und die Modellleistung zu verbessern; durch das Training mit FP8 wird dessen Durchführbarkeit bei großen Modellen bestätigt.

DeepSeek-R1-Zero wird durch reines Reinforcement Learning trainiert, optimiert das Modell nur mit einfachen Belohnungs- und Bestrafungssignalen und beweist, dass Reinforcement Learning die Inferenzfähigkeit des Modells verbessern kann; DeepSeek-R1 nutzt auf dieser Basis Kaltstartdaten zum Feintuning, um die Stabilität und Lesbarkeit des Modells zu verbessern.

Open Source und Sharing: Die DeepSeek-Modellreihe verfolgt das Open-Source-Prinzip und veröffentlicht die Modellgewichte, z. B. DeepSeek-V3 und DeepSeek-R1 sowie deren destillierte kleineren Modelle. Benutzer können mit Hilfe der Destillationstechnik R1 zum Trainieren anderer Modelle verwenden und so den Austausch und die Innovation von KI-Technologien fördern.

Vorteile in verschiedenen Bereichen: DeepSeek-R1 zeigt starke Fähigkeiten in verschiedenen Bereichen. Im Bereich Code erreicht es auf der Codeforces-Plattform eine hohe Bewertung und übertrifft die meisten menschlichen Teilnehmer; bei Aufgaben der Verarbeitung natürlicher Sprache zeigt es eine hervorragende Leistung bei verschiedenen Aufgaben zum Textverständnis und zur Textgenerierung.

Hohes Preis-Leistungs-Verhältnis: Die API-Preise der DeepSeek-Modellreihe sind erschwinglich. So sind die Ein- und Ausgabepreise der DeepSeek-V3-API deutlich niedriger als bei vergleichbaren Modellen; auch die Preisgestaltung des DeepSeek-R1-API-Dienstes ist wettbewerbsfähig und senkt die Kosten für Entwickler.

Anwendungsbereiche von DeepSeek-R1

Aufgaben der Verarbeitung natürlicher Sprache: Dazu gehören Textgenerierung, Frage-Antwort-Systeme, maschinelle Übersetzung, Textzusammenfassung usw. In Frage-Antwort-Systemen kann DeepSeek-R1 beispielsweise Fragen verstehen und mit seinen Inferenzfähigkeiten genaue Antworten geben; bei Aufgaben zur Textgenerierung kann es hochwertige Texte zu einem gegebenen Thema generieren.

Code-Entwicklung: Hilft Entwicklern beim Schreiben von Code, Debuggen von Programmen und Verstehen der Code-Logik. Wenn Entwickler beispielsweise auf Code-Probleme stoßen, kann DeepSeek-R1 den Code analysieren und Lösungen anbieten; es kann auch Code-Frameworks oder konkrete Code-Abschnitte basierend auf Funktionsbeschreibungen generieren.

Lösung mathematischer Probleme: Löst in Bereichen wie Mathematik-Unterricht und -Forschung komplexe mathematische Probleme. DeepSeek-R1 zeigt beispielsweise hervorragende Leistungen bei Aufgaben im Zusammenhang mit dem AIME-Wettbewerb und kann Studenten beim Mathematiklernen und Wissenschaftlern bei der Lösung mathematischer Probleme unterstützen.

Modellforschung und -entwicklung: Bietet KI-Forschern Referenzmaterial und Werkzeuge für die Modelldestillation, die Verbesserung der Modellstruktur und die Entwicklung von Trainingsmethoden. Forscher können auf Basis der Open-Source-Modelle von DeepSeek Experimente durchführen und neue technologische Richtungen erforschen.

Entscheidungsunterstützung: Verarbeitet in Bereichen wie Wirtschaft und Finanzen Daten und Informationen und liefert Entscheidungsempfehlungen. Beispielsweise kann es Marktdaten analysieren und Unternehmen bei der Entwicklung von Marketingstrategien unterstützen; es kann Finanzdaten verarbeiten und Investitionsentscheidungen unterstützen.

Kurzanleitung zur Verwendung der DeepSeek-Modellreihe

Plattform aufrufen: Benutzer können sich auf der DeepSeek-Website (https://www.deepseek.com/) anmelden und die Plattform aufrufen.

Modell auswählen: Auf der Website oder in der App wird der Dialog standardmäßig von DeepSeek-V3 gesteuert. Durch Klicken auf den „Tiefes Denken“-Modus wird der Dialog von DeepSeek-R1 gesteuert. Bei Aufruf über eine API wird der entsprechende Modellparameter im Code entsprechend den Anforderungen festgelegt, z. B.

model='deepseek-reasoner'bei Verwendung von DeepSeek-R1.Aufgabe eingeben: Geben Sie im Dialogfenster eine natürlichsprachliche Beschreibung der Aufgabe ein, z. B. „Schreibe eine Liebesgeschichte“, „Erkläre die Funktion dieses Codes“, „Löse diese mathematische Gleichung“ usw.; bei Verwendung einer API erstellen Sie gemäß den API-Spezifikationen eine Anfrage und geben die aufgabenspezifischen Informationen als Eingabeparameter weiter.

Ergebnisse abrufen: Das Modell verarbeitet die Aufgabe und gibt die Ergebnisse zurück. Auf der Benutzeroberfläche werden der generierte Text, die beantworteten Fragen usw. angezeigt; bei Verwendung einer API werden die Ergebnisdaten aus der API-Antwort analysiert und weiterverarbeitet.

Schlussfolgerung

Die DeepSeek-Modellreihe hat mit ihrer herausragenden Leistung, ihren innovativen Trainingsmethoden, ihrem Open-Source-Gedanken und ihrem hohen Preis-Leistungs-Verhältnis bemerkenswerte Erfolge im Bereich der KI erzielt.

Wenn Sie sich für KI-Technologie interessieren, können Sie gerne liken, kommentieren und Ihre Meinung zu den DeepSeek-Modellreihen teilen. Verfolgen Sie auch die weitere Entwicklung von DeepSeek und freuen Sie sich auf weitere Überraschungen und Durchbrüche im Bereich der KI, die die KI-Technologie kontinuierlich voranbringen und verschiedene Branchen mit mehr Veränderungen und Chancen versorgen.