Ein Forschungsteam um Yan Shuicheng von Kunlun Wanwei (China) und der Nanyang Technological University (Singapur) hat kürzlich das Projekt Q* vorgestellt, das darauf abzielt, die Inferenzfähigkeit kleiner Sprachmodelle zu verbessern. Im Gegensatz zu OpenAI ermöglicht Q*, dass kleine Modelle die Inferenzleistung von Modellen erreichen, die um Dutzende oder sogar Hunderte Male größer sind.

Die experimentellen Ergebnisse des Forschungsteams mit dem Q*-Algorithmus sind bemerkenswert: Im GSM8K-Datensatz erzielte Llama-2-7b mit Q* eine Genauigkeit von 80,8 % und übertraf damit ChatGPT.

Im MATH-Datensatz erreichte DeepSeek-Math-7b mit Q* eine Genauigkeit von 55,4 % und übertraf damit Gemini Ultra.

Im MBPP-Datensatz erzielte CodeQwen1.5-7b-Chat mit Q* eine Genauigkeit von 77,0 % und verringerte die Lücke zur Programmierleistung von GPT-4. Diese Ergebnisse zeigen das Potenzial des Q*-Algorithmus zur Verbesserung der Inferenzfähigkeit kleiner Modelle.

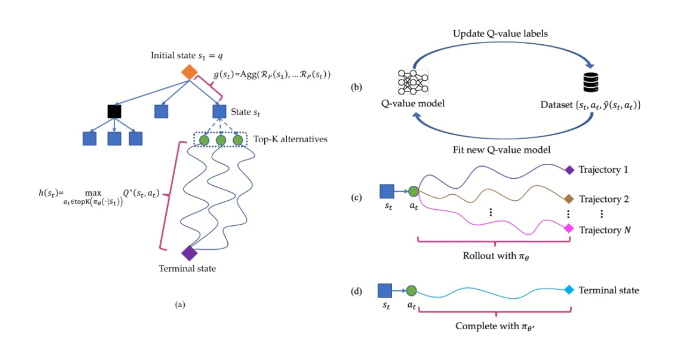

Der Q*-Algorithmus funktioniert, indem er die Inferenzspuren großer Sprachmodelle in mehrere Zustände zerlegt, jeden Zustand umfassend plant und den A*-Suchalgorithmus verwendet, um die priorisierte Suche nach komplexen Inferenzaufgaben zu ermöglichen. Zusätzlich wurde ein Proxy-Q-Wert-Modell durch überwachtes Lernen trainiert, um den optimalen Q-Wert für Zustands-Aktions-Paare zu erhalten und so die Modellleistung zu verbessern.

Wichtigste Punkte:

🔍 Das Q*-Projekt stammt nicht von OpenAI. Durch den Algorithmus des Forschungsteams wurde die Inferenzfähigkeit kleiner Modelle deutlich verbessert.

🔍 Das Projekt erzielte in mehreren Datensätzen bemerkenswerte experimentelle Ergebnisse, die das Potenzial und die Effektivität des Q*-Algorithmus belegen.