Mistral acaba de anunciar el lanzamiento de su último modelo de codificación de código abierto: Codestral25.01, una versión mejorada de su popular modelo de codificación Codestral. Esta versión, optimizada en su arquitectura, ofrece un rendimiento significativamente mejorado, convirtiéndose en el "líder indiscutible en codificación pesada", con una velocidad el doble de rápida que su predecesora.

Similar al Codestral original, Codestral25.01 se centra en la baja latencia y las operaciones de alta frecuencia, admitiendo tareas de corrección de código, generación de pruebas y relleno intermedio. Mistral afirma que esta versión es especialmente adecuada para empresas que necesitan más datos y residencia de modelos. Las pruebas de referencia muestran que Codestral25.01 supera las expectativas en las pruebas de codificación Python, obteniendo una puntuación del 86,6% en la prueba HumanEval, superando con creces a su versión anterior, Codellama70B Instruct y DeepSeek Coder33B Instruct.

Los desarrolladores pueden acceder al modelo a través del complemento Mistral IDE y la herramienta de implementación local Continue. Además, Mistral ofrece acceso a través de las API de Google Vertex AI y Mistral la Plateforme. El modelo está actualmente disponible en versión preliminar en Azure AI Foundry y llegará pronto a la plataforma Amazon Bedrock.

Desde su lanzamiento el año pasado, Codestral de Mistral se ha convertido en un líder entre los modelos de código abierto centrados en la codificación. La versión original de Codestral, un modelo de 22B parámetros, admite hasta 80 idiomas y supera en rendimiento de codificación a muchos de sus competidores. Posteriormente, Mistral lanzó Codestral-Mamba, un modelo de generación de código basado en la arquitectura Mamba, capaz de manejar secuencias de código más largas y responder a más demandas de entrada.

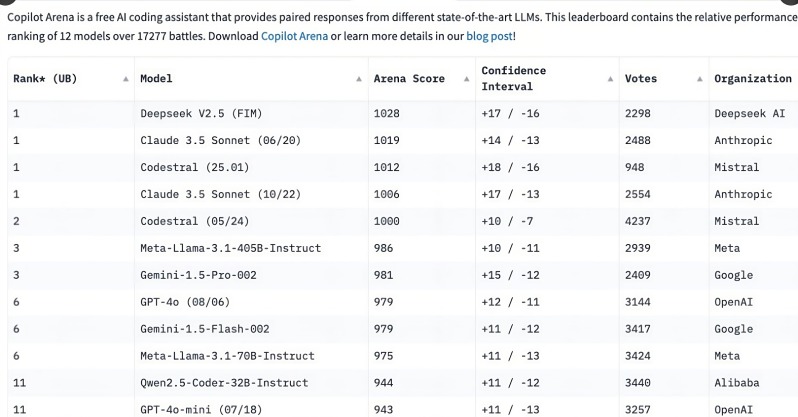

El lanzamiento de Codestral25.01 ha generado un gran interés entre los desarrolladores, alcanzando las primeras posiciones en la clasificación de C o pilot Arena en pocas horas. Esta tendencia indica que los modelos de codificación especializados se están convirtiendo rápidamente en la opción preferida de los desarrolladores, especialmente en el ámbito de las tareas de codificación, donde la demanda de modelos de codificación especializados es cada vez más evidente en comparación con los modelos multifuncionales generales.

Aunque modelos generales como o3 de OpenAI y Claude de Anthropic también pueden codificar, los modelos de codificación optimizados suelen ofrecer un rendimiento superior. En el último año, varias empresas han lanzado modelos especializados en codificación, como Qwen2.5-Coder de Alibaba y el DeepSeek Coder chino, este último siendo el primero en superar a GPT-4Turbo. Microsoft también lanzó GRIN-MoE, un modelo basado en Mixture of Experts (MOE) que no solo codifica, sino que también resuelve problemas matemáticos.

Aunque los desarrolladores todavía debaten sobre la elección entre modelos generales y especializados, el rápido auge de los modelos de codificación refleja la gran necesidad de herramientas de codificación eficientes y precisas. Gracias a su ventaja de estar entrenado específicamente para tareas de codificación, Codestral25.01 sin duda ocupará un lugar destacado en el futuro del desarrollo de código.