Récemment, Benjamin Fleischer, un chercheur en sécurité allemand, a publié un rapport sur GitHub de Microsoft, signalant une faille de sécurité critique dans l'API ChatGPT d'OpenAI, susceptible d'être exploitée pour lancer des attaques par déni de service distribué (DDoS). Cette faille permet aux attaquants d'envoyer, via de simples requêtes HTTP, des demandes massives à n'importe quel site web en utilisant le programme d'exploration de ChatGPT, pouvant même entraîner la paralysie du site cible.

Source : Image générée par IA, fournie par Midjourney

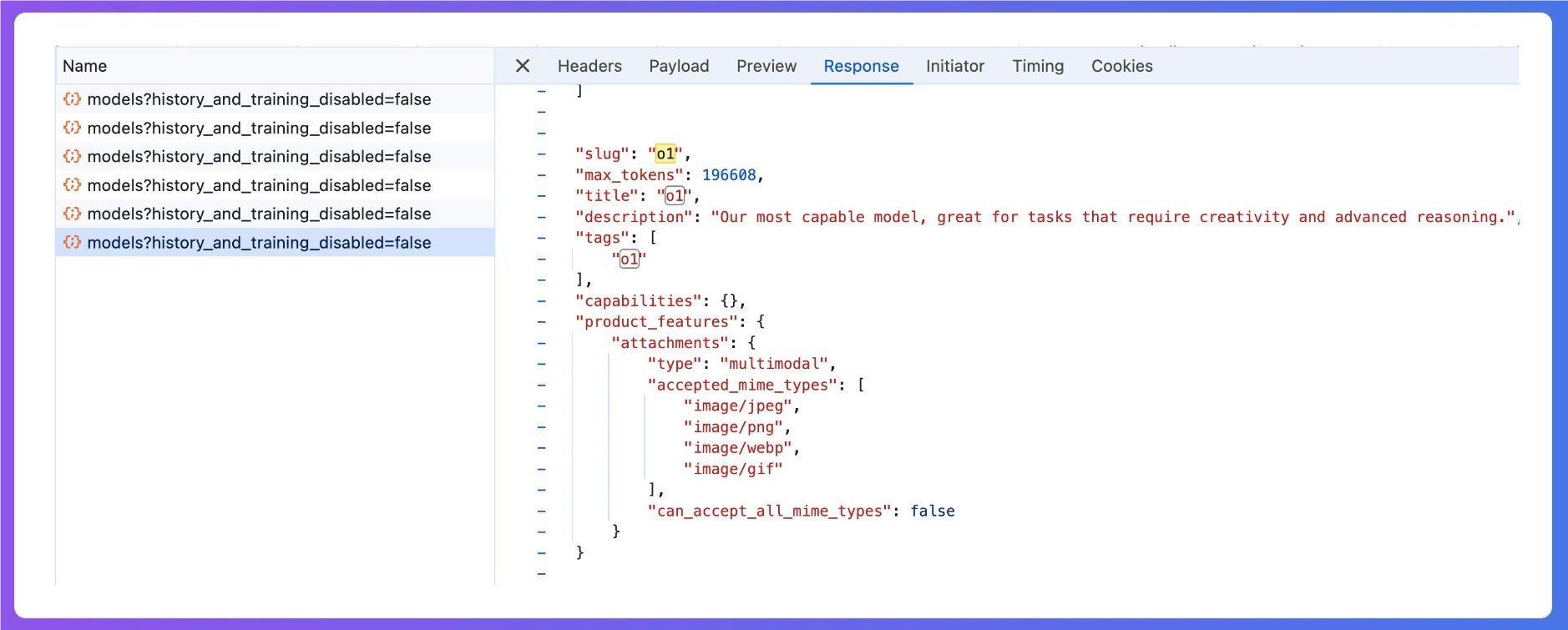

Selon le rapport de Fleischer, l'API de ChatGPT présente de graves défauts lorsqu'elle traite les requêtes HTTP POST pointant vers un site web spécifique. Lorsque ChatGPT cite un site web, il appelle un point de terminaison API appelé « attributions » pour demander des informations à ce site. Si un attaquant envoie à cette API une requête contenant de nombreux liens différents, le programme d'exploration de ChatGPT accédera simultanément à ces liens, envoyant ainsi un flot de requêtes au site cible.

Fleischer souligne que l'API ne vérifie pas les doublons de liens et ne limite pas leur nombre. Cela signifie qu'un attaquant peut soumettre des milliers de liens pointant vers le même site web en une seule requête. À l'aide d'outils simples, un attaquant peut envoyer des requêtes au point de terminaison de ChatGPT sans authentification, et les serveurs d'OpenAI enverront une requête pour chaque lien, potentiellement entre 20 et 5000 requêtes par seconde vers le site cible.

Comme les requêtes proviennent d'adresses IP différentes, la victime a du mal à détecter l'attaque. Même si la victime active un pare-feu pour bloquer les adresses IP de ChatGPT, le programme d'exploration renvoie les requêtes à la milliseconde suivante. Fleischer indique avoir signalé le problème à OpenAI et Microsoft par plusieurs canaux, sans avoir reçu de réponse à ce jour.

Outre la faille DDoS, Fleischer mentionne d'autres problèmes de sécurité de l'API, notamment une faille d'injection de prompt. Cela permet au programme d'exploration de répondre à des questions via le même point de terminaison API, au lieu de simplement récupérer des informations sur le site web. Fleischer s'interroge sur le manque de mesures de sécurité élémentaires chez OpenAI pour prévenir ces abus, soulignant qu'il s'agit de logiques de validation simples utilisées depuis des années par les développeurs de logiciels.

Il estime que cette faille pourrait indiquer qu'OpenAI n'a pas suffisamment pris en compte la sécurité lors du développement de son « agent IA ». L'absence de limitation du nombre de requêtes sur le même site web est particulièrement irrationnelle pour un programme d'exploration web fonctionnant depuis longtemps.

Points clés :

1. 🚨 Une faille de sécurité a été découverte dans l'API ChatGPT d'OpenAI, susceptible d'être utilisée pour lancer des attaques DDoS.

2. 📈 Un attaquant peut envoyer des milliers de liens pointant vers le même site web en une seule requête, submergeant ainsi le site cible.

3. ❗ La faille a été signalée à OpenAI et Microsoft, sans réponse, ce qui témoigne d'une négligence en matière de gestion de la sécurité.