人工知能の世界では、Transformerモデルの階層構造は特別な「画家」集団と言えるでしょう。彼らは魔法の筆のように、言語のキャンバスに多彩な世界を描きます。「Transformer Layers as Painters」という論文は、Transformerの中間層の動作メカニズムを新たな視点から理解する上で役立ちます。

現在最も普及している大規模言語モデルであるTransformerモデルは、数十億ものパラメータを持っています。各層はそれぞれ画家のように、壮大な言語の絵画を共同で完成させています。しかし、これらの「画家」はどのように連携しているのでしょうか?使用する「筆」や「絵の具」にはどのような違いがあるのでしょうか?この論文はこれらの疑問に答える試みです。

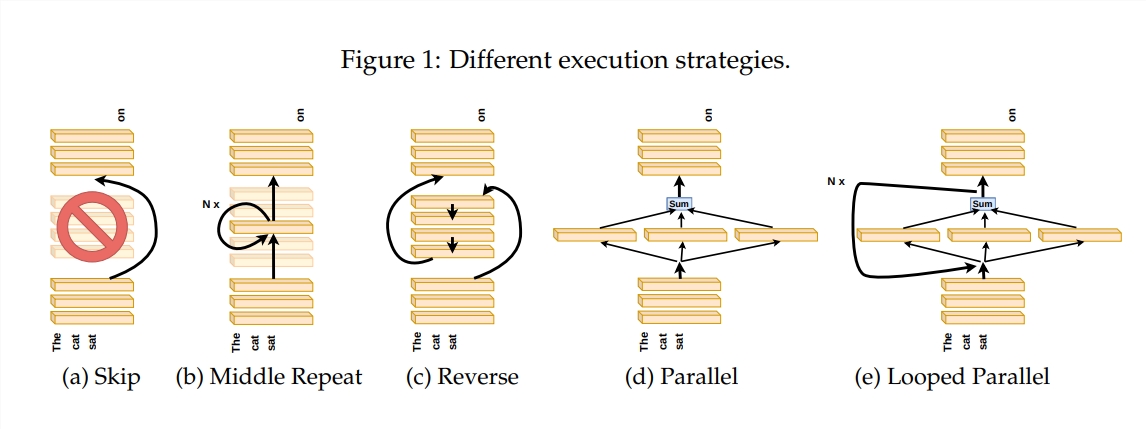

Transformer層の動作原理を探るため、著者は特定の層をスキップしたり、層の順序を変更したり、層を並列実行したりするなど、一連の実験を行いました。これらの実験は、「画家」たちに異なる作画ルールを設定し、彼らがそれに適応できるかどうかを調べるようなものです。

「画家パイプライン」の比喩では、入力はキャンバスと見なされ、中間層のプロセスは、キャンバスがパイプライン上を移動するようなものです。各「画家」、つまりTransformerの各層は、自分の専門知識に基づいて絵画を修正します。この類推は、Transformer層の並列性と調整可能性を理解するのに役立ちます。

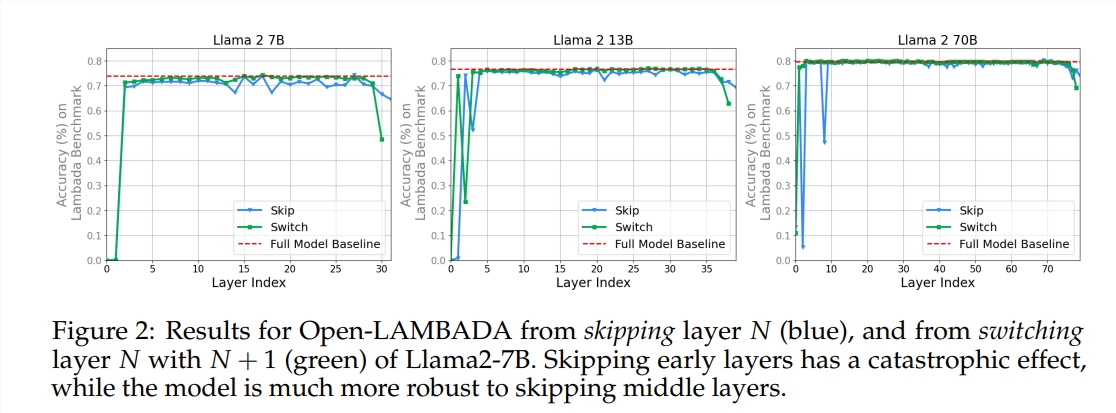

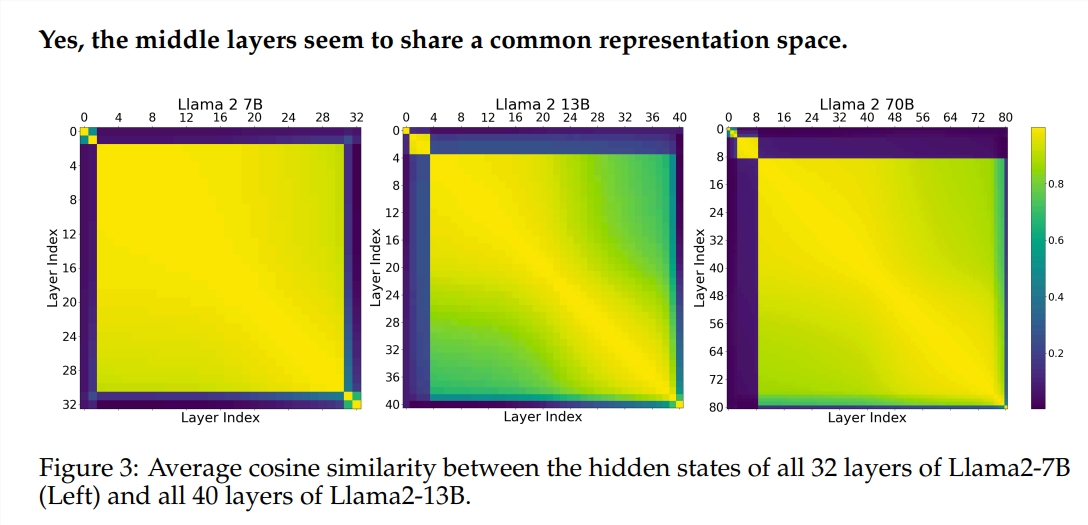

実験では、Llama2-7BとBERTという2種類の大規模言語モデル(LLM)を使用しました。研究によると、中間層の「画家」たちは共通の「絵の具箱」、つまり表現空間を共有しているように見えますが、最初の層と最後の層とは異なります。特定の中間層の「画家」をスキップしても、絵全体への影響はそれほど大きくないことから、すべての「画家」が必須ではないことが分かります。

中間層の「画家」たちは同じ「絵の具箱」を使用していますが、それぞれ独自の技法でキャンバスに異なる模様を描きます。ある「画家」の技法を単純に繰り返すと、絵の魅力が失われます。

厳密な論理が必要な数学や推論タスクでは、「作画」の順序が非常に重要です。一方、意味理解に依存するタスクでは、順序の影響は比較的少なくなります。

研究の結果、Transformerの中間層はある程度の整合性を持っているものの、冗長ではありません。数学や推論タスクでは、意味タスクよりも層の順序が重要です。

研究では、すべての層が必須ではなく、中間層をスキップしてもモデルのパフォーマンスに壊滅的な影響を与えないことも分かりました。さらに、中間層は同じ表現空間を共有していますが、それぞれ異なる機能を実行しています。層の実行順序を変更するとパフォーマンスが低下するため、順序はモデルのパフォーマンスに重要な影響を与えます。

Transformerモデルを探求する上で、多くの研究者は剪定やパラメータ削減など、モデルの最適化を試みています。これらの取り組みは、Transformerモデルを理解するための貴重な経験と示唆を与えてくれます。

論文アドレス:https://arxiv.org/pdf/2407.09298v1