Willkommen bei der Rubrik „AI-Tagesbericht“! Hier finden Sie täglich einen Überblick über die Welt der Künstlichen Intelligenz. Wir präsentieren Ihnen täglich aktuelle Themen aus dem Bereich KI, mit Fokus auf Entwickler, um Ihnen zu helfen, Technologietrends zu verstehen und innovative KI-Produktanwendungen kennenzulernen.

Neue KI-Produkte hier entdecken: https://top.aibase.com/

1. Das teuerste! OpenAI bringt das verbesserte KI-Modell o1-pro heraus, die Generierungskosten sind zehnmal so hoch wie bei o1

OpenAI hat kürzlich sein neues KI-Modell o1-pro vorgestellt, das eine bessere Inferenzleistung bieten soll. Der hohe Preis hat jedoch für viel Aufsehen gesorgt. Die Eingangs- und Generierungskosten von o1-pro sind doppelt so hoch wie bei GPT-4.5 bzw. zehnmal so hoch wie bei dem normalen o1. Dennoch setzt OpenAI große Hoffnungen in die Leistung des Modells und glaubt, dass es die Anforderungen von Entwicklern an komplexe Aufgaben erfüllen kann.

【AiBase Zusammenfassung:】

💡 OpenAI bringt das neue KI-Modell o1-pro heraus, um die Inferenzleistung zu verbessern.

💰 o1-pro ist extrem teuer: Die Eingabe kostet doppelt so viel wie bei GPT-4.5, die Generierungskosten sind zehnmal so hoch wie beim normalen o1.

🤔 Das Feedback der ersten Nutzer zu o1-pro ist geteilt, aber bei Programmier- und Mathematikaufgaben zeigt es sich zuverlässiger.

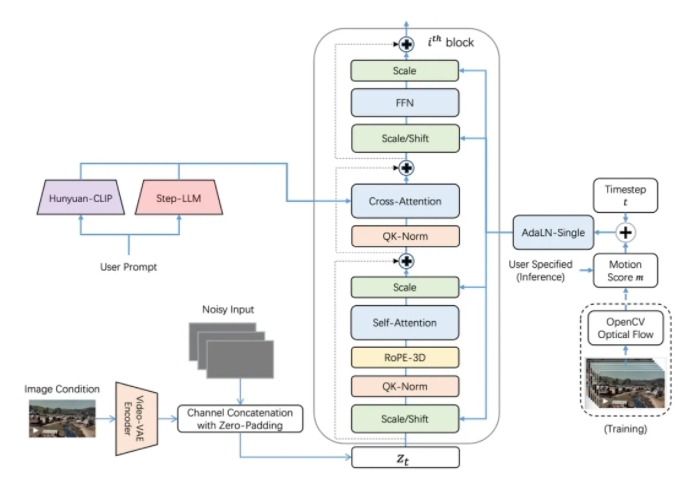

2. Bewegung steuerbar! Das Bild-zu-Video-Modell Step-Video-TI2V von Jieyue Xingchen wird Open Source

Das von der Shanghai Jieyue Xingchen Intelligent Technology Co., Ltd. entwickelte Step-Video-TI2V-Modell ist eine bemerkenswerte Innovation im Bereich der Bild-zu-Video-Generierung. Basierend auf dem 30B-Parameter-Modell Step-Video-T2V kann es qualitativ hochwertige Videos generieren und bietet eine Steuerung der Bewegungsamplitude und der Kamerabewegung. Es eignet sich besonders gut für die Erstellung von Animationen und Kurzvideos. Durch die Optimierung der Konsistenz und Dynamik der Generierung bietet das Modell den Erstellern flexiblere Möglichkeiten und erfüllt die Anforderungen an verschiedene Größen und Effekte.

【AiBase Zusammenfassung:】

🚀 Das Step-Video-TI2V-Modell basiert auf 30 Milliarden Parametern und kann Videos mit 5 Sekunden Länge und einer Auflösung von 540p generieren. Es bietet eine Steuerung der Bewegungsamplitude und der Kamerabewegung.

🎨 Das Modell erzielt hervorragende Ergebnisse bei Anime-Effekten und eignet sich für die Erstellung von Animationen und Kurzvideos. Es unterstützt die Generierung verschiedener Größen.

🔧 Durch die Einführung von Bildbedingungen und dem AdaLN-Modul wurde die Konsistenz und die dynamische Steuerung der generierten Videos im Vergleich zum Originalbild verbessert.

Detaillierter Link: https://yuewen.cn/videos

3. Tencent HunYuan präsentiert neue Entwicklungen! Das neue Inferenzmodell T1 wird am 21. März abends veröffentlicht

Tencent HunYuan gab bekannt, dass das neue Inferenzmodell T1 am 21. März offiziell veröffentlicht wird. Dies markiert einen weiteren Schritt in der technischen Weiterentwicklung und Produktverbesserung im Bereich der großen KI-Sprachmodelle. Gleichzeitig hat das Tencent HunYuan-Sprachmodell zum ersten Mal den Chatbot Arena Global Top 15 Ranking erreicht, was seine international führende Technologiekompetenz beweist. Die Öffentlichkeit erwartet eine Verbesserung der Inferenzleistung des T1-Modells, um Tencents Position im globalen Wettbewerb um große Sprachmodelle weiter zu stärken.

【AiBase Zusammenfassung:】

🚀 Tencent HunYuan veröffentlicht am 21. März das neue Inferenzmodell T1, ein Zeichen für technologische Weiterentwicklung.

🏆 Das Tencent HunYuan-Sprachmodell hat zum ersten Mal den Chatbot Arena Global Top 15 Ranking erreicht, was seine Technologiekompetenz unter Beweis stellt.

🌍 Die Öffentlichkeit erwartet eine Verbesserung der Inferenzleistung des T1-Modells, um Tencents Position im globalen Wettbewerb zu stärken.

4. Kosten nur ein Zehntel! Open-Sora 2.0, ein Open-Source-Video-KI-System, erreicht kommerzielle Bildqualität

Das kürzlich von HPC-AI Tech vorgestellte Open-Sora2.0 ist ein revolutionäres Video-KI-System. Die Trainingskosten betragen nur ein Zehntel der herkömmlichen Systeme, und die Ausgabequalität ist mit kommerziellen Produkten vergleichbar. Durch einen dreistufigen Trainingsprozess und einen effizienten Autoencoder wurde die Trainingsgeschwindigkeit deutlich verbessert, obwohl es Einschränkungen bei der Auflösung und der Videolänge gibt. Die Einführung von Open-Sora2.0 könnte die Kostenstruktur im Bereich der Video-KI nachhaltig beeinflussen und den Wettbewerb zwischen Open-Source- und kommerziellen Systemen fördern.

【AiBase Zusammenfassung:】

💡 Die Trainingskosten von Open-Sora2.0 betragen nur 200.000 US-Dollar, deutlich weniger als die mehreren Millionen Dollar, die für bestehende qualitativ hochwertige Video-Generierungssysteme anfallen.

⚙️ Das System verwendet einen dreistufigen Trainingsprozess und einen Video-DC-AE-Autoencoder, was zu einer 5,2-fach schnelleren Trainingsgeschwindigkeit und einer über zehnfach schnelleren Video-Generierungsgeschwindigkeit führt.

📈 Der VBench-Score von Open-Sora2.0 liegt nur 0,69 % unter dem von OpenAIs Sora und zeigt eine hervorragende Leistung in Bezug auf visuelle Qualität und Genauigkeit der Eingabeaufforderungen.

5. Boston Dynamics' Atlas-Roboter erzielt einen weiteren Durchbruch: Bewegungsfähigkeiten nähern sich dem menschlichen Niveau

Boston Dynamics hat kürzlich die neuesten Bewegungsfähigkeiten seines humanoiden Roboters Atlas vorgestellt. Durch die Kombination von Reinforcement Learning und Motion-Capture-Technologie kann Atlas selbstständig lernen und natürlichere und flexiblere menschenähnliche Bewegungen ausführen. Dieser technologische Durchbruch wird voraussichtlich dazu beitragen, humanoide Roboter näher an reale Anwendungsszenarien heranzuführen, insbesondere in den Bereichen Industrie, Medizin und Rettung.

【AiBase Zusammenfassung:】

🤖 Atlas erreicht durch Reinforcement Learning und Motion-Capture-Technologie natürlichere menschenähnliche Bewegungen.

🚀 Dieser technologische Durchbruch verbessert die Anpassungsfähigkeit und Koordinationsfähigkeit des Roboters in komplexen Umgebungen.

🌐 Die Zusammenarbeit von Boston Dynamics und dem RAI Institute eröffnet weitere Möglichkeiten für die Kommerzialisierung der humanoiden Robotertechnologie.

6. Spektakulär! Humanoider Roboter zeigt „menschliche Höchstleistung“: Yushu G1 vollführt als erster einen seitlichen Salto rückwärts und fordert Menschen zu einem Wettbewerb heraus!

Der humanoide Roboter G1 von Unitree Robotics hat erfolgreich einen schwierigen seitlichen Salto rückwärts vollführt und ist sicher gelandet. Dies markiert einen bedeutenden Durchbruch in der Bewegungsfähigkeit von Robotern. Diese Leistung zeigt nicht nur die hohe Zuverlässigkeit und Erfolgsrate von G1, sondern hat auch die Aufmerksamkeit von Technologiebegeisterten weltweit auf sich gezogen. Um seine Fähigkeiten weiter zu testen, hat Unitree Robotics einen „Roboter-Salto-Rückwärts-Wettbewerb für Menschen“ ins Leben gerufen, bei dem Menschen diese schwierige Bewegung versuchen können. Der Gewinner erhält einen G1-Roboter oder einen gleichwertigen Preis.

【AiBase Zusammenfassung:】

🤸♂️ Der G1-Roboter von Unitree Robotics hat als weltweit erster humanoider Roboter einen seitlichen Salto rückwärts vollführt.

🏆 Unitree Robotics veranstaltet einen „Roboter-Salto-Rückwärts-Wettbewerb für Menschen“, bei dem Menschen diese schwierige Bewegung versuchen können.

🌍 Der Wettbewerb hat die Aufmerksamkeit von Technologiebegeisterten weltweit auf sich gezogen. Man erwartet den ersten Menschen, der den Roboter-Salto rückwärts erfolgreich nachmacht.

7. Adobe präsentiert das Projekt „Project Slide Wow“: Daten verwandeln sich mit einem Klick in eine beeindruckende Präsentation

Auf der jährlichen Konferenz für digitale Innovation von Adobe hat das Projekt „Project Slide Wow“ viel Aufmerksamkeit auf sich gezogen. Dieses von generativer KI angetriebene Tool soll Rohdaten von Kunden schnell in überzeugende PowerPoint-Präsentationen verwandeln und die Arbeit von Datenanalysten und Marketingmitarbeitern erheblich vereinfachen. Durch die automatische Erstellung hochwertiger Folien und einen integrierten intelligenten Assistenten können Benutzer die Präsentationsinhalte in Echtzeit aktualisieren und anpassen, um die Genauigkeit und Aktualität der Informationen zu gewährleisten.

【AiBase Zusammenfassung:】

✨ Das generative KI-Tool wandelt Rohdaten schnell in hochwertige PPTs um und vereinfacht den Erstellungsprozess erheblich.

🤖 Ein integrierter intelligenter Assistent reagiert in Echtzeit auf die Bedürfnisse der Benutzer und bietet zusätzliche Visualisierungen und die dynamische Generierung von Folien.

📊 Es bietet die Möglichkeit, Daten in Echtzeit zu aktualisieren, um sicherzustellen, dass die Präsentationsinformationen immer aktuell sind und die Effizienz der Unternehmensentscheidungen verbessert wird.

8. Orpheus TTS: Ein neues TTS-Modell mit menschenähnlicher emotionaler Ausdrucksfähigkeit

Orpheus TTS ist ein neu vorgestelltes Open-Source-Text-to-Speech-Modell, das durch seine extrem niedrige Latenz und seine hohe emotionale Ausdrucksfähigkeit viel Aufmerksamkeit auf sich gezogen hat. Das Modell eignet sich hervorragend für Echtzeit-Dialoganwendungen und bietet eine natürliche und flüssige Sprachausgabe, die das Erlebnis der intelligenten Sprachinteraktion deutlich verbessert. Seine Open-Source-Natur bietet Entwicklern mehr Möglichkeiten zur individuellen Anpassung und könnte in Zukunft in vielen Bereichen zum Maßstab werden.

【AiBase Zusammenfassung:】

⚡ **Extrem niedrige Latenz**: Die Standardlatenz beträgt ca. 200 Millisekunden, durch Optimierung kann sie auf 25-50 Millisekunden reduziert werden, um die Anforderungen an Echtzeit-Dialoge zu erfüllen.

🎭 **Emotionale Ausdrucksfähigkeit**: Die Sprachausgabe ist natürlich und flüssig und unterstützt eine Vielzahl von Tonlagen, um das Interaktionserlebnis zu verbessern.

🎙️ **Echtzeit-Ausgabe-Stream**: Unterstützt die Stream-Audio-Generierung, um sicherzustellen, dass die Sprachgenerierung mit der Eingabe synchronisiert ist und für verschiedene Szenarien geeignet ist.

Detaillierter Link: https://github.com/canopyai/Orpheus-TTS

9. LG veröffentlicht das EXAONE Deep-Modell als Open Source, angeblich das erste selbst entwickelte Inferenz-KI-Modell aus Südkorea

LG AI Research hat kürzlich das EXAONE Deep Inferenz-KI-Modell als Open Source veröffentlicht, was den Beginn einer neuen Ära der aktiven KI markiert. Das Modell mit 32 Milliarden Parametern zeigt eine hervorragende Inferenzleistung, insbesondere in den Bereichen logisches Denken und Mathematik, und erreichte im koreanischen Hochschulaufnahmeexamen in Mathematik 94,5 Punkte – vergleichbar mit einem Musterschüler.

【AiBase Zusammenfassung:】

🧠 EXAONE Deep ist das erste selbst entwickelte Inferenz-KI-Modell aus Südkorea und ist in der Lage, selbstständig Hypothesen zu entwickeln und diese zu überprüfen.

📊 EXAONE Deep mit 32 Milliarden Parametern zeigt eine hervorragende Leistung in den Bereichen logisches Denken und Mathematik und erreichte im koreanischen Hochschulaufnahmeexamen in Mathematik 94,5 Punkte.

📱 LG hat auch ein leichtgewichtiges und ein Edge-Modell veröffentlicht, die 95 % bzw. 86 % der Leistung beibehalten und für Smartphones, Autos und andere Branchen geeignet sind.

Detaillierter Link: https://top.aibase.com/tool/exaone-deep

10. Der Google Chrome Browser wird bald den Gemini AI Assistenten integrieren, für eine einfachere Bedienung!

Vor dem Hintergrund der rasanten Entwicklung der Internettechnologie wird der Google Chrome Browser bald eine tiefgreifende Integration des Gemini AI Assistenten erhalten. Diese Funktion wird die Online-Erfahrung der Benutzer erheblich verbessern und die Bedienung vereinfachen. Benutzer können den Gemini Assistenten über ein Symbol in der oberen Fensterleiste direkt aufrufen und profitieren von benutzerdefinierten Tastenkombinationen und einem System-Tray-Symbol, obwohl derzeit kein fester Seitenleistenmodus unterstützt wird.

【AiBase Zusammenfassung:】

✨ Der Gemini AI Assistent wird tief in den Chrome Browser integriert und verbessert die Online-Erfahrung der Benutzer.

🔧 Benutzer können den Gemini Assistenten über ein Symbol in der oberen Fensterleiste schnell aufrufen und benutzerdefinierte Tastenkombinationen verwenden.

🗣️ Der Gemini Assistent unterstützt die Sprachsuche usw., aber derzeit wird kein fester Seitenleistenmodus unterstützt.