Mit der zunehmenden Globalisierung spielt die Technologie der neuronalen maschinellen Übersetzung (NMT) eine immer wichtigere Rolle im interlingualen Austausch. Obwohl aktuelle Übersetzungstools bei technischen Dokumenten und einfachen Texten hervorragende Leistungen erbringen, stehen sie bei der Übersetzung literarischer Texte immer noch vor großen Herausforderungen. Literarische Werke enthalten oft Metaphern und Vergleiche, die mit kulturellen und emotionalen Bedeutungen aufgeladen sind. Traditionelle Übersetzungssysteme haben oft Schwierigkeiten, ihre tiefere Bedeutung genau wiederzugeben.

Um diese Lücke zu schließen, hat das Tencent-Forschungsteam ein neues Übersetzungssystem namens DRT-o1 entwickelt. Das System umfasst zwei Versionen: DRT-o1-7B und DRT-o1-14B. Diese beiden Modelle basieren auf Qwen2.5 und integrieren einen neuartigen Multi-Agenten-Rahmen, der speziell auf die Übersetzung von Metaphern und Vergleichen optimiert ist. Das Forschungsteam sammelte etwa 400 gemeinfreie englische Bücher aus dem Gutenberg-Projekt, extrahierte 577.600 Sätze und wählte 63.000 Sätze mit Metaphern und Vergleichen als Trainingsdaten aus.

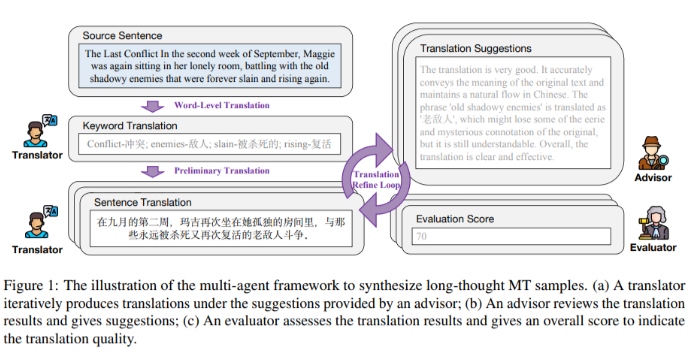

DRT-o1 verwendet einen kooperativen Ansatz mit drei Rollen: Übersetzer, Berater und Bewerter. Der Workflow dieses Multi-Agenten-Frameworks beginnt mit der Identifizierung und der einzelnen Übersetzung der Schlüsselbegriffe im Ausgangsatz, um die Genauigkeit des Kontextes zu gewährleisten. Nach der Erstellung einer ersten Übersetzung wird diese durch mehrere Iterationen von Verbesserung und Bewertung verfeinert, um schließlich eine flüssige und leicht verständliche Übersetzung zu erhalten. Das System kann bei der Übersetzung literarischer Werke die kulturellen Bedeutungen und emotionalen Feinheiten besser erfassen.

Die Ergebnisse zeigen, dass DRT-o1-7B einen BLEU-Score-Anstieg von 8,26 Punkten und einen COMET-Score-Anstieg von 3,36 Punkten erzielte, was besser ist als sein Vorgänger Qwen2.5-7B-Instruct. DRT-o1-14B zeigte ebenfalls eine hervorragende Leistung mit einem BLEU-Score-Anstieg von 7,33 Punkten und einem COMET-Score-Anstieg von 1,66 Punkten. Diese Ergebnisse zeigen, dass DRT-o1 in der Literaturübersetzung die Leistung bestehender Modelle übertrifft, wobei insbesondere die 7B-Version sogar das größere QwQ-32B-Modell übertrifft.

DRT-o1 erzielt durch die Einführung eines Multi-Agenten-Frameworks und einer Langketten-Inferenzmethode einen bahnbrechenden Fortschritt im Bereich der neuronalen maschinellen Übersetzung. Es verbessert nicht nur die Genauigkeit und Flüssigkeit der Übersetzung, sondern bietet auch neue Lösungen für die Übersetzung komplexer literarischer Texte.

Projekt-Eingang: https://github.com/krystalan/DRT-o1

Wichtigste Punkte:

🌟 DRT-o1 umfasst zwei Versionen (7B und 14B) und verwendet einen Multi-Agenten-Rahmen, um die Übersetzung von Metaphern und Vergleichen zu optimieren.

📚 Das Forschungsteam extrahierte und wählte 63.000 literarische Sätze aus 400 gemeinfreien Büchern als Trainingsdaten aus.

🚀 DRT-o1 zeigt eine deutliche Verbesserung der BLEU- und COMET-Scores und demonstriert eine starke Fähigkeit zur Literaturübersetzung.