Im Bereich der Künstlichen Intelligenz hat das DeepSeek-Team kürzlich seine neuesten Forschungsergebnisse veröffentlicht und einen innovativen sparsamen Aufmerksamkeitsmechanismus namens NSA (Native Sparse Attention) vorgestellt. Das Hauptziel dieser Technologie ist die Steigerung der Geschwindigkeit beim Training und der Inferenz mit langen Kontexten, insbesondere durch Optimierung für moderne Hardware, wodurch die Effizienz von Training und Inferenz deutlich verbessert wird.

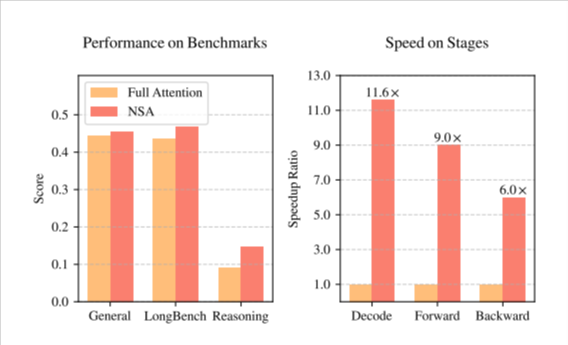

Die Einführung der NSA-Technologie hat die Art und Weise, wie KI-Modelle trainiert werden, deutlich verändert. Zunächst einmal wurde durch eine Reihe von Optimierungen, die auf die Eigenschaften moderner Computerhardware zugeschnitten sind, die Inferenzgeschwindigkeit erheblich gesteigert und die Kosten für das Pretraining effektiv gesenkt. Noch wichtiger ist, dass NSA bei der Steigerung der Geschwindigkeit und der Senkung der Kosten ein hohes Maß an Modellleistung beibehält und so sicherstellt, dass die Leistung des Modells bei verschiedenen Aufgaben nicht beeinträchtigt wird.

Das DeepSeek-Team hat in seiner Forschung eine hierarchische, sparsame Strategie angewendet, die den Aufmerksamkeitsmechanismus in drei Zweige unterteilt: Komprimierung, Selektion und gleitendes Fenster. Dieses Design ermöglicht es dem Modell, sowohl globale Kontexte als auch lokale Details gleichzeitig zu erfassen und verbessert so die Fähigkeit des Modells, lange Texte zu verarbeiten. Darüber hinaus reduzieren die Optimierungen von NSA in Bezug auf den Speicherzugriff und die Berechnungsplanung die Berechnungslatenz und den Ressourcenverbrauch beim Training mit langen Kontexten erheblich.

In einer Reihe von gängigen Benchmark-Tests hat NSA seine hervorragende Leistung unter Beweis gestellt. Besonders bei Aufgaben mit langen Kontexten und instruktionsbasierter Inferenz ist die Leistung von NSA mit der von Modellen mit vollständiger Aufmerksamkeit vergleichbar und in einigen Fällen sogar überlegen. Die Veröffentlichung dieser Technologie markiert einen weiteren Sprung in der KI-Trainings- und Inferenztechnologie und wird neue Impulse für die zukünftige Entwicklung der Künstlichen Intelligenz geben.

NSA-Paper (https://arxiv.org/pdf/2502.11089v1).

Wichtigste Punkte:

🌟 Die Einführung der NSA-Technologie verbessert die Geschwindigkeit beim Training und der Inferenz mit langen Kontexten deutlich und senkt die Kosten für das Pretraining.

🛠️ Durch die Verwendung einer hierarchischen, sparsamen Strategie, die den Aufmerksamkeitsmechanismus in Komprimierung, Selektion und gleitendes Fenster unterteilt, wird die Fähigkeit des Modells zur Verarbeitung langer Texte verbessert.

📈 In mehreren Benchmark-Tests zeigt NSA eine hervorragende Leistung und übertrifft in einigen Fällen herkömmliche Modelle mit vollständiger Aufmerksamkeit.