最近、中国昆侖万維の顔水成氏率いるチームとシンガポール南洋理工大学の研究チームが、小規模モデルの推論能力を向上させることを目的とした「Q*」プロジェクトを発表しました。このプロジェクトはOpenAIとは異なり、パラメータ数が数十倍、場合によっては数百倍も大きいモデルと同等の推論能力を小規模モデルに実現させます。

研究チームはQ*アルゴリズムの実験で顕著な成果を収めました。GSM8Kデータセットでは、Q*によってLlama-2-7bの精度が80.8%に向上し、ChatGPTを上回りました。

MATHデータセットでは、Q*によってDeepSeek-Math-7bの精度が55.4%に向上し、Gemini Ultraを上回りました。

MBPPデータセットでは、Q*によってCodeQwen1.5-7b-Chatの精度が77.0%に向上し、GPT-4とのプログラミング能力の差を縮めました。これらの成果は、Q*アルゴリズムが小規模モデルの推論能力向上に大きな可能性を秘めていることを示しています。

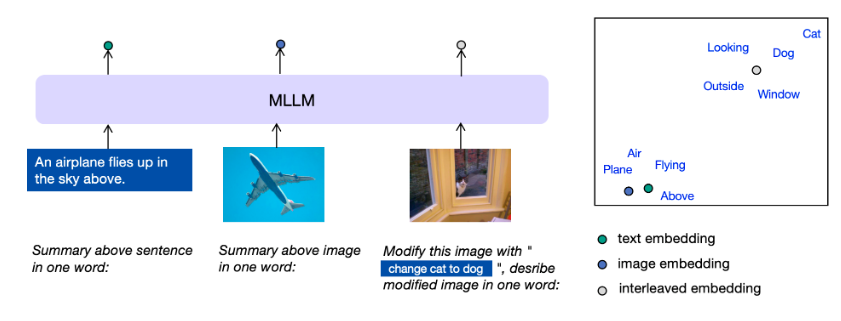

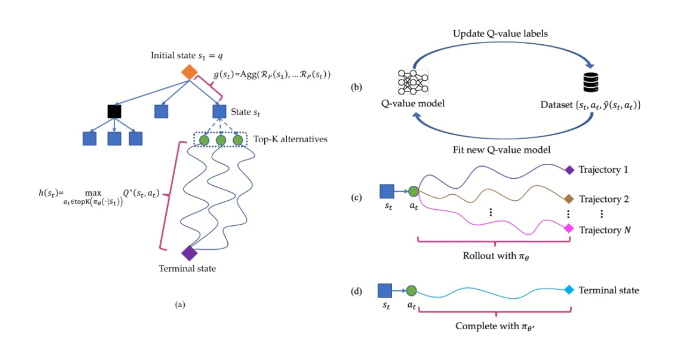

Q*アルゴリズムは、大規模言語モデルの推論軌跡を複数の状態に分解し、各状態を包括的に計画することで機能します。A*探索アルゴリズムを用いて複雑な推論タスクを優先的に探索します。同時に、教師あり学習によって代理Q値モデルを訓練し、状態-行動ペアの最適なQ値を得ることで、モデルの性能を向上させています。

要点:

🔍 Q*プロジェクトはOpenAIによるものではなく、研究チームのアルゴリズムにより、小規模モデルの推論能力が大幅に向上しました。

🔍 本プロジェクトは複数のデータセットで顕著な実験結果を得ており、Q*アルゴリズムの可能性と有効性を証明しています。

🔍論文リンク: https://arxiv.org/abs/2406.14283