Récemment, le modèle multimodal de grande taille InternLM-XComposer (IXC), version 2.5, a été mis à jour. Développé par le Shanghai Artificial Intelligence Laboratory, ce modèle révolutionne la compréhension et la création d'images et de textes grâce à ses capacités exceptionnelles de traitement de contextes longs en entrée et en sortie.

IXC-2.5 gère aisément des contextes longs allant jusqu'à 96 000 jetons, grâce à son entraînement sur 24 000 paires d'images et de textes entrelacées. Cette capacité de traitement de contextes longs permet à IXC-2.5 d'exceller dans les tâches nécessitant un large contexte d'entrée et de sortie.

Par rapport à la version précédente, IXC-2.5 présente trois améliorations majeures en matière de compréhension visuelle linguistique :

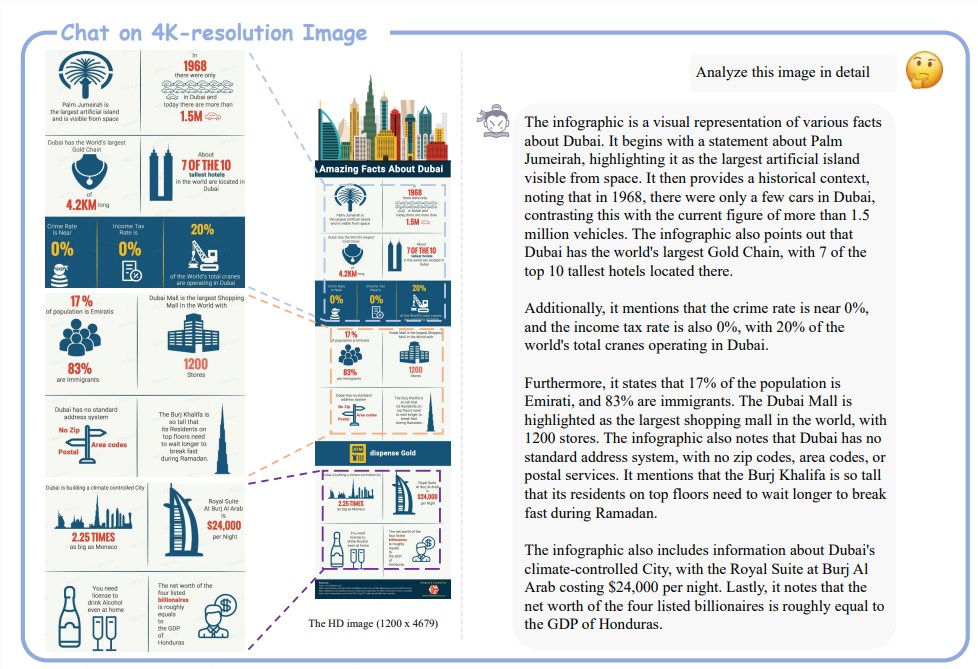

Compréhension de très haute résolution : Grâce à son encodeur visuel ViT 560×560 intégré, IXC-2.5 prend en charge les images haute résolution avec des rapports hauteur/largeur arbitraires.

Compréhension vidéo granulaire : Les vidéos sont traitées comme des images composites de très haute résolution composées de dizaines ou de centaines d'images. Le détail est capturé grâce à un échantillonnage dense et une résolution plus élevée.

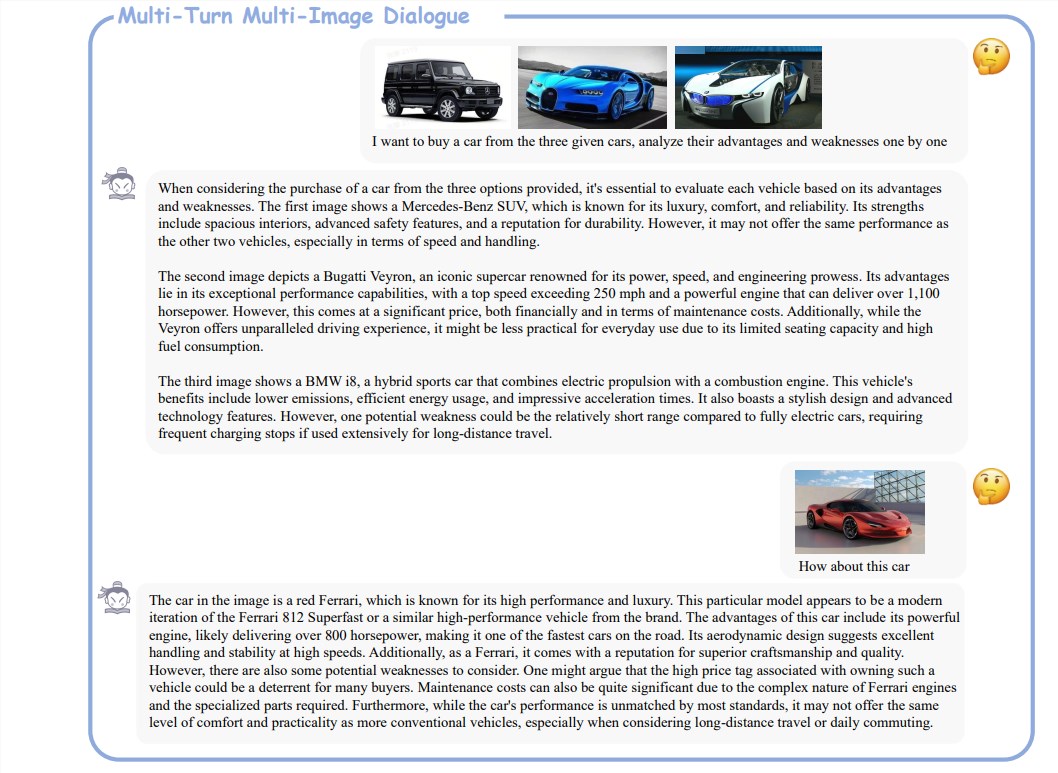

Dialogue multi-tours et multi-images : Prise en charge de dialogues multi-tours et multi-images de forme libre, permettant une interaction naturelle avec l'utilisateur.

Au-delà de l'amélioration de ses capacités de compréhension, IXC-2.5 étend ses applications avec deux fonctionnalités remarquables, utilisant des paramètres LoRA supplémentaires pour la création d'images et de textes :

Création de pages web : Sur la base d'instructions textuelles et d'images, IXC-2.5 peut générer du code source HTML, CSS et JavaScript pour créer des pages web.

Rédaction d'articles de haute qualité avec images : Grâce aux techniques spécialement conçues Chain-of-Thought (CoT) et Direct Preference Optimization (DPO), la qualité des contenus écrits est considérablement améliorée.

IXC-2.5 a été évalué sur 28 benchmarks. Il a surpassé les modèles open-source les plus performants sur 16 benchmarks. De plus, ses performances sont comparables ou supérieures à celles de GPT-4V et Gemini Pro sur 16 tâches clés. Ces résultats démontrent la puissance et le potentiel d'application d'IXC-2.5.

Adresse de l'article : https://arxiv.org/pdf/2407.03320

Adresse du projet : https://github.com/InternLM/InternLM-XComposer