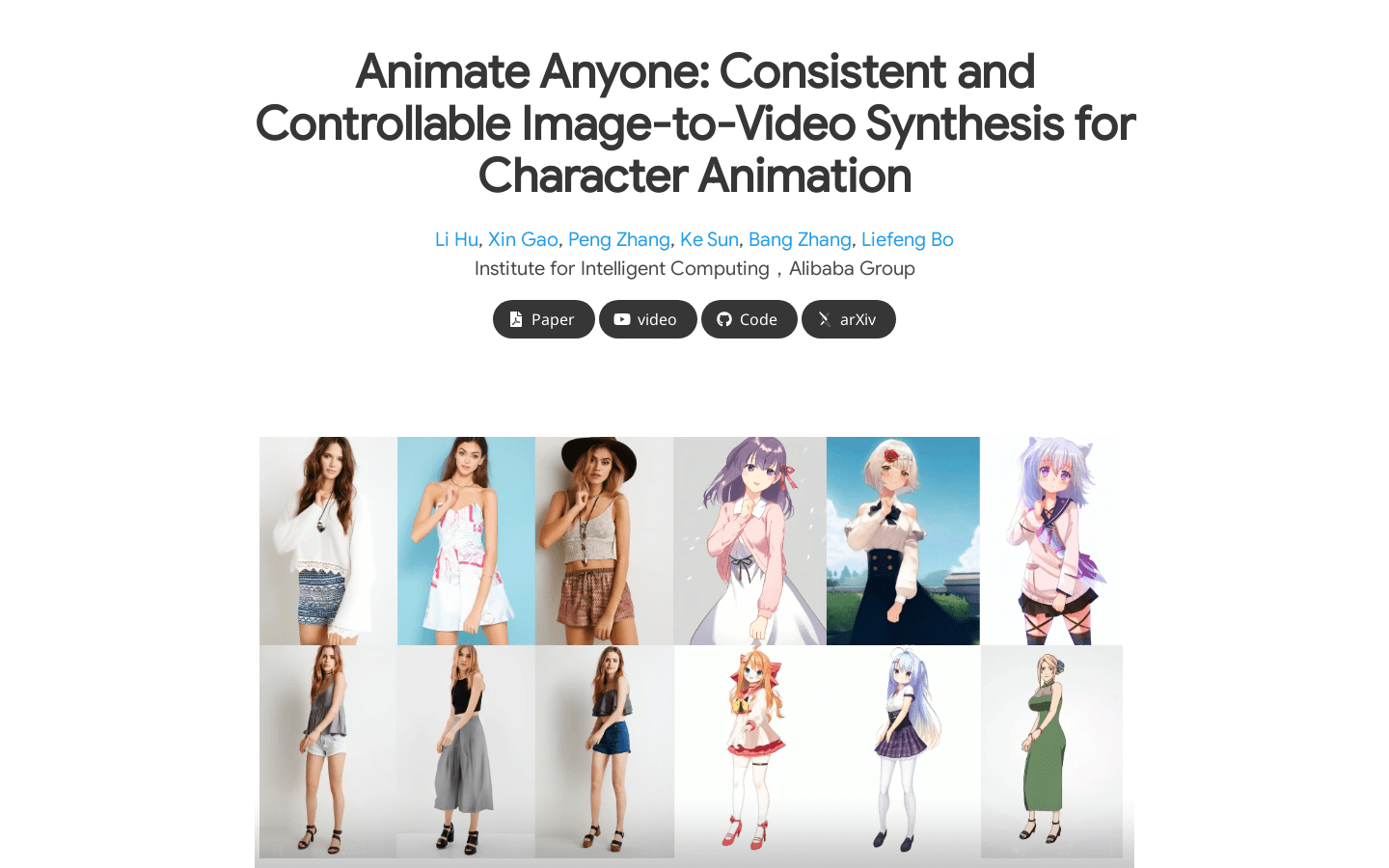

Animar a Cualquiera

Generación de vídeo de personajes animados a partir de imágenes estáticas, con resultados consistentes y controlables.

Animar a Cualquiera Situación del tráfico más reciente

Total de visitas mensuales

142573

Tasa de rebote

44.23%

Páginas promedio por visita

1.8

Duración promedio de la visita

00:00:40