テキストからビデオを生成する技術の著しい進歩に伴い、ビデオ入力から意味的および時間的に整合性のある音声コンテンツを生成する方法が研究者の関心の的となっています。最近、テンセント人工知能研究所の研究チームは、効率的な音声生成ソリューションを提供することを目的とした「潜在的アライメントビデオから音声生成」という新しいモデル、VTA-LDMを発表しました。

プロジェクト入口:https://top.aibase.com/tool/vta-ldm

VTA-LDMモデルの中核となる考え方は、潜在的アライメント技術を通じて、生成された音声とビデオコンテンツが意味的および時間的に一致するようにすることです。この方法は、音声生成の品質を向上させるだけでなく、ビデオ生成技術の適用範囲も拡大します。研究チームは、生成される音声の正確性と一貫性を確保するために、モデル設計において多様な技術的手段を組み合わせ、徹底的な調査を行いました。

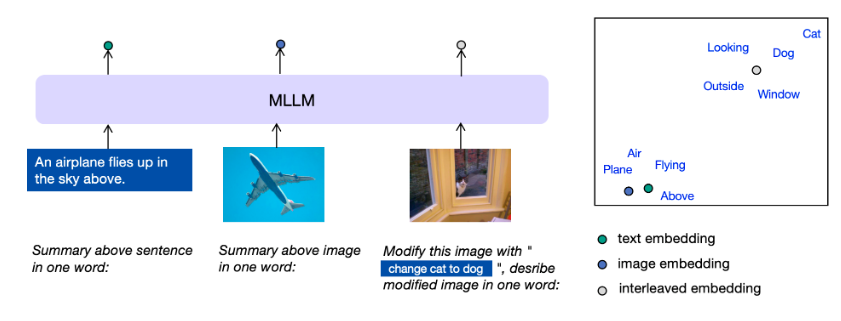

この研究は、視覚エンコーダ、補助埋め込み、データ拡張技術という3つの重要な側面に重点的に分析しています。研究チームはまず基本モデルを構築し、その上で多くのアブレーション実験を行い、さまざまな視覚エンコーダと補助埋め込みが生成結果に与える影響を評価しました。これらの実験の結果は、モデルが生成品質とビデオと音声の同期アライメントの両方において優れた性能を示し、現在の最先端技術に達していることを示しています。

推論に関しては、ユーザーはビデオクリップを指定されたデータディレクトリに配置し、提供されている推論スクリプトを実行するだけで、対応する音声コンテンツを生成できます。研究チームは、生成された音声と元のビデオをマージするためのツールも提供しており、アプリケーションの利便性をさらに向上させています。

VTA-LDMモデルは現在、さまざまな研究ニーズを満たすために、複数の異なるモデルバージョンを提供しています。これらのモデルには、基本モデルとさまざまな拡張モデルが含まれており、ユーザーに柔軟な選択肢を提供し、さまざまな実験やアプリケーションシナリオに対応することを目的としています。

VTA-LDMモデルの発表は、ビデオから音声への生成分野における重要な進歩を示しており、研究者たちは、このモデルを通じて関連技術の発展を促進し、より豊かな応用可能性を切り開くことを期待しています。

## 重要なポイント:

- 🎬 研究は、ビデオ入力と意味的および時間的にアライメントされた音声コンテンツを生成する方法に焦点を当てています。

- 🔍 生成プロセスにおける視覚エンコーダ、補助埋め込み、データ拡張技術の重要性を検討しました。

- 📈 実験結果は、このモデルがビデオから音声への生成分野で最先端のレベルに達しており、関連技術の発展を促進していることを示しています。