アリババクラウドの通義千問が、新しいビジュアルモデルQwen2.5-VLをオープンソース化し、3B、7B、72Bの3つのサイズバリエーションを発表しました。

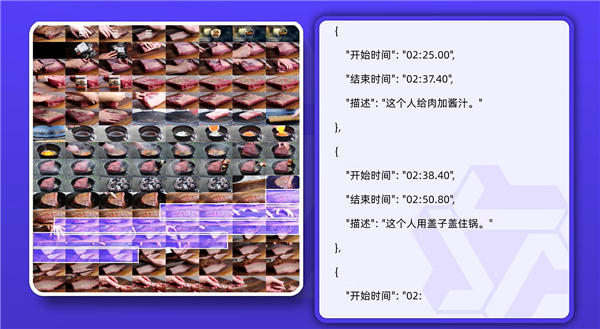

その中でも、フラッグシップモデルであるQwen2.5-VL-72Bは、13の権威ある評価においてビジュアル理解でトップの座を獲得し、GPT-4oやClaude3.5を凌駕しました。アリババクラウド公式の説明によると、新しいQwen2.5-VLは画像内容をより正確に解析できるだけでなく、画期的に1時間以上の動画理解に対応しています。このモデルは動画内から特定のイベントを検索し、動画の異なる時間帯を要約することで、ユーザーが動画から重要な情報を迅速かつ効率的に抽出するのを支援します。

さらに、Qwen2.5-VLは微調整なしで、携帯電話やコンピューターを操作できるAIビジュアルインテリジェントエージェント(Visual Agents)に変身し、指定の友人に祝福を送信したり、コンピューターで画像を修正したり、携帯電話でチケットを予約したりといった、複数ステップの複雑な操作を実行できます。Qwen2.5-VLは、花、鳥、魚、昆虫などの一般的な物体の認識に優れているだけでなく、画像内のテキスト、チャート、アイコン、グラフィック、レイアウトも分析できます。アリババクラウドはまた、Qwen2.5-VLのOCR認識能力を向上させ、多様なシーン、多言語、多方向でのテキスト認識とテキスト位置特定能力を強化しました。

同時に、情報抽出能力が大幅に向上し、増加する資格審査、金融ビジネスなどのデジタル化、インテリジェント化ニーズに対応しています。

要点:

🌟 アリババクラウド通義千問がQwen2.5-VLをオープンソース化、3B、7B、72Bの3つのバージョンを発表。

📈 Qwen2.5-VL-72Bがビジュアル理解評価でGPT-4oとClaude3.5を上回る。

👀 Qwen2.5-VLは1時間以上の動画理解に対応し、OCR認識能力が強化。