先日、バイトダンス(ByteDance)は、動画生成技術に革命を起こすことを目指した最先端の成果である、最新のAIプロジェクト「DreamActor-M1」を発表しました。このモデルは、静止画1枚と参考となる動作動画を組み合わせることで、写真中の人物を動画シーンにシームレスに置き換え、表情豊かで自然な動き、高画質の動画を生成できます。この技術の発表は、バイトダンスの生成AI分野における新たなブレークスルーを示すだけでなく、既存のアニメーション生成ツール(RunwayのAct-Oneなど)への強力な挑戦と見なされています。

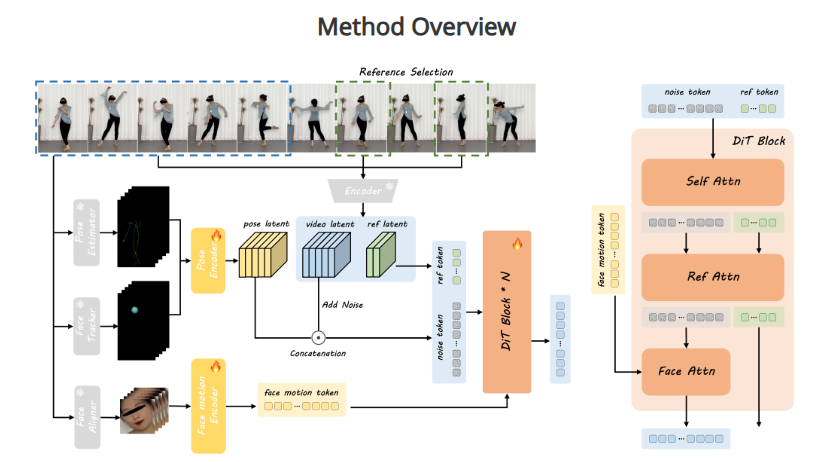

DreamActor-M1の中核となる革新は、細部への正確な制御と一貫した表現にあります。従来の画像から動画への生成方法は、表情の描写が不十分、動作の移行が不自然、長尺動画での詳細の不一致や「ミス」といった多くの課題に直面していました。しかしDreamActor-M1は、高度なアルゴリズム設計により、これらの技術的なボトルネックを克服することに成功しました。人物が微笑む際の口角の角度、まばたきの自然なリズム、唇のわずかな震えなど、あらゆる細部を驚くほどリアルに表現できます。同時に、振り返る、手を上げる、ダンスをするといった複雑な動作も同時に制御し、画面全体の調和性と滑らかさを確保します。

技術分析によると、この成果は、バイトダンスが深層学習と動画処理技術において蓄積してきた豊富な経験によるものと考えられます。DreamActor-M1は、参考動画の動作パターンを捉えるだけでなく、これらのパターンを静止画の人物の特徴とシームレスに融合させることができ、生成された結果は元のアイデンティティの独自性を維持しながら、一般的な「歪み」や「不自然な動き」を回避します。この高精度の出力により、画質は高精細基準に達し、ユーザーにほぼ実写に近い視聴体験を提供します。

業界の専門家は、DreamActor-M1の登場がAI動画生成分野における重要な空白を埋めたと指摘しています。RunwayのAct-Oneなどの既存技術と比較して、このモデルは、微表情の再現などのきめ細かい制御と、顔と体の協調動作などの多次元動作の同期において特に優れています。この特性により、様々なアプリケーションシナリオで大きな可能性を秘めています。例えば、映画制作では、監督は一枚の写真を使ってキャラクターのダイナミックな演技をすばやく生成できます。ソーシャルメディアでは、ユーザーは自分の写真を生き生きとした面白いアニメーション動画に変換できます。教育や仮想現実分野でも、この技術は没入型コンテンツ制作をサポートできます。

しかし、DreamActor-M1の登場は、技術応用に関する深い考察も引き起こしています。その高度なリアルな生成能力は、デジタルコンテンツ制作に革命的な変化をもたらす可能性がありますが、同時にディープフェイクとプライバシー保護に関する議論を激化させる可能性もあります。バイトダンスはまだこのモデルの具体的なトレーニングデータのソースや商業化計画を明らかにしていませんが、外界は将来、技術革新と倫理規範のバランスを取るために、より多くの詳細を提供することを期待しています。

TikTokの親会社であるバイトダンスは、近年AI分野への投資をますます強化しています。画像生成から動画アニメーションまで、その技術開発はますます複雑なマルチモーダルな方向に進んでいます。DreamActor-M1の発表は、自身の技術力の証明であると同時に、世界のAI競争において踏み出した確固たる一歩でもあります。このモデルがさらに改良され普及していくにつれて、動画コンテンツの制作方法を再定義し、ユーザーと業界にもたらす驚きと可能性は計り知れません。

プロジェクトアドレス:https://grisoon.github.io/DreamActor-M1/