Recentemente, a empresa de pesquisa de inteligência artificial Epoch AI lançou um simulador interativo projetado para modelar a capacidade computacional necessária para treinar grandes modelos de linguagem. Usando este simulador, os pesquisadores descobriram que, embora seja possível treinar o GPT-4 usando GPUs antigas de 2012, como a GTX580, o custo seria dez vezes maior do que com o hardware moderno atual.

A pesquisa da Epoch AI mostra que o número de operações de ponto flutuante (FLOPs) necessárias para treinar o GPT-4 está entre 1e25 e 1e26. Para esta pesquisa, o simulador analisou a eficiência de diferentes GPUs, especialmente como seu desempenho muda com o aumento do tamanho do modelo. Os resultados mostraram que a eficiência geralmente diminui à medida que o modelo cresce. Por exemplo, a GPU H100, lançada nos últimos anos, mantém uma alta eficiência por um período mais longo, enquanto a GPU V100 mostra uma queda de eficiência mais acentuada ao lidar com escalas de treinamento maiores.

No experimento da Epoch AI, a GPU GTX580 tinha apenas 3 GB de memória. Esta GPU foi uma escolha popular em 2012 para treinar o modelo AlexNet. Apesar do avanço da tecnologia, os pesquisadores acreditam que é possível treinar em larga escala usando hardware antigo, mas os recursos e custos seriam extremamente altos.

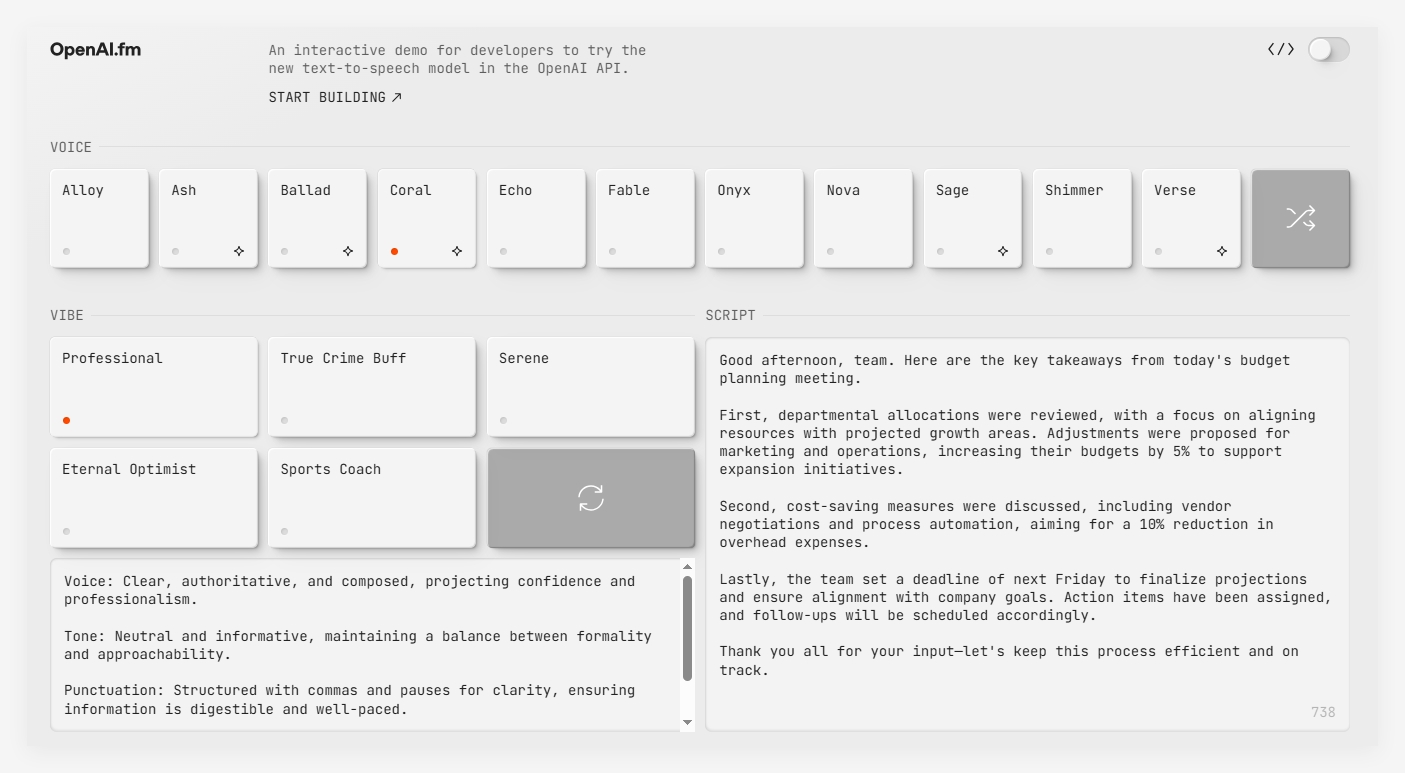

Além disso, o simulador suporta simulações de treinamento complexas em vários centros de dados. Os usuários podem personalizar parâmetros como o tamanho, a latência e a largura de banda de conexão dos centros de dados para simular execuções de treinamento em vários locais. Esta ferramenta também permite analisar as diferenças de desempenho entre GPUs modernas (como H100 e A100), estudar os efeitos de diferentes tamanhos de lote e treinamento multi-GPU e gerar arquivos de log detalhados registrando a saída do modelo.

A Epoch AI afirma que o objetivo do desenvolvimento deste simulador é aprofundar a compreensão das melhorias na eficiência do hardware e avaliar o impacto dos controles de exportação de chips. Com o aumento previsto de tarefas de treinamento em larga escala neste século, entender os requisitos de hardware futuros torna-se crucial.

Destaques:

💻 GPUs GTX580 lançadas em 2012 podem treinar o GPT-4 com um custo dez vezes maior, mas com baixa eficiência.

📊 O simulador pode analisar as diferenças de desempenho de diferentes GPUs e suporta simulação de treinamento em vários centros de dados.

🔍 Esta pesquisa visa melhorar a compreensão das necessidades de hardware futuro, auxiliando no treinamento de grandes modelos de IA.