混合注意力模型 (MoA)

パーソナライズされた画像生成のための混合注意力アーキテクチャ

一般製品画像画像生成パーソナライズ

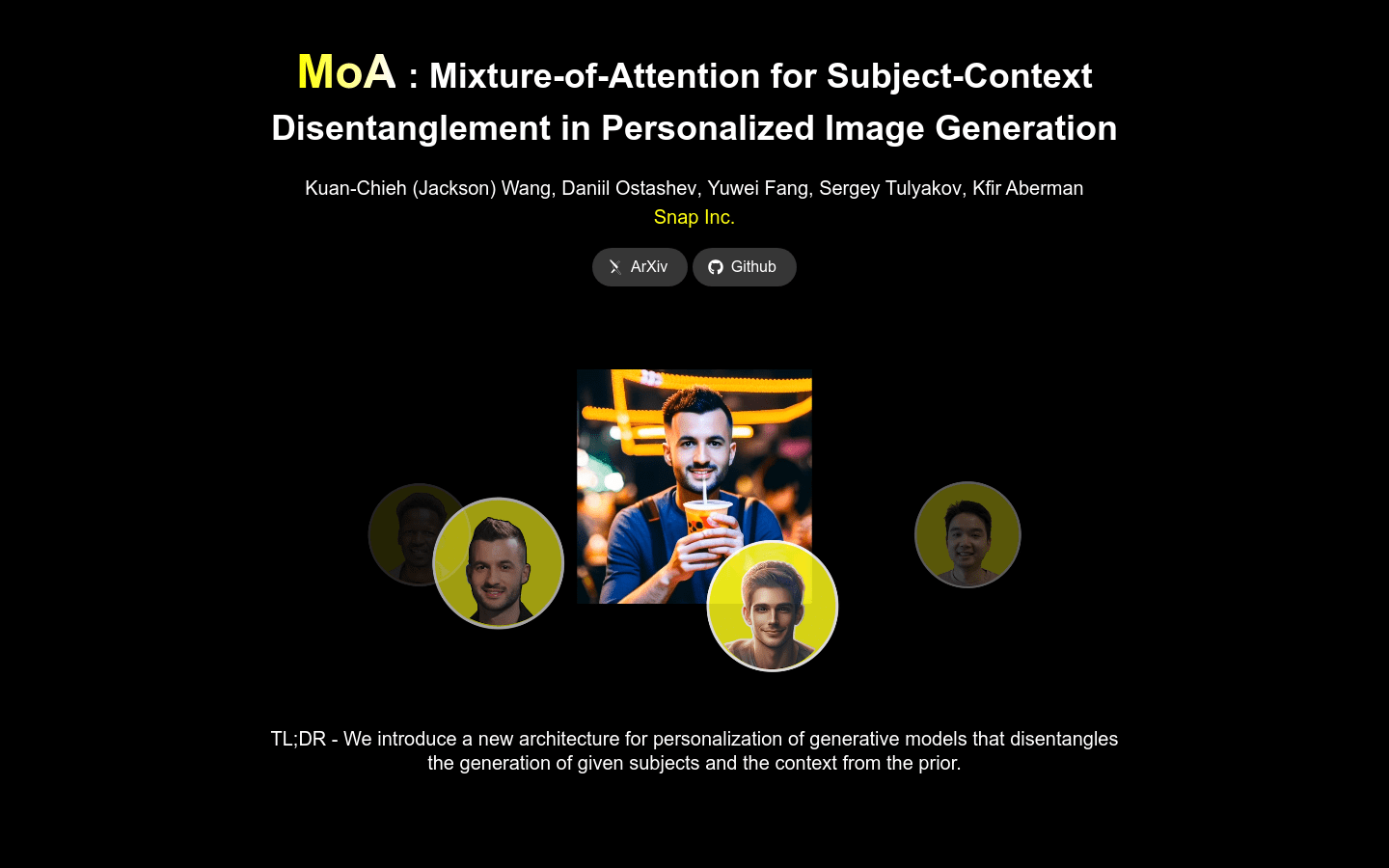

混合注意力モデル (MoA) は、パーソナライズされたテキストから画像への拡散モデルで使用される新しいアーキテクチャです。パーソナライズ化ブランチと非パーソナライズ化事前ブランチという2つの注意力パスにより、生成ワークロードを割り当てます。MoAは、パーソナライズ化ブランチによって生成プロセスへの介入を最小限に抑えながら、元のモデルの事前情報を保持するように設計されています。このブランチは、事前ブランチによって生成されたレイアウトとコンテキストに主題を埋め込むことを学習します。MoAは、新規なルーティングメカニズムによって各層のピクセルをこれらのブランチ間で分散させることで、パーソナライズされたコンテンツと汎用コンテンツ作成の混合を最適化します。トレーニング後、MoAは、元のモデルで生成されたものと同じくらい多様性があり、複数の主題の構成と相互作用を示す、高品質でパーソナライズされた画像を作成できます。MoAは、モデルの既存の能力と強化されたパーソナライズ化介入との違いを明確にすることで、これまで実現できなかった、より解耦合された主題コンテキスト制御を提供します。

混合注意力模型 (MoA) 最新のトラフィック状況

月間総訪問数

18354

直帰率

52.83%

平均ページ/訪問

1.5

平均訪問時間

00:00:37

![FLUX1.1 [pro]](https://pic.chinaz.com/ai/logo/2024/1008/33529.jpg)