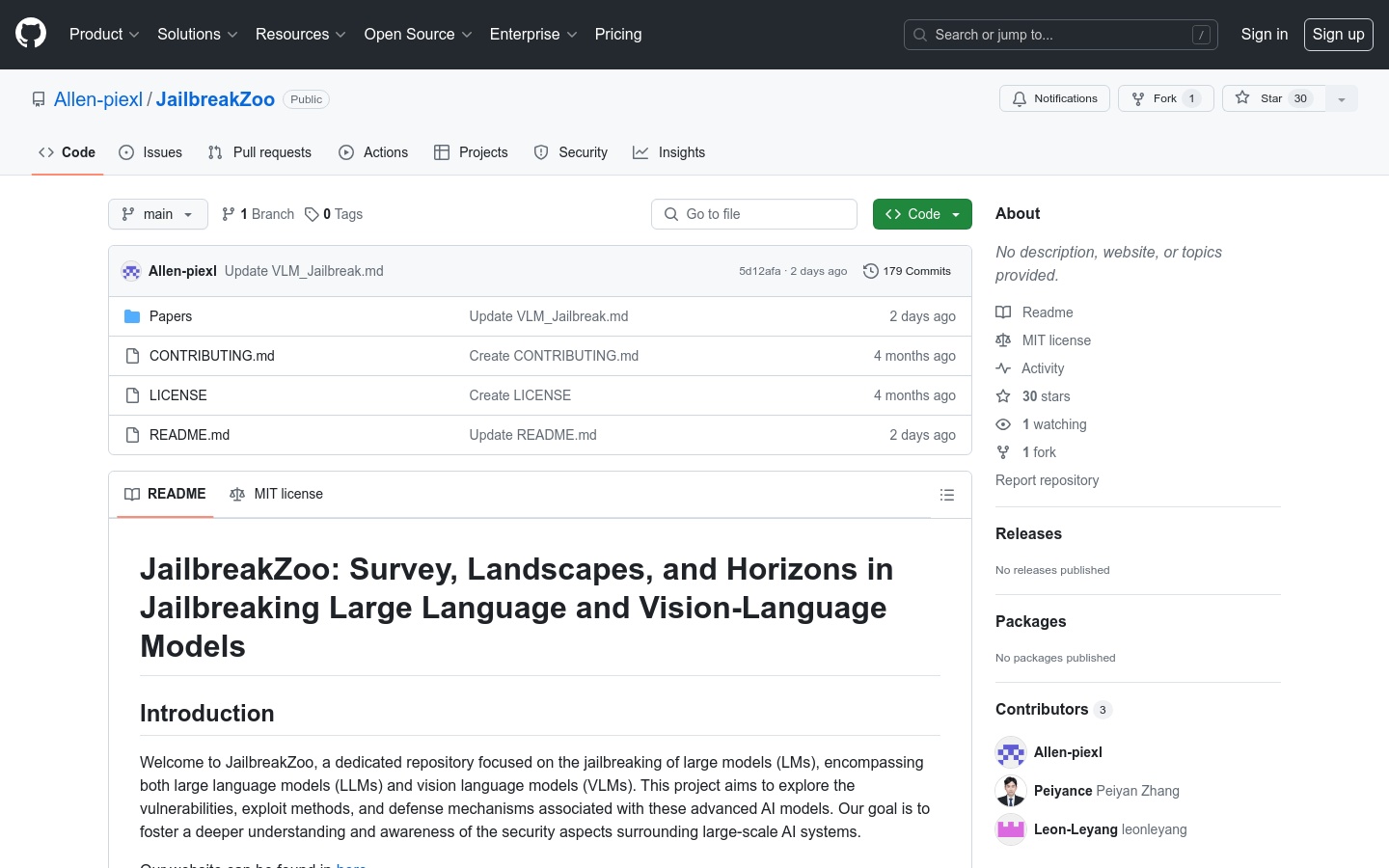

JailbreakZoo

大規模言語モデルと視覚言語モデルの脆弱性と保護策を探求する

一般製品プログラミングAIセキュリティモデル突破

JailbreakZooは、大規模言語モデル(LLM)と視覚言語モデル(VLM)を含む大規模モデルの脆弱性解明に特化したリポジトリです。本プロジェクトは、これらの高度なAIモデルの脆弱性、攻撃手法、防御メカニズムを探求し、大規模AIシステムのセキュリティに関するより深い理解と認識を促進することを目的としています。

JailbreakZoo 最新のトラフィック状況

月間総訪問数

474564576

直帰率

36.20%

平均ページ/訪問

6.1

平均訪問時間

00:06:34