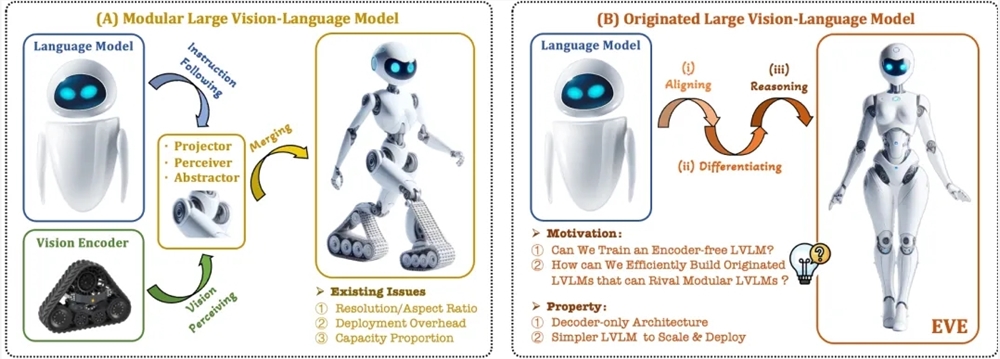

Recientemente, la investigación y aplicación de modelos de lenguaje multimodal han experimentado avances significativos. Empresas internacionales como OpenAI, Google y Microsoft han lanzado una serie de modelos avanzados, y en China, instituciones como Zhipu AI y Jieyue Xingchen también han logrado avances en este campo. Estos modelos suelen depender de codificadores visuales para extraer características visuales y combinarlas con modelos de lenguaje extenso, pero presentan un problema de sesgo de inducción visual debido a su entrenamiento separado, lo que limita la eficiencia y el rendimiento de la implementación de los modelos multimodales.

Para solucionar estos problemas, el Instituto de Inteligencia Artificial de Beijing (BAAI), en colaboración con la Universidad de Tecnología de Dalian y la Universidad de Pekín, ha presentado EVE, un nuevo modelo de lenguaje visual sin codificador. EVE integra la representación, alineación y razonamiento visual-lingüístico en una arquitectura de decodificador puro mediante estrategias de entrenamiento refinadas y supervisión visual adicional. Utilizando datos públicos, EVE ha demostrado un rendimiento excelente en varias pruebas de referencia de lenguaje visual, acercándose o incluso superando a los métodos multimodales principales basados en codificadores.

Las principales características de EVE incluyen:

Modelo de lenguaje visual nativo: elimina el codificador visual, procesa cualquier relación de aspecto de imagen y supera significativamente al modelo Fuyu-8B del mismo tipo.

Bajo costo de datos y entrenamiento: el preentrenamiento utiliza datos públicos como OpenImages, SAM y LAION, y el tiempo de entrenamiento es más corto.

Exploración transparente y eficiente: proporciona una ruta de desarrollo eficiente y transparente para la arquitectura multimodal nativa de decodificador puro.

Estructura del modelo:

Capa de incrustación de parches (Patch Embedding Layer): obtiene un mapa de características 2D de la imagen mediante una capa de convolución única y una capa de agrupación promedio, mejorando las características locales y la información global.

Capa de alineación de parches (Patch Aligning Layer): integra las características visuales de múltiples capas de la red, logrando una alineación de grano fino con la salida del codificador visual.

Estrategia de entrenamiento:

Fase de preentrenamiento guiada por modelos de lenguaje extenso: establece una conexión inicial entre la visión y el lenguaje.

Fase de preentrenamiento generativo: mejora la capacidad del modelo para comprender el contenido visual y lingüístico.

Fase de ajuste supervisado: regula la capacidad del modelo para seguir las instrucciones del lenguaje y aprender patrones de conversación.

Análisis cuantitativo: EVE ha demostrado un rendimiento excelente en varias pruebas de referencia de lenguaje visual, comparable a varios modelos de lenguaje visual principales basados en codificadores. Aunque presenta desafíos en la respuesta precisa a instrucciones específicas, mediante una estrategia de entrenamiento eficiente, EVE ha logrado un rendimiento comparable al de los modelos de lenguaje visual basados en codificadores.

EVE muestra el potencial de los modelos de lenguaje visual nativos sin codificador. En el futuro, es posible que mediante mejoras adicionales en el rendimiento, la optimización de la arquitectura sin codificador y la construcción de multimodalidad nativa, se impulse aún más el desarrollo de los modelos multimodales.

Enlace al artículo: https://arxiv.org/abs/2406.11832

Código del proyecto: https://github.com/baaivision/EVE

Enlace al modelo: https://huggingface.co/BAAI/EVE-7B-HD-v1.0