¿Has oído hablar del increíble OpenAI Sora? Con un costo de entrenamiento de millones de dólares, es el "Rolls-Royce" de la generación de video. Ahora, Luojian Technology anuncia el modelo de generación de video de código abierto Open-Sora2.0!

Con solo 200,000 dólares (equivalente a 224 GPU), se entrenó con éxito un gran modelo de generación de video de nivel comercial con 11 mil millones de parámetros.

Rendimiento a la par de "OpenAI Sora"

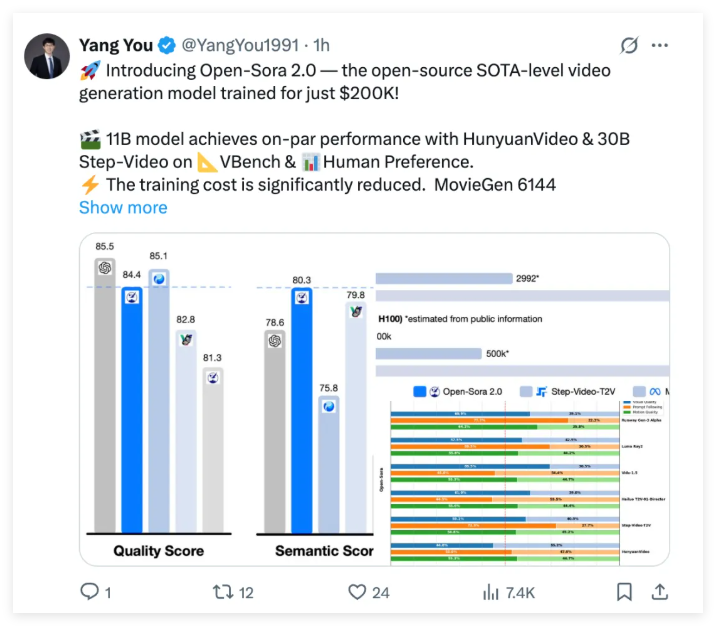

Aunque Open-Sora2.0 tiene un bajo costo, su potencia es innegable. Se atreve a desafiar a los líderes de la industria como HunyuanVideo y Step-Video, que cuenta con 30 mil millones de parámetros. En las evaluaciones autorizadas de VBench y las pruebas de preferencia del usuario, Open-Sora2.0 ha demostrado ser impresionante, igualando en varios indicadores clave a los modelos cerrados que cuestan millones de dólares en entrenamiento.

Más emocionante aún, en las evaluaciones de VBench, la diferencia de rendimiento entre Open-Sora2.0 y OpenAI Sora se redujo de un 4.52% a solo un 0.69%! Esto es prácticamente una igualdad de rendimiento!

Además, Open-Sora2.0 incluso superó a HunyuanVideo de Tencent en VBench. Una nueva generación que, con un costo menor, logra un rendimiento superior, estableciendo un nuevo estándar para la tecnología de generación de video de código abierto.

En las pruebas de preferencia del usuario, Open Sora superó en al menos dos indicadores clave (rendimiento visual, coherencia de texto y rendimiento de movimiento) a los modelos de código abierto SOTA como HunyuanVideo y a modelos comerciales como Runway Gen-3Alpha.

El secreto del bajo costo y alta eficiencia

Seguramente se preguntan cómo Open-Sora2.0 logra un rendimiento tan alto con un costo tan bajo. Detrás hay varias claves. Primero, el equipo de Open Sora continuó con el diseño de Open-Sora1.2, utilizando un autocodificador 3D y un marco de entrenamiento de coincidencia de flujo. También introdujeron un mecanismo de atención completa 3D, mejorando aún más la calidad de la generación de video.

Para optimizar al máximo el costo, Open-Sora2.0 abordó varios aspectos:

- Selección rigurosa de datos, asegurando una entrada de datos de entrenamiento de alta calidad para mejorar la eficiencia desde la fuente.

- Entrenamiento prioritario de baja resolución, aprendizaje eficiente de la información de movimiento y reducción del costo computacional. ¡El entrenamiento de alta resolución cuesta decenas de veces más que el de baja resolución!

- Entrenamiento prioritario de tareas de imagen a video, acelerando la convergencia del modelo y reduciendo aún más el costo de entrenamiento. Además, en la etapa de inferencia, se puede utilizar la generación de imagen a partir de texto y luego a video (T2I2V) para obtener efectos visuales más refinados.

- Se adoptó un esquema de entrenamiento paralelo eficiente, combinado con ColossalAI y optimización a nivel de sistema, mejorando significativamente la utilización de los recursos informáticos. Con tecnologías como la paralelización eficiente de secuencias, ZeroDP, puntos de control de gradiente de grano fino y mecanismos de recuperación automática de entrenamiento, la eficiencia del entrenamiento se incrementó considerablemente.

Se estima que el costo de entrenamiento de los modelos de video de código abierto de más de 10 mil millones de parámetros en el mercado supera el millón de dólares, mientras que Open Sora2.0 reduce este costo en 5 a 10 veces. Esto es una gran noticia para la generación de video, permitiendo que más personas participen en el desarrollo de la generación de video de alta calidad.

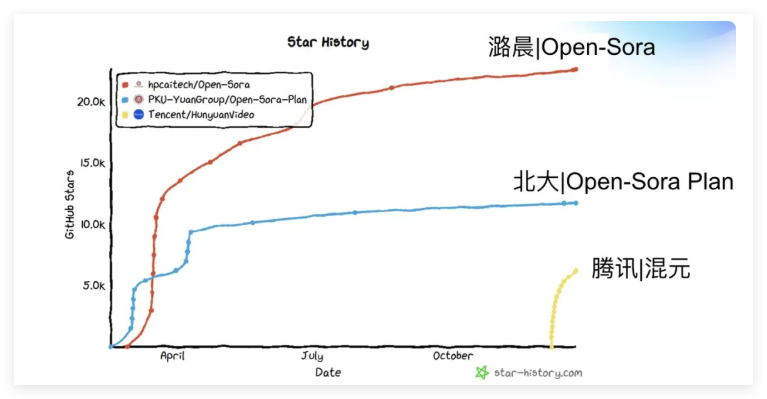

Código abierto y compartido, construyendo un ecosistema próspero

Lo más destacable es que Open-Sora no solo ha abierto el código y los pesos del modelo, sino también el código de entrenamiento del proceso completo, lo que sin duda impulsará enormemente el desarrollo del ecosistema de código abierto. Según las estadísticas de plataformas tecnológicas de terceros, las citas de artículos académicos de Open-Sora alcanzaron casi cien en seis meses, ocupando el primer lugar en el ranking de influencia de código abierto mundial, convirtiéndose en uno de los proyectos de generación de video de código abierto con mayor influencia mundial.

El equipo de Open-Sora también está explorando activamente la aplicación de autocodificadores de video de alta compresión para reducir significativamente el costo de inferencia. Entrenaron un autocodificador de video de alta compresión (4×32×32), reduciendo el tiempo de inferencia de un video de 768 px y 5 segundos en una sola tarjeta de casi 30 minutos a menos de 3 minutos, ¡una mejora de 10 veces en la velocidad! Esto significa que en el futuro podremos generar contenido de video de alta calidad más rápidamente.

El modelo de generación de video de código abierto Open-Sora2.0 lanzado por Luojian Technology, con sus características de bajo costo, alto rendimiento y código abierto completo, sin duda aporta una fuerte tendencia de "bajo precio" al campo de la generación de video. Su aparición no solo reduce la brecha con los modelos cerrados de primer nivel, sino que también reduce el umbral de la generación de video de alta calidad, permitiendo que más desarrolladores participen y promuevan conjuntamente el desarrollo de la tecnología de generación de video.

🔗 Repositorio de código abierto de GitHub:https://github.com/hpcaitech/Open-Sora

📄Informe técnico:https://github.com/hpcaitech/Open-Sora-Demo/blob/main/paper/Open_Sora_2_tech_report.pdf