Dans le monde de l'IA, la formule « plus on en fait, mieux c'est » semble être une règle d'or. Plus le modèle est grand, plus les données sont nombreuses, plus la puissance de calcul est importante, plus on se rapproche apparemment du Graal de l'intelligence. Cependant, derrière cette progression fulgurante se cachent des coûts et une consommation énergétique considérables.

Pour rendre l'entraînement de l'IA plus efficace, les scientifiques sont constamment à la recherche d'optimiseurs plus puissants, comme un entraîneur qui guide les paramètres du modèle vers une optimisation continue afin d'atteindre un état optimal. AdamW, l'optimiseur par défaut du pré-entraînement Transformer, est depuis des années une référence dans le secteur. Cependant, face à la taille de plus en plus importante des modèles, AdamW commence à montrer ses limites.

N'existe-t-il pas une méthode permettant d'améliorer la vitesse d'entraînement tout en réduisant la consommation énergétique ? Pas de panique, une équipe entièrement chinoise arrive avec son « arme secrète » : C-AdamW !

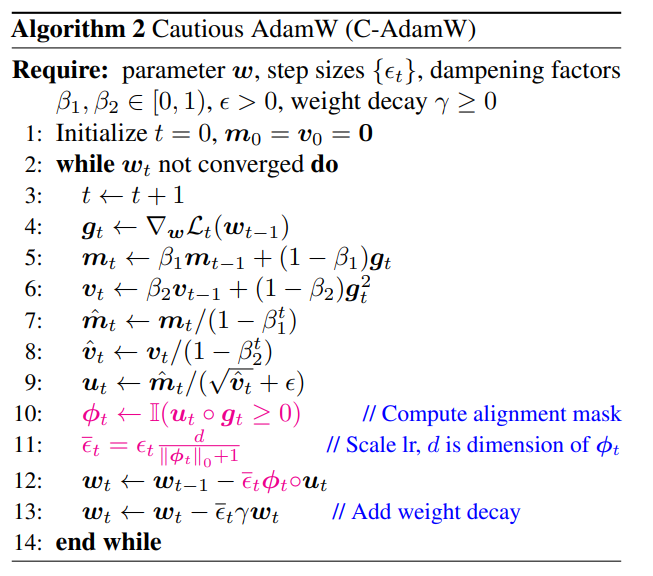

C-AdamW, acronyme de Cautious AdamW, signifie « AdamW prudent » en français. Cela sonne-t-il « zen » ? En effet, l'idée principale de C-AdamW est de « bien réfléchir avant d'agir ».

Imaginez que les paramètres du modèle sont comme un groupe d'enfants pleins d'énergie qui veulent courir partout. AdamW est comme un professeur dévoué qui essaie de les guider dans la bonne direction. Mais parfois, les enfants sont trop excités, se trompent de chemin et perdent du temps et de l'énergie.

Dans ce cas, C-AdamW est comme un sage qui possède un « œil perçant » et peut identifier précisément si la direction de la mise à jour est correcte. Si la direction est mauvaise, C-AdamW s'arrête immédiatement pour éviter que le modèle ne s'égare.

Cette stratégie « prudente » garantit que chaque mise à jour réduit efficacement la fonction de perte, accélérant ainsi la vitesse de convergence du modèle. Les résultats expérimentaux montrent que C-AdamW a augmenté la vitesse d'entraînement de 1,47 fois dans le pré-entraînement Llama et MAE !

Plus important encore, C-AdamW n'a pratiquement pas de frais de calcul supplémentaires et ne nécessite qu'une simple modification d'une ligne de code existant. Cela signifie que les développeurs peuvent facilement appliquer C-AdamW à divers entraînements de modèles et profiter de la « vitesse et de l'excitation » !

L'aspect « zen » de C-AdamW réside également dans le fait qu'il conserve la fonction hamiltonienne d'Adam et, grâce à l'analyse de Lyapunov, ne compromet pas la garantie de convergence. Cela signifie que C-AdamW est non seulement plus rapide, mais aussi plus stable, évitant ainsi les problèmes d'échec de l'entraînement.

Bien sûr, « zen » ne signifie pas « inerte ». L'équipe de recherche a déclaré qu'elle continuerait à explorer des fonctions ϕ plus riches et à appliquer des masques dans l'espace des caractéristiques plutôt que dans l'espace des paramètres afin d'améliorer encore les performances de C-AdamW.

On peut prévoir que C-AdamW deviendra le chouchou du domaine de l'apprentissage profond et révolutionnera l'entraînement des grands modèles !

Adresse de l'article : https://arxiv.org/abs/2411.16085

GitHub :