हाल ही में, EmoTalk3D नामक एक अत्याधुनिक तकनीकी परियोजना ने कृत्रिम बुद्धिमत्ता के क्षेत्र में व्यापक ध्यान आकर्षित किया है। इस परियोजना ने EmoTalk3D डेटा सेट को पेश करके, जिसमें कैलिब्रेटेड मल्टीव्यू वीडियो, भावनात्मक लेबल और प्रत्येक फ्रेम का 3D ज्यामिति डेटा शामिल है, उच्च फिडेलिटी पर भावनात्मक रूप से समृद्ध 3D बोलते अवतारों को स्वतंत्र रूप से बनाने में सफलता प्राप्त की है।

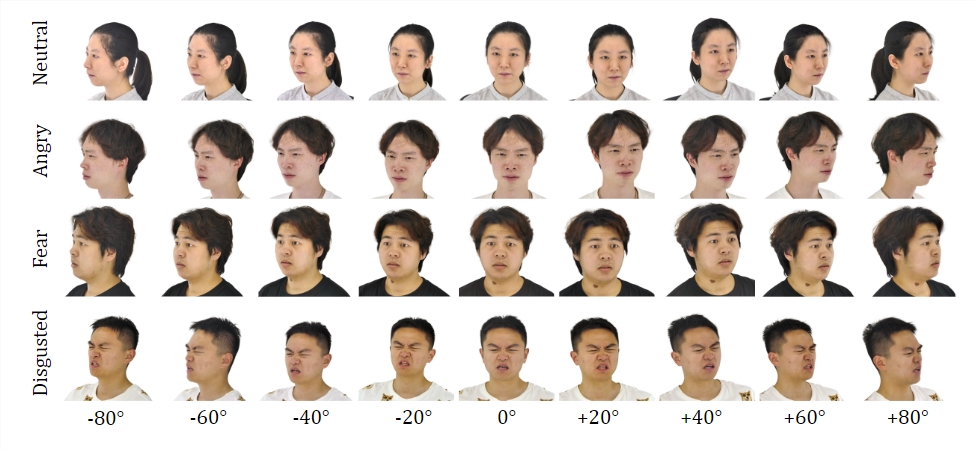

जानकारी के अनुसार, EmoTalk3D परियोजना की शोध टीम ने वर्तमान 3D बोलते अवतार तकनीक में मल्टीव्यू सुसंगतता और भावनात्मक अभिव्यक्ति की कमी को ध्यान में रखते हुए एक नई संश्लेषण विधि प्रस्तुत की है। इस विधि में न केवल बेहतर होंठ सिंक्रनाइजेशन और रेंडरिंग गुणवत्ता है, बल्कि यह उत्पन्न बोलते अवतार में नियंत्रित भावनात्मक अभिव्यक्ति को भी संभव बनाती है।

शोध टीम ने "आवाज से ज्यामिति से रूप" का एक मानचित्रण ढांचा डिजाइन किया। यह ढांचा पहले ऑडियो विशेषताओं से विश्वसनीय 3D ज्यामिति अनुक्रम की भविष्यवाणी करता है, और फिर इन ज्यामितियों के आधार पर 4D गॉसियन द्वारा प्रदर्शित 3D बोलते अवतार की उपस्थिति को संश्लेषित करता है। इस प्रक्रिया में, उपस्थिति को मानक और गतिशील गॉसियन घटकों में और अधिक विभाजित किया गया है, जो मल्टीव्यू वीडियो से सीखे जाने के माध्यम से एकीकृत होते हैं, जिससे स्वतंत्र दृष्टि के बोलते अवतार एनीमेशन को रेंडर किया जा सके।

यह उल्लेखनीय है कि EmoTalk3D परियोजना की शोध टीम ने गतिशील चेहरे के विवरण जैसे कि झुर्रियों और सूक्ष्म भावनाओं को पकड़ने में पूर्व विधियों की कठिनाइयों को सफलतापूर्वक हल किया है। प्रयोगात्मक परिणाम बताते हैं कि इस विधि में उच्च फिडेलिटी और भावनात्मक रूप से नियंत्रित 3D बोलते अवतार उत्पन्न करने में महत्वपूर्ण लाभ है, जबकि होंठ आंदोलन उत्पन्न करने में बेहतर रेंडरिंग गुणवत्ता और स्थिरता प्रदर्शित होती है।

वर्तमान में, EmoTalk3D परियोजना का कोड और डेटा सेट निर्दिष्ट HTTPS URL पर प्रकाशित किया गया है, ताकि वैश्विक शोधकर्ताओं और डेवलपर्स द्वारा संदर्भित और उपयोग किया जा सके। यह नवोन्मेषी तकनीकी突破 निश्चित रूप से 3D बोलते अवतार क्षेत्र के विकास में नई ऊर्जा डालेगा, और भविष्य में वर्चुअल रियलिटी, ऑगमेंटेड रियलिटी, फिल्म निर्माण और कई अन्य क्षेत्रों में लागू होने की संभावना है।