जापानी आर्टिफिशियल इंटेलिजेंस कंपनी साकाना एआई ने हाल ही में ट्रांसफार्मर² लॉन्च किया है, जो एक नवोन्मेषी विधि है, जिसका उद्देश्य भाषा मॉडल को विभिन्न कार्यों के लिए अधिक कुशलता से अनुकूलित करने में मदद करना है। मौजूदा आर्टिफिशियल इंटेलिजेंस सिस्टम के विपरीत, ट्रांसफार्मर² एक दो-चरणीय शिक्षण प्रक्रिया के माध्यम से नए कार्यों का सामना करते समय भाषा मॉडल की सीमाओं को हल करने में सक्षम है, जो इस क्षेत्र में निरंतर सीखने की तकनीकों में प्रगति का प्रतीक है।

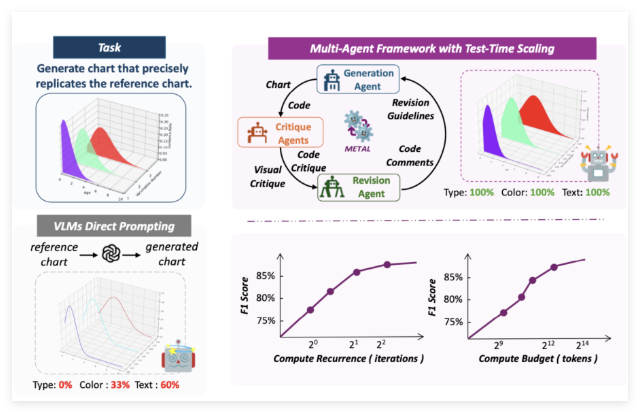

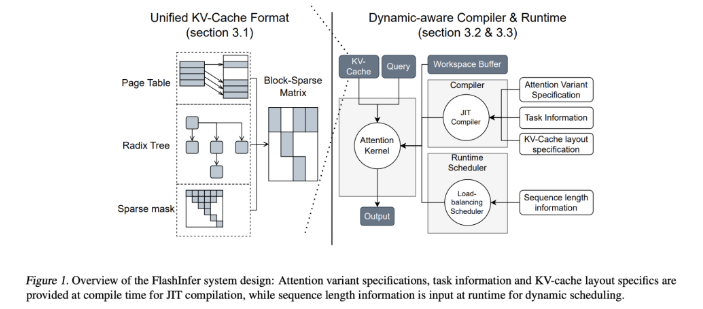

वर्तमान आर्टिफिशियल इंटेलिजेंस सिस्टम आमतौर पर एक बार में कई कार्यों को संभालने के लिए प्रशिक्षित होते हैं, लेकिन वे नए कार्यों का सामना करते समय अप्रत्याशित चुनौतियों का सामना कर सकते हैं, जिससे मॉडल की अनुकूलनशीलता सीमित हो जाती है। ट्रांसफार्मर² का डिज़ाइन सिद्धांत इसी समस्या को लक्षित करता है, विशेषज्ञ वेक्टर और सिंगुलर वैल्यू फाइन-ट्यूनिंग (SVF) तकनीक का उपयोग करता है, जिससे मॉडल को पूरे नेटवर्क को फिर से प्रशिक्षित किए बिना नए कार्यों का लचीले ढंग से सामना करने की अनुमति मिलती है।

ट्रांसफार्मर² ने पारंपरिक विधियों से भिन्न प्रशिक्षण पद्धति अपनाई है। पारंपरिक प्रशिक्षण विधियों को पूरे न्यूरल नेटवर्क के वेट को समायोजित करने की आवश्यकता होती है, जो न केवल महंगा है, बल्कि मॉडल को पहले सीखी गई जानकारी "भूलने" का कारण भी बन सकता है। इसके विपरीत, SVF तकनीक विशेषज्ञ वेक्टर के माध्यम से प्रत्येक नेटवर्क कनेक्शन के महत्व को नियंत्रित करने के लिए सीखती है, जिससे इन समस्याओं से बचा जा सकता है। विशेषज्ञ वेक्टर नेटवर्क कनेक्शन के वेट मैट्रिक्स को समायोजित करके मॉडल को विशिष्ट कार्यों पर ध्यान केंद्रित करने में मदद करते हैं, जैसे गणितीय संचालन, प्रोग्रामिंग और तार्किक तर्क।

यह विधि नए कार्यों के लिए मॉडल की अनुकूलनशीलता की आवश्यकता वाले पैरामीटर की मात्रा को महत्वपूर्ण रूप से कम कर देती है। उदाहरण के लिए, LoRA विधि को 6820000 पैरामीटर की आवश्यकता होती है, जबकि SVF को केवल 160000 पैरामीटर की आवश्यकता होती है। इससे न केवल मेमोरी और प्रोसेसिंग क्षमता की खपत कम होती है, बल्कि यह भी सुनिश्चित होता है कि मॉडल किसी विशेष कार्य पर ध्यान केंद्रित करते समय अन्य ज्ञान को न भूलें। सबसे महत्वपूर्ण बात यह है कि ये विशेषज्ञ वेक्टर प्रभावी ढंग से सहयोग कर सकते हैं, जिससे मॉडल की विविध कार्यों के प्रति अनुकूलनशीलता बढ़ती है।

अनुकूलनशीलता को और बढ़ाने के लिए, ट्रांसफार्मर² ने मजबूत शिक्षण को शामिल किया है। प्रशिक्षण प्रक्रिया के दौरान, मॉडल कार्य समाधान प्रस्तुत करके और प्रतिक्रिया प्राप्त करके विशेषज्ञ वेक्टर को लगातार अनुकूलित करता है, जिससे नए कार्यों पर प्रदर्शन में सुधार होता है। टीम ने इन विशेषज्ञ ज्ञान का उपयोग करने के लिए तीन रणनीतियाँ विकसित की हैं: अनुकूलन संकेत, कार्य वर्गीकर्ता और कम नमूना अनुकूलन। विशेष रूप से, कम नमूना अनुकूलन रणनीति नए कार्य के उदाहरणों का विश्लेषण करके और विशेषज्ञ वेक्टर को समायोजित करके मॉडल की लचीलापन और सटीकता को और बढ़ाती है।

कई बेंचमार्क परीक्षणों में, ट्रांसफार्मर² ने पारंपरिक विधि LoRA से बेहतर प्रदर्शन किया है। गणितीय कार्यों पर, इसके प्रदर्शन में 16% की वृद्धि हुई है, और आवश्यक पैरामीटर की मात्रा में भी काफी कमी आई है। नए कार्यों का सामना करते समय, ट्रांसफार्मर² की सटीकता मूल मॉडल की तुलना में 4% अधिक है, जबकि LoRA अपेक्षित परिणाम प्राप्त करने में असफल रहा।

ट्रांसफार्मर² केवल जटिल गणितीय समस्याओं को हल करने में सक्षम नहीं है, बल्कि यह प्रोग्रामिंग और तार्किक तर्क की क्षमताओं को भी संयोजित करता है, जिससे क्षेत्रीय ज्ञान का साझा करना संभव होता है। उदाहरण के लिए, टीम ने पाया कि छोटे मॉडल भी विशेषज्ञ वेक्टर को स्थानांतरित करके बड़े मॉडल के ज्ञान का उपयोग करके प्रदर्शन में सुधार कर सकते हैं, जिससे मॉडल के बीच ज्ञान साझा करने की नई संभावनाएं उत्पन्न होती हैं।

हालांकि ट्रांसफार्मर² ने कार्य अनुकूलनशीलता में महत्वपूर्ण प्रगति की है, फिर भी यह कुछ सीमाओं का सामना कर रहा है। वर्तमान में, SVF प्रशिक्षण द्वारा प्रशिक्षित विशेषज्ञ वेक्टर केवल पूर्व-प्रशिक्षित मॉडल में पहले से मौजूद क्षमताओं पर निर्भर कर सकते हैं, और नए कौशल जोड़ने में असमर्थ हैं। वास्तविक निरंतर सीखना, जिसका अर्थ है कि मॉडल को नए कौशल को स्वायत्त रूप से सीखने में सक्षम होना, यह लक्ष्य अभी भी प्राप्त करने के लिए समय लेगा। 700 बिलियन से अधिक पैरामीटर वाले बड़े मॉडल में इस तकनीक का विस्तार कैसे किया जाए, यह अभी भी एक अनसुलझा प्रश्न है।